工业人工智能:深度学习如何补充机器视觉系统

在工业自动化领域,人工智能(AI)已成为一个流行词。 撇开炒作不谈,人工智能已经在工业领域占据了一席之地,如果设计和实施得当,它可以在工厂车间提供巨大的价值。 深度学习是人工智能的一个子集,它使用神经网络,例如模仿人脑学习过程的卷积神经网络 (CNN),它已成为一种流行的工业人工智能工具,因为它能够帮助主观检查决策和检查场景由于高度可变性或复杂性,识别特定特征很困难。

在选择深度学习解决方案时,制造商有多种选择,包括内部编程解决方案、利用 PyTorch 或 TensorFlow 等已建立的框架。 制造商还可以选择购买现成的解决方案或选择特定于应用的人工智能系统或产品。

然而,深度学习并不是一项独立的技术。 相反,当与传统技术一起部署时 机器视觉 技术,它成为自动化检测的强大工具,可增强电子和半导体检测、消费品检测和汽车检测等应用中部署的工业自动化系统的整体能力。

应用

深度学习:机器视觉工具箱的工具

机器视觉是指一组硬件——包括 相机s、光学和照明——以及适当的 软件,帮助企业根据机器视觉系统完成的图像分析执行某些功能。 机器视觉应用的四大类是检查、识别、引导和测量,所有系统的核心是软件,它有助于提高组件的功能、可靠性和可用性。

传统的机器视觉软件是指能够执行大量自动成像任务的离散的、基于规则的算法。 通用机器视觉算法的示例包括边缘检测、图像变换、内容统计、相关性、几何搜索、OCR/OCV 和相关性。 在将深度学习融入机器视觉系统时,重要的是要记住深度学习不能部署到所有机器视觉应用中。

当然,在某些应用中,深度学习可以填补传统方法无法填补的空白。 例如,检查焊缝的机器视觉系统将在焊缝图像上查找特定细节,但由于每个焊缝都是唯一的,因此软件很难通过算法进行定义。 另一方面,深度学习可以识别更主观的特征,类似于人们检查焊缝的方式。 看起来与金色图像不同的轻微非晶态焊缝并不一定等同于有缺陷的焊缝。

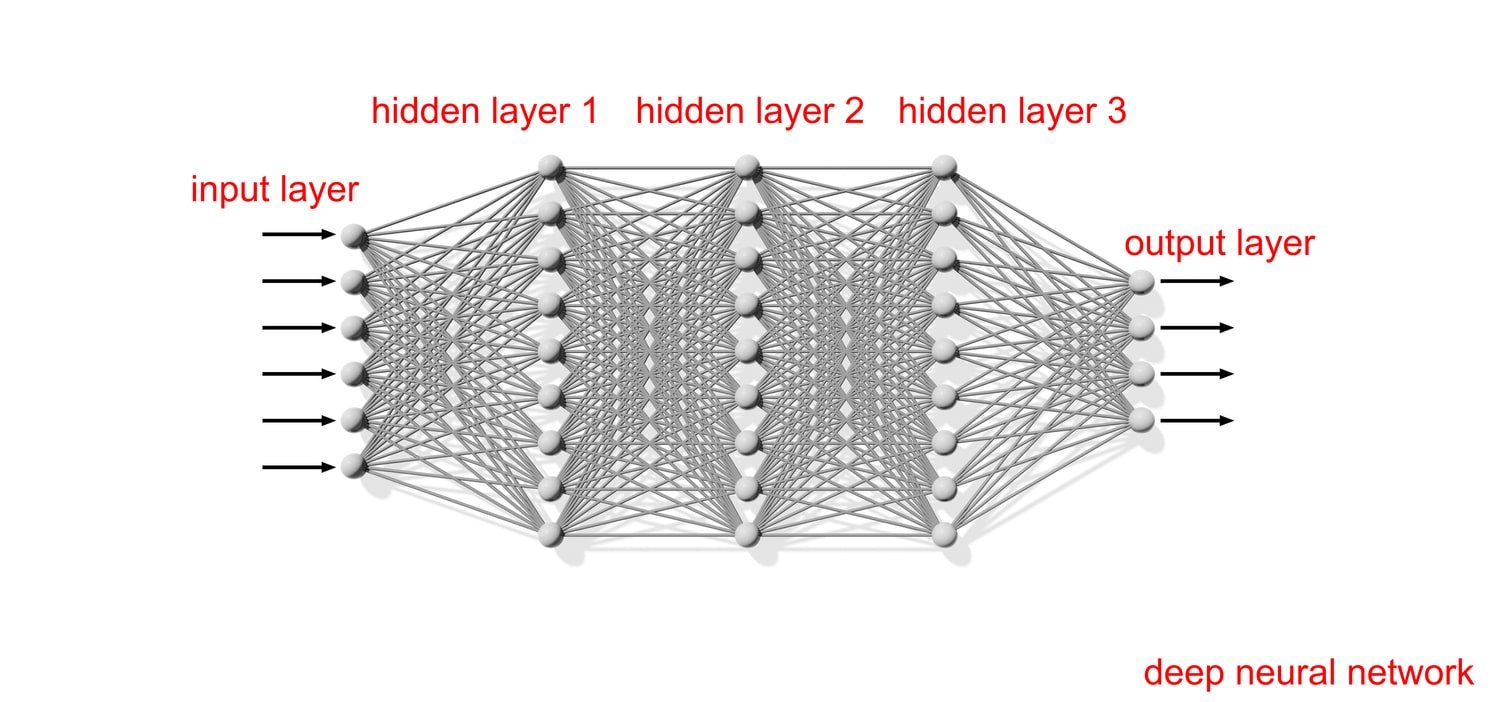

图1: 神经网络以人脑为模型,是机器学习的一个子集,是深度学习算法的核心,允许计算机根据训练示例学习执行特定任务。

深度学习要取得任何程度的成功,都需要创建高质量的数据集。 制造商可以通过上传描述必须与“良好图像”一起检测的缺陷或特征类别的图像来创建初始数据集。 主题专家团队可以标记初始数据集并训练模型,使用原始数据集中的测试图像验证结果,测试生产中的性能,并重新训练模型以涵盖任何新案例、功能或缺陷。 一旦完成此操作,并且考虑了在机器视觉系统中实施深度学习的所有因素,该软件就可以开始帮助进行缺陷检测、特征分类和装配验证,以及检查复杂或高度可变的场景,其中识别特定特征可能很困难,例如混合零件或产品的箱式拣选。

深度学习相机注意事项

虽然这可能是陈词滥调,但在开发深度学习应用程序时,确实是“垃圾输入,垃圾输出”。 与传统的机器视觉方法一样,深度学习应用程序无法克服不良的照明或光学设计,并且仍然需要高质量的图像来创建用于训练和标记的高质量数据集。 这意味着实施最佳照明设置以提供足够的图像对比度,或者在某些情况下实施专门的照明方案。 例如,某些应用可能需要对单个零件进行多次检查,这意味着针对诸如存在/不存在或检查物体的大小或形状等事物进行不同的照明设置。

当然,虽然照明对于任何机器视觉或深度学习应用的成功都至关重要,但系统的核心是相机以必要的速度和分辨率捕获图像的能力。 图像必须是适合目标应用的正确分辨率,并具有最佳的特征对比度,但还必须考虑其他几个应用限制和注意事项。其中包括尺寸、重量、功率、成像对象的速度、流媒体与记录、彩色与单色、最小缺陷尺寸和最小视野。

在高速应用中,零件或物体移动速度非常快,需要系统冻结物体的动作以分析细节,这将需要更高速的相机,而需要高水平细节的系统将需要具有高速的相机。分辨率图像传感器。 Emergent Vision Technologies 专注于工业领域的设计和开发 高速摄像机 提供当今机器视觉市场中最高的帧速率和分辨率。

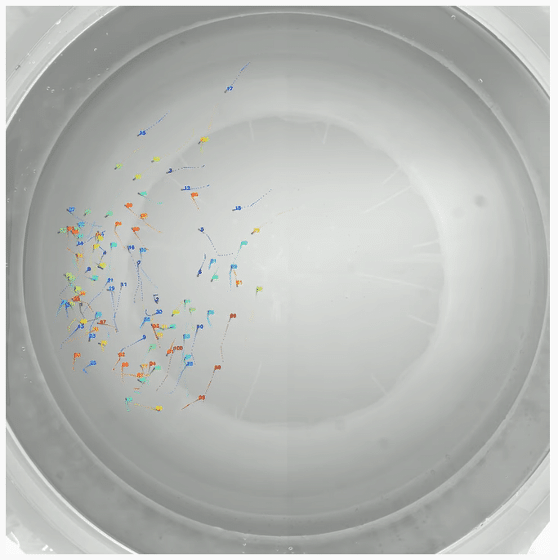

图2: Intracker.ai 工具可识别并跟踪单个未标记动物的位置,无论动物的种类或大小如何。 在此应用中,研究人员使用 Emergent 的 20MP 10GigE 相机追踪 100 条幼年斑马鱼,准确率高达 99.9%。

充分利用已有的 GigE视觉 和 GenICam 标准,Emergent 机器视觉相机 可以无缝集成到兼容的软件应用程序中,无需专有的采集硬件或布线。紧急的 10GigE, 25GigE和 100GigE 相机经验 为必须生成大量数据然后快速可靠地传输到工业 PC 等主机设备的应用提供超过 100MP+ 的分辨率和接近 3500fps 的帧速率。

通过使用以太网作为连接接口,Emergent 摄像机可提供高达 100Gbps 的连接速度,而无需牺牲传感器分辨率或速度。 此外,摄像机还可以使用 IEEE1588 PTP 进行同步,以在 1μs 的时间内高速捕获事件图像,无需 CPU 利用率,并且在电缆长度长达 10KM 时,CPU 利用率、内存带宽、延迟和抖动绝对最低。

推理

下面的视频展示了如何轻松地添加和测试自己训练的推理模型来执行任意对象的检测和分类。 只需使用 PyTorch 或 TensorFlow 训练您的模型,并将其添加到您自己的 eCapture Pro 插件中。 然后实例化插件,连接到所需的相机并单击运行 - 没有比这更容易的了。

借助训练有素的模型,可以使用 Emergent 的 GPU Direct 功能在一台具有多个 GPU 的 PC 上使用许多 Emergent 相机来开发和部署‘判断(Inference)“等应用程序 – 这种开发高性能应用程序的方式为Emergent独创。

定制插件开发

在这个短片中,我们演示了客户可以创建自己的自定义插件的过程,这些插件随后可以加载到 eCapture Pro 中并生成实时结果。 我们注意到,任何插件都可以馈送到我的一台或多台摄像机,以测试总系统吞吐量,以实现最大系统密度。

GPUDIRECT:零数据丢失成像

如今,许多应用程序都依赖 NVIDIA GPU 来执行深度学习任务,以满足计算能力要求。 Emergent 的机器视觉相机也兼容 NVIDIA GPU直连 技术,可以将图像直接传输到 GPU 内存。 对于一位利用 GPUDirect 技术的 Emergent 客户来说,这意味着部署一个基于 Bolt HB-12000-SB 25GigE 相机,一台服务器和CPU,两个双口100G 网络接口卡 (NIC)、一个 24x 端口交换机和两个 NVIDIA GPU。

在这个系统中,客户部署了24x HB-12000-SB 相机,采用 12.4MP Sony Pregius S IMX535,以 60fps 捕获图像并将数据直接发送到 GPU,从而 零数据丢失成像 CPU 利用率为零,内存带宽为零。 和 H.265压缩,图像还可以本地存储在磁盘上,也可以流式传输到实时消息协议 (RTMP) 客户端,例如 YouTube。 利用 GPUDirect 等创新处理技术,最终用户可以快速高效地获取、传输和处理大量数据,而无需担心帧丢失。

适用于人工智能和深度学习应用的Emergent GIGE VISION 相机

| 型号 | 相机类型 | 分辨率 | 帧率 | 接口 | 传感器型号 | 像素大小 | |

|---|---|---|---|---|---|---|---|

|

HR-1800-SM | 黑白 | 1.76MP | 660fps | 10GigE SFP+ | Sony IMX425 | 9 × 9 µm |

|

HR-1800-SC | 彩色 | 1.76MP | 660fps | 10GigE SFP+ | Sony IMX425 | 9 × 9 µm |

|

HR-5000-SM | 黑白 | 5MP | 163fps | 10GigE SFP+ | Sony IMX250LLR | 3.45 × 3.45 µm |

|

HR-5000-SC | 彩色 | 5MP | 163fps | 10GigE SFP+ | Sony IMX250LQR | 3.45 × 3.45 µm |

|

HR-12000-SM | 黑白 | 12MP | 80fps | 10GigE SFP+ | Sony IMX253LLR | 3.45 × 3.45 µm |

|

HR-12000-SC | 彩色 | 12MP | 80fps | 10GigE SFP+ | Sony IMX253LQR | 3.45 × 3.45 µm |

|

HR-25000-SB-M | 黑白 | 24.47MP | 51fps | 10GigE SFP+ | Sony IMX530 | 2.74 ×2.74 μm |

|

HR-25000-SB-C | 彩色 | 24.47MP | 51fps | 10GigE SFP+ | Sony IMX530 | 2.74 ×2.74 μm |

如需其他相机选项,请查看我们的 交互式系统设计工具。