案例研究:高速摄像机打破实时混合现实的障碍

了解元宇宙直播公司 Condense Reality 如何使用 Emergent 高速将其混合现实系统提升到一个新的水平 千兆以太网相机 在其体积捕获系统中。 新兴产品主要用于元宇宙体育、娱乐和现场活动应用程序。

想象一下,在一场千载难逢的音乐会上,能够站在你最喜欢的表演者旁边——或者为每场比赛预留 50 码线的座位,或者有机会在明星球员冲锋时与他们一起“奔跑”联赛冠军。 现在,想象一下,当您坐在客厅里、忙碌了一天的工作后通勤回家,或玩最新的多人游戏时,能够获得这些体验。

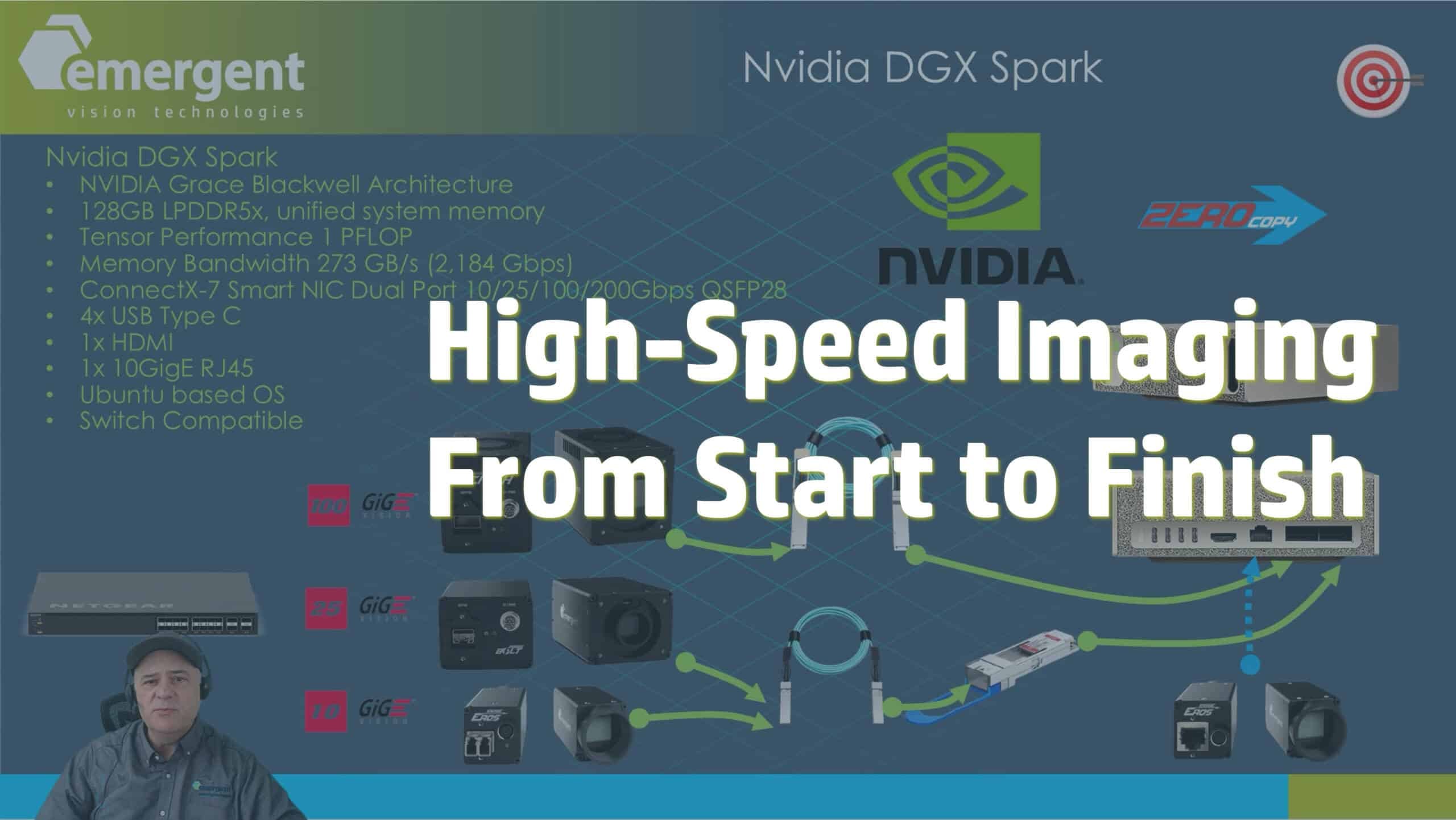

身临其境的体验是沉浸式媒体承诺通过实时混合现实 (MR) 提供的。 这种新格式使用立体视频数据在事件发生时创建三维 (3D) 图像(图 1)。 此外,多人可以在一系列设备上从不同角度查看图像。

捕捉 3D 现实很难

媒体公司是 360 度视频、虚拟现实 (VR)、增强现实 (AR) 和 MR 等技术形式的早期采用者。

常规的,而不是实时的,MR 在 3D 中混合了物理和数字对象,并且通常在带有绿色屏幕和数百个精确校准相机的专用空间中生成。 处理每个场景中捕获的大量体积数据需要数小时甚至数天的后期制作时间。

事实证明,尝试实时进行 MR 对内容开发人员来说在技术和经济上更具挑战性,并且到目前为止,这种格式不切实际。

高速成像相机的主要制造商 Emergent Vision Technologies 的首席执行官兼创始人 John Ilett 说:“仅靠大量相机捕获和同步高分辨率、高帧率视频对我们来说就足够简单了” . “在现场实时处理这段视频确实存在挑战。”

图 1:Condense Reality 使用 Emergent Vision Technologies 的高速 GigE Vision 相机来产生身临其境的混合现实体验。

深度学习需要帮助

一家初创公司认为它有克服这些问题的战略。 Condense Reality 是一家体积视频公司,它计划以多种分辨率捕获图像、重建场景并将 MR 内容流式传输到最终用户设备。 从开始到结束,直播流中的每一帧只需要几毫秒即可完成。

“我们的软件计算场景中物体的大小和形状,”Condense Reality 首席执行官 Nick Fellingham(图 2)说。 “如果相机无法看到任何物体,该软件会使用深度学习来填补空白并剔除不需要的东西,然后将 3D 运动图像流式传输到手机、平板电脑、计算机、游戏机、耳机和智能设备。电视和眼镜。”

但是有一个障碍。 为了让软件在实际应用中发挥作用,Fellingham 需要一台高分辨率、高帧率的摄像机,内容创作者可以在体育场馆、音乐会场地或偏远地区轻松安装该摄像机。 该公司测试了摄像头,但模型使用的数据吞吐量和摄像头与系统数据处理单元之间的电缆距离非常有限。 为了向前推进,Condense Reality 需要一台能够高速处理体积数据的广播级摄像机。

图 2:Condense Reality 首席执行官 Nick Fellingham 站在公司的体积捕获装置之一内。

高速相机提供

2020 年,Fellingham 了解到 Emergent Vision Technologies 正在发布几款配备高分辨率图像传感器的新型相机。 这些相机包括型号 SFP28-25GigE、QSFP28-50GigE 和 QSFP28-100GigE 接口选项,所有这些选项都提供覆盖任何长度的电缆选项。

“我们的相机以高速和高数据率提供高质量的图像,”Ilett 说。 “他们利用传感器技术的进步并结合我们开发的固件,使相机能够达到传感器的全帧率。”

MR 体验中的图像应该以极高的帧速率和分辨率捕获。 使用新相机,Fellingham 能够组装出具有商业可行性的系统。 “我们需要高速 GigE 相机来快速从相机中获取数据并进行流式传输,”他指出。

高速捕捉对于体育运动尤为重要,激动人心的动作通常发生在眨眼之间。 例如,在捕捉高尔夫挥杆动作时,帧率为 30 fps 的相机可能只能“看到”挥杆动作的开始和结束,这会显着降低体积内容的质量。

“我们不使用这些相机来检查工厂中的零件; 我们正在使用它们来创造娱乐体验,”Fellingham 说。 “当速度 [fps] 增加时,快速动作的质量也会提高,我们生成的输出会更好,整体体验也会得到改善。”

更大的捕获区域即将出现

Condense Reality 作为客户项目的系统集成商。 一个标准系统使用 32 个摄像头、一个来自 Mellanox 的高速网络交换机和一个来自 NVIDIA 的图形处理单元 (GPU) 来覆盖 7 米 x 7 米的捕获范围。 该公司与 Emergent Vision Technologies 合作,为体积捕获组装了最佳系统。

“我们不一定要致力于非常具体的硬件配置,但通过与 Emergent 团队合作并测试不同的组件,我们发现 NVIDIA 和 Mellanox 最适合我们,”Fellingham 说。

在实施其技术的同时,该公司正在努力增加 MR 的捕获区域,同时保持吞吐量和质量。

“当你开始变得大于 10 x 10 米的区域时,4K 摄像机无法切割它,”Fellingham 说。 “当我们的算法改进时,我们会变得更大。”

新的 Emergent Vision Technologies 相机是这项工作不可或缺的一部分。 有机型配套 达到600 fps 凭借 5120 x 4096 的分辨率和高达 100 GigE 的接口选项,Fellingham 不必担心相机分辨率、数据速率或帧速率的上限。 这些优势意味着 Condense Reality 有能力提供更好的内容和用户体验。

软件:秘密酱汁

Condense Reality 的软件是完全专有的产品,可以创建由数十万个多边形组成的 3D 网格。 放置在对象上的节点表示被捕获对象的表面。 然后,软件使用相机获取的数据“绘制”网格。 然后,该数据使用深度学习来估计相机未覆盖的对象部分。 Fellingham 说,压缩算法然后将每一帧的网格缩小到尽可能小的尺寸。

“该软件获取所有这些数据,并以极快的速度将其转化为 3D 模型,而它之所以能够做到这一点,是因为经过了良好优化的算法、神经网络和 NVIDIA GPU,”他说。 “虽然大多数神经网络都基于 TensorFlow,但我们在系统中使用的一些神经网络需要运行得非常快,因此它们是直接为 GPU 编写的。”

他补充说:“我们的神经网络解决了非常具体的问题,这有助于优化它们的速度。 我们不会部署执行大量推理的巨大黑匣子,因为这很难优化。”

为了完成这个过程,数据被发送到 Condense Reality 的基于云的分发平台,该平台获取数据并将其放入可变比特率,以便流根据用户设备而不同。 回放发生在游戏引擎内,允许客户围绕体积视频构建自定义体验,可以是 VR 或 AR。 由于 Condense Reality 系统支持游戏引擎,因此它们的内容也可以流式传输到其他公司拥有的现有游戏世界中。 目前该软件支持 Unity 和 Unreal 游戏引擎,但该公司计划为其软件构建插件,以用于未来出现的任何新游戏引擎。

“这些引擎几乎不能再称为游戏引擎,因为它们是真正的交互式 3D 工具,”Fellingham 说。 “我们将真实世界的内容传送到这些工具中,为客户提供逼真的 3D 互动体验。”