Tech-Portal

Tech-Portal

Anatomie eines Bildverarbeitungssystems

Übersicht

Auch wenn die Hauptkomponente jedes Bildverarbeitungssystems eine Kamera ist, ist kein Bildverarbeitungssystem vollständig ohne alle folgenden Komponenten:

- Beleuchtung

- Lens

- Kamera

- Verkabelung

- Schnittstellenperipherie

- Computerplattformen

- Software

Jede Komponente in einem Bildverarbeitungssystem spielt eine wichtige Rolle bei der Erfüllung des Gesamtzwecks des Systems, der darin besteht, Maschinen dabei zu helfen, bessere Entscheidungen zu treffen, indem sie die Außenwelt betrachten. Die Erfüllung dieses Zwecks erfordert eine geordnete Positionierung der Komponenten, so dass der Informationsfluss von der Lichterfassung bis zur Lieferung und Verarbeitung eines digitalen Bildes erleichtert werden kann.

Das folgende Bild zeigt die Positionierung der einzelnen Komponenten. Jede im Bild erwähnte Komponente wird unten im Detail besprochen.

Beleuchtung

Wenn eine Kamera ein Bild eines Objekts aufnimmt, erfasst sie in Wirklichkeit das Licht, das das Objekt reflektiert hat. Wie stark Licht absorbiert oder reflektiert wird, hängt von der transparenten, transluzenten oder opaken Oberfläche des Objekts ab.

Um sicherzustellen, dass die Kamera alle für die Analyse erforderlichen Details erfassen kann, müssen Bildverarbeitungssysteme mit der richtigen Beleuchtung ausgestattet sein. Basierend auf der Position, dem Winkel, der Reflexionseigenschaft und dem Farbspektrum der Lichtquelle sind verschiedene Techniken zum Konstruieren der Beleuchtung in einem Bildverarbeitungssystem verfügbar. Diese sind:

- Positionsbasierte Beleuchtungstechniken

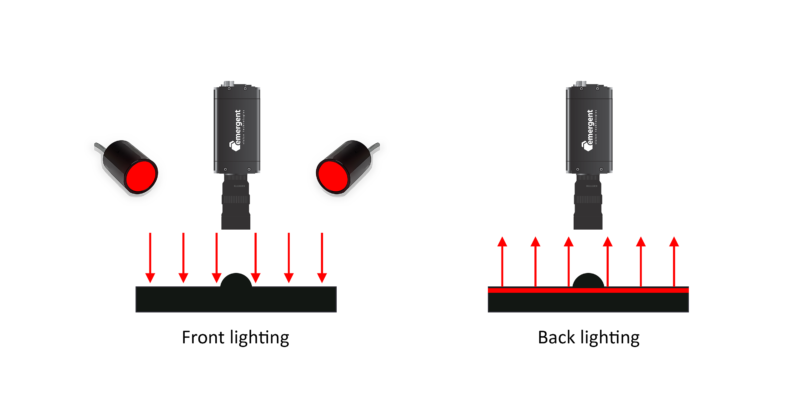

- Frontbeleuchtung – Sowohl die Kamera als auch die Lichtquelle blicken von der gleichen Seite auf die Zielszene.

- Hintergrundbeleuchtung – Kamera und Lichtquelle werden einander gegenüber positioniert, wobei sich die Zielszene in der Mitte befindet.

- Frontbeleuchtung – Sowohl die Kamera als auch die Lichtquelle blicken von der gleichen Seite auf die Zielszene.

- Winkelbasierte Beleuchtungstechniken

-

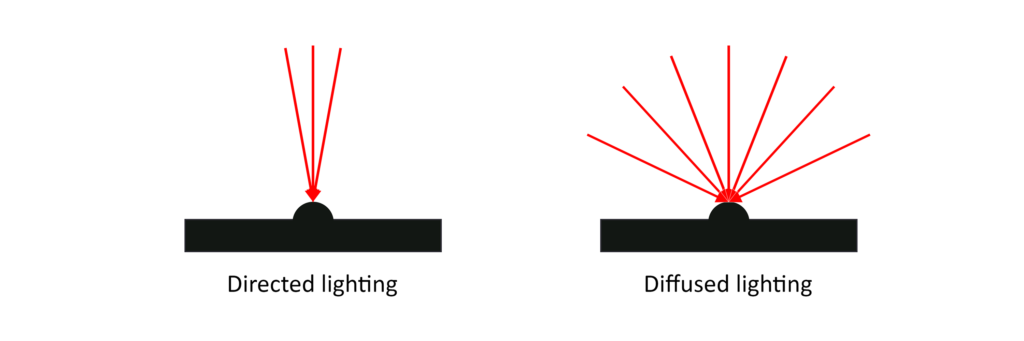

- Gerichtete Beleuchtung – Ein einzelner Lichtstrahl oder eine Gruppe von Strahlen, die in einem sehr engen Winkel gestreut werden, beleuchtet jeden Punkt der Zielszene. Die gerichtete Beleuchtung wirft starke Schatten und hebt die Textur im Bild hervor.

- Diffuse Beleuchtung – Weitwinkelig gestreute Lichtstrahlen beleuchten jeden Punkt der Zielszene. Diffuse Beleuchtung wirft wenig bis gar keine Schatten, wodurch Schattierungen eliminiert und die Textur deutlicher wird.

- Gerichtete Beleuchtung – Ein einzelner Lichtstrahl oder eine Gruppe von Strahlen, die in einem sehr engen Winkel gestreut werden, beleuchtet jeden Punkt der Zielszene. Die gerichtete Beleuchtung wirft starke Schatten und hebt die Textur im Bild hervor.

-

-

- Axial diffuse Beleuchtung – Ein Strahlteiler reflektiert diffuses Licht nach unten auf das Ziel, was zu einer gleichmäßigen Ausleuchtung führt.

-

-

-

- Diffuse Kuppelbeleuchtung – Ein Spiegel in Form einer Halbkugel reflektiert diffuses Licht nach unten und beleuchtet das Ziel.

-

- Reflektierende naturbasierte Beleuchtungstechniken

-

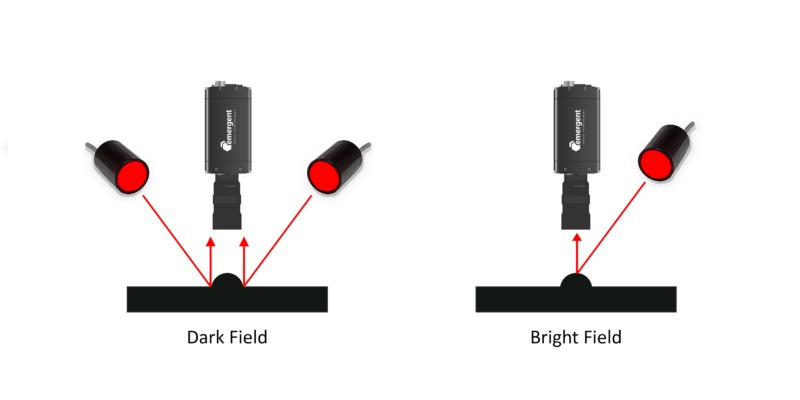

- Dunkelfeldbeleuchtung - Die Lichtquelle ist so positioniert, dass ihr Licht nicht von einem Spiegel reflektiert oder direkt in das Sichtfeld der Kamera übertragen wird.

-

- Hellfeldbeleuchtung - Die Lichtquelle ist so positioniert, dass erwartet wird, dass ihr Licht von einem Spiegel reflektiert oder direkt in das Sichtfeld der Kamera übertragen wird.

- Musterbasierte Beleuchtungstechnik

- Strukturierte Beleuchtung – Beim strukturierten Licht wird ein Lichtmuster wie Punkte, Gitter oder eine komplexere Form schräg auf ein Objekt projiziert.

- Auf Farbspektren basierende Beleuchtungstechniken

-

- RGB-Beleuchtung - Bei monochromer Bildgebung ist das Licht normalerweise ein schmales Wellenlängenband, entweder rot, grün oder blau.

-

- Weiße Beleuchtung – Für Farbbilder wird weißes Licht benötigt.

- Lichtspektrumbasierte Beleuchtungstechniken

-

- UV-Beleuchtung – Ultraviolett (UV) ist ein Spektrum mit kürzeren Wellenlängen (200 nm bis 400 nm) als denen des sichtbaren Lichts (400 nm bis 780 nm). Bei der UV-Beleuchtung wird eine UV-Licht emittierende Quelle verwendet, um ein Objekt zu beleuchten.

-

- SWIR-Beleuchtung – Das kurzwellige Infrarot (SWIR)-Spektrum (900 nm bis 2,500 nm) ist der Bereich des Infrarotlichts (780 nm und 1 mm), der dem sichtbaren Licht am nächsten kommt. Bei der SWIR-Beleuchtung wird eine SWIR-Licht emittierende Quelle verwendet, um ein Objekt zu beleuchten.

-

- NIR-Beleuchtung – Wellenlängen im nahen Infrarot (NIR) liegen im Bereich von 780–1400 nm. Bei der NIR-Beleuchtung wird eine NIR-Licht emittierende Quelle verwendet, um ein Objekt zu beleuchten.

Lens

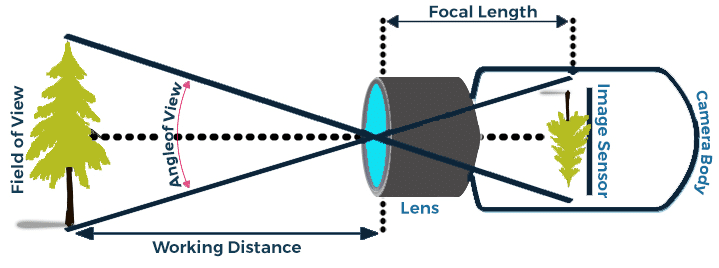

Ein Objektiv ist ein Gerät, das eine Szene vergrößert, indem es das durch es einfallende Licht fokussiert. Mit einfachen Worten, ein Objektiv ermöglicht es der Kamera, die Außenwelt klar zu sehen. Eine Szene, wie sie von der Kamera gesehen wird, wird als betrachtet im Fokus wenn die Kanten scharf erscheinen und unscharf wenn die Kanten verschwommen erscheinen. Hier ist es wichtig zu beachten, dass Objektive, die in Bildverarbeitungskameras verwendet werden, oft einen festen Fokus oder einen einstellbaren Fokus haben, während Objektive, die in Consumer-Kameras verwendet werden, z. B. DSLR- und Point & Shoot-Kameras, einen Autofokus haben. Blickwinkel (AoV), Sichtfeld (FoV), Objektabstand, Brennweite, Blende und Blende sind einige der Begriffe, die häufig bei der Kategorisierung von Objektiven verwendet werden. Nachfolgend finden Sie eine kurze Erläuterung dieser Begriffe:

- Blickwinkel (AoV)

Der Betrachtungswinkel (AoV) bezieht sich auf die Winkelausdehnung eines Bereichs (in Grad), der durch das Objektiv betrachtet werden kann. AoV ist eine Spezifikation aller Objektive, die durch Fokussieren eines Objektivs auf unendlich bei Verwendung einer kompatiblen Sensorgröße abgeleitet wird. Für ein gegebenes Objektiv und eine gegebene Sensorgröße ist AoV konstant.

- Sichtfeld (FoV)

Field of View (FoV) bezieht sich auf die rechteckige Ausdehnung eines Bereichs, der durch das Objektiv betrachtet werden kann, aber FoV ist abhängig von der Brennweite und Objektentfernung. FoV beschreibt, was bei einer bestimmten Brennweite erfasst wird, im Gegensatz zur Fokussierung des Objektivs auf unendlich im Fall von AoV.

- Objekt Entfernung

Objektabstand ist der Arbeitsabstand zwischen dem Objektiv und dem Zielobjekt.

- Brennweite

Die Brennweite ist der Abstand zwischen Linse und Brennpunkt. Wenn der Brennpunkt auf dem Sensor liegt, ist das Bild scharf.

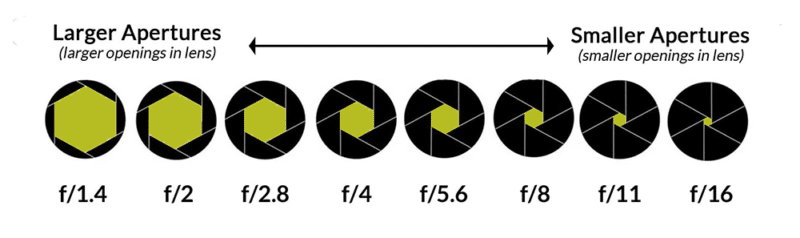

- Blende und Blende

Die Blende ist die Öffnung der Linse, die die Lichtmenge steuert, die den Sensor erreicht. Die Größe der Blende wird durch ihren Blendenwert gemessen. Ein großer Blendenwert bedeutet eine kleine Blendenöffnung und umgekehrt.

Arten von Linsen

1. Entozentrische / Endozentrische Linse – Diese Objektive haben eine feste Brennweite und sind die am häufigsten verwendeten Objektive in Bildverarbeitungskameras.

2. Makro-Objektiv - Makroobjektive sind für hohe Vergrößerungen ausgelegt und arbeiten im Allgemeinen im Vergrößerungsbereich von 05x bis 10x.

3. Telezentrisches Objektiv – Telezentrische Objektive haben keinen Abbildungswinkel und erzeugen ein senkrechtes Bild die Szene.

Kamera

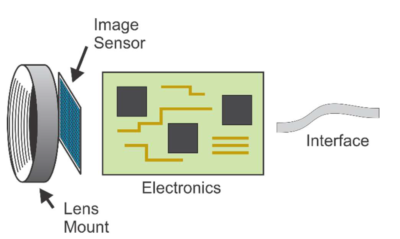

Als Kamera wird in der Bildverarbeitung eine Schutzhülle bezeichnet, die eine Objektivfassung, einen Bildsensor, einen Prozessor, Leistungselektronik und eine Kommunikationsschnittstelle enthält.

Das Herzstück jeder Kamera ist ein Bildsensor, der einfallendes Licht (Photonen) in elektrische Signale (Elektronen) umwandelt. Ein Bildsensor besteht aus Verfügbarmachen von Arrays aufgerufen „Photodioden“, die als Potentialtopf fungieren, wo die elektromagnetische Energie von Photonen in Mikrospannung umgewandelt wird. Diese Spannung wird dann an eine weitergegeben Analog-Digital-Wandler (ADC), der einen digitalen Wert ausgibt. Auf dem Markt erhältliche Bildsensoren können anhand des physikalischen Aufbaus (CCD/CMOS), der Pixelabmessungen (Area Scan/Line Scan), des Chroma-Typs (Color/Mono), des Shutter-Typs (Global/Rolling), des Lichtspektrums ( UV/SWIR/NIR) und Polarisation von Licht.

Jede Photodiode auf a Sensor entspricht einem Pixel eines digitalen Bildes. Während dem analogen Wert eine Photodiode zugeordnet ist, ist dem digitalen Wert ein Bildpixel zugeordnet. Ein Pixel ist das kleinste Element in einem digitalen Bild und ist eine Abkürzung für „Bildelement“. Auflösung, Intensität, Belichtung, Verstärkung und Bildrate sind einige der Grundkonzepte in Bezug auf die digitale Bildgebung, die nachstehend erörtert werden.

Digitale Bildkonzepte

- Auflösung - Ein digitales Bild besteht aus Pixeln. Die Bildauflösung ist ein Maß für die Anzahl der Pixelspalten und Pixelreihen in einem Bild. Eine Bildauflösung von 1280 x 1024 sagt uns, dass das Bild 1280 Pixel in der Breite und 1024 Pixel in der Höhe misst.

![]()

- Intensität – Die Helligkeit eines Bildpixels wird als Intensität bezeichnet. Je größer die Bit-Tiefe eines ADC, desto größer der Bereich zum Ausdrücken der Intensität. Wenn beispielsweise die Bittiefe eines ADC 8 Bit beträgt, stehen nur 2⁸ oder 256 (0 bis 255) Werte zur Verfügung, um die Intensität auszudrücken. Wenn die Bittiefe eines ADC jedoch 12 Bit beträgt, stehen jetzt 2¹² oder 4096 Werte zur Verfügung, um die Intensität auszudrücken.

- Exposition - Die Belichtung bezieht sich auf die Zeitdauer, während der eine Fotodiode Licht ausgesetzt ist. Die Belichtungszeit wird typischerweise in Mikrosekunden (µs) und Millisekunden (ms) gemessen.

- Gewinnen - Verstärkung ist die Verstärkung der Intensitätswerte für Pixel. Wenn die Stärke der Fotodiodenladung im Sensor erhöht wird, spricht man von analoger Verstärkung, und wenn der Pixelwert erhöht wird, nachdem die Ladung in einen digitalen Wert umgewandelt wurde, von digitaler Verstärkung.

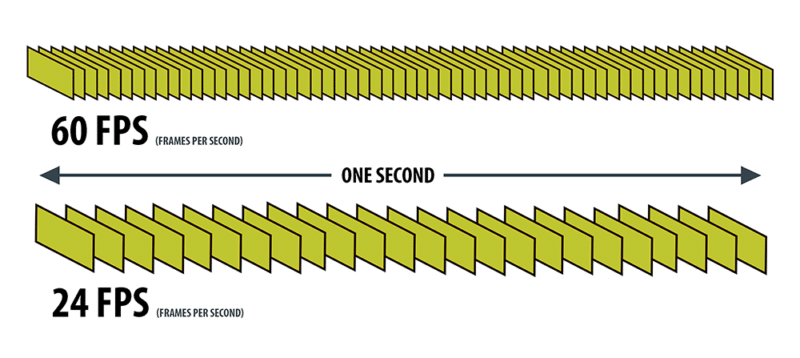

- Bildrate – Framerate gemessen in Bilder pro Sekunde oder FPS, ist die Anzahl der Bilder, die ein Sensor in einer Sekunde ausgeben kann.

Verkabelung

Ethernet

Ethernet ist eine LAN-Technologie (Local Area Network), die 1983 vom Institute for Electrical and Electronic Engineers (IEEE) als Standard 802.3 eingeführt wurde. IEEE 802.3 definiert die Spezifikation für die Medienzugriffssteuerung (MAC) der Bitübertragungsschicht und der Sicherungsschicht. Ethernet ist eine kabelgebundene Technologie, die Twisted-Pair-Kupferkabel (BASE-T) und Glasfaserkabel (BASE-R) unterstützt. In den folgenden Tabellen werden verschiedene Ethernet-Netzwerktechnologien basierend auf ihrer Geschwindigkeit und ihrem Kabel-/Transceivertyp aufgeführt.

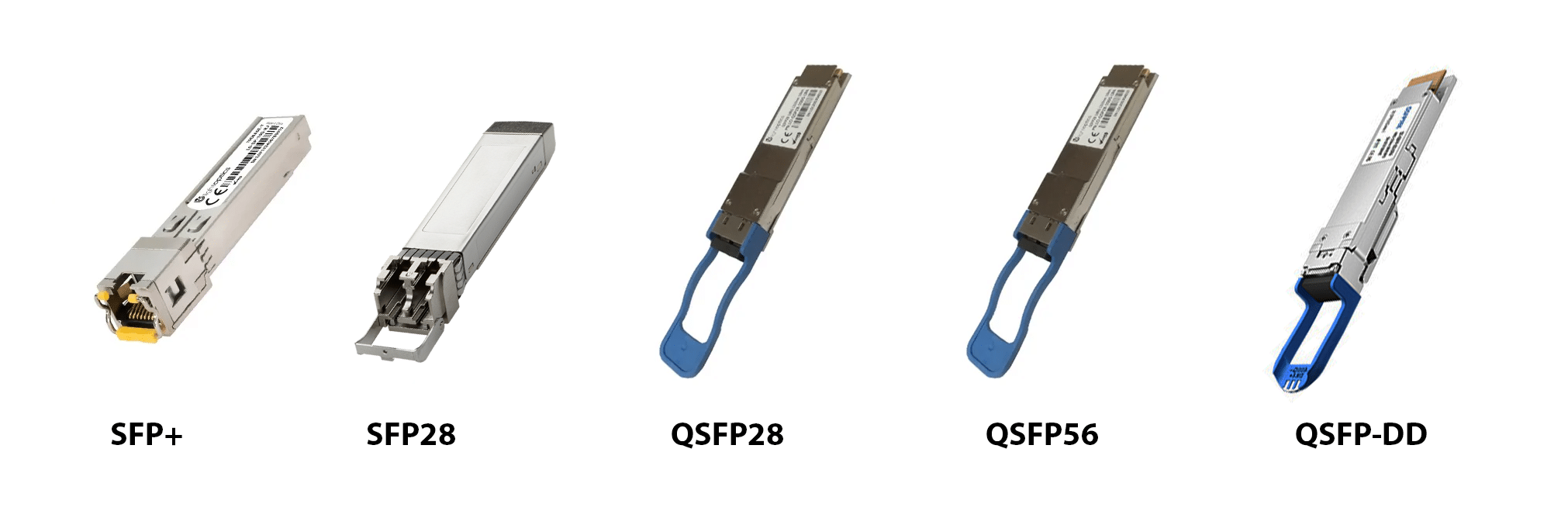

| Twisted-Pair-Kupferverdrahtung basierend auf BASE-T-Ethernet-Standards |

|---|

| Name | Schnelligkeit | Kabeltyp | Max. Kabellänge |

|---|---|---|---|

| 1000BASE-T | 1 Gbps | Cat5e Cat6 |

100 m |

| 10GBASE-T | 10 Gbps | Cat6A Cat7 Katze 7A |

100 m |

| Auf Glasfaserverkabelung basierende BASE-R-Ethernet-Standards |

|---|

| Name | Schnelligkeit | Transceiver-Typ | Max. Kabellänge |

|---|---|---|---|

| 10GBASE-R | 10 Gbps | SFP+ (1 Spur) | 80 km (ZR) |

| 25GBASE-R | 25 Gbps | SFP28 (1 Spur) | 80 km (ZR) |

| 50GBASE-R | 50 Gbps | QSFP28 (2 Spuren) SFP56 (1 Spur) |

80 km (ZR) |

| 100GBASE-R | 100 Gbps | QSFP28 (4 Lanes) SFP56 (2 Spuren) SFP-DD (2 Spuren) |

80 km (ZR) |

| 200GBASE-R | 200 Gbps | QSFP56 (4 Spuren) QSFP-DD (4 Spuren) |

80 km (ZR) |

| 400GBASE-R | 400 Gbps | QSFP56 (8 Spuren) QSFP-DD (8 Spuren) |

80 km (ZR) |

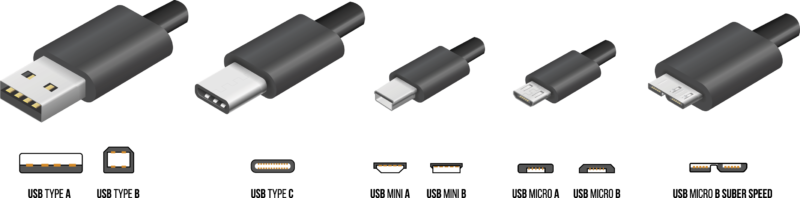

Universal Serial Bus (USB)

Der Universal Serial Bus (USB)-Standard wurde erstmals 1996 veröffentlicht und wird vom USB Implementers Forum (USB-IF) gepflegt. USB wurde entwickelt, um den Anschluss von Peripheriegeräten an PCs zu standardisieren. USB kann Peripheriegeräte wie z. B. kommunizieren und mit Strom versorgen Tastaturen, Mäuse, Videokameras und Drucker. Die folgende Tabelle erwähnt verschiedene USB-Standards und ihre Geschwindigkeiten.

| USB-Standards |

|---|

| Name | Schnelligkeit | Maximale Kabellänge |

|---|---|---|

| USB 2.0 | 480 Mbps | 5 m |

| USB 3.0 | 5 Gbps | 3 m |

| USB 3.1 Gen 1 | 5 Gbps | 3 m |

| USB 3.1 Gen 2 | 10 Gbps | 3 m |

| USB 3.2 (2 x 3.1 Gen 1) | 10 Gbps | 3 m |

| USB 3.2 (2 x 3.1 Gen 2) | 20 Gbps | 3 m |

| USB 4 | 40 Gbps | 0.8 m |

CoaXPress

CoaXPress (CXP) ist ein Punkt-zu-Punkt-Kommunikationsstandard zum Übertragen von Daten über ein Koaxialkabel. Der CoaXPress-Standard wurde erstmals auf der Vision Show 2008 in Stuttgart vorgestellt und wird derzeit von der JIIA (Japan Industrial Imaging Association) gepflegt. Die folgende Tabelle erwähnt verschiedene CXP-Standards.

| CoaXPress-Standards |

|---|

| Name | Schnelligkeit | Max. Kabellänge |

|---|---|---|

| CXP-1 | 1.25 Gbps | 212 m |

| CXP-6 | 6.25 Gbps | 60 m |

| CXP-12 | 12.5 Gbps | 40m |

| CXP-über-Glasfaser | 10 Gbps | 80 km |

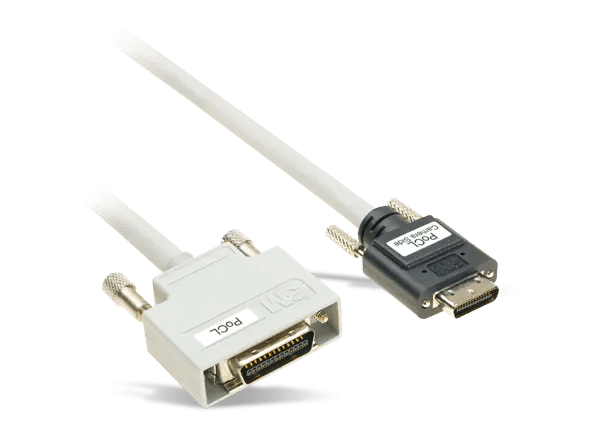

Kamera-Link

Camera Link ist ein Protokoll mit hoher Bandbreite, das für parallele Kommunikation entwickelt wurde. Es standardisiert die Verbindung zwischen Kameras und Frame Grabbern. Camera Link High-Speed (CLHS) entwickelte sich aus Camera Link und wurde erstmals 2012 eingeführt. Es liefert Echtzeitsignale mit geringer Latenz und geringem Jitter zwischen einer Kamera und einem Framegrabber und kann sowohl Bild- als auch Konfigurationsdaten übertragen sowohl für Kupfer- als auch für Glasfaserkabel.

| Camera Link-Standards |

|---|

| Name | Schnelligkeit | Max. Kabellänge |

|---|---|---|

| Kamera-Link-Basis | 2.04 Gbps | 10 m |

| Kameraverbindung voll | 5.44 Gbps | 10 m |

| Kamera Link Deca | 6.80 Gbps | 10 m |

| Camera Link HS (Hochgeschwindigkeit) | 25 Gbps | 80 km |

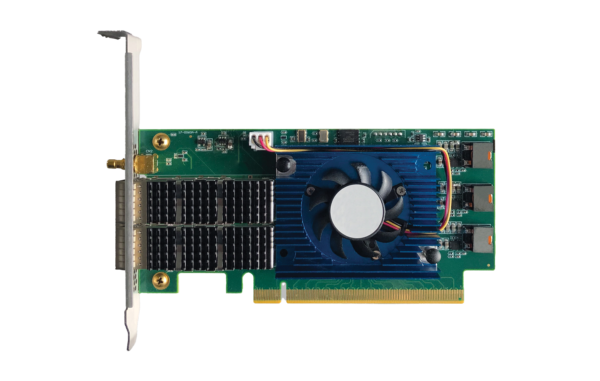

Schnittstellenperipherie

Ethernet

- Netzwerkschnittstellenkarte (NICs) - Ein Ethernet-Netzwerk Schnittstellenkarte (NIC) ist eine Erweiterungskarte, die über einen PCIe-Steckplatz mit einem Computer-Motherboard verbunden wird und die elektronischen Schaltungen für die Bitübertragungsschicht und die Sicherungsschicht des Open Systems Interconnection-Modells (OSI-Modell) implementiert.

- Switches - Ein Netzwerkschalter verbindet Ethernet-Geräte innerhalb desselben Local Area Network (LAN). Wenn ein Switch ein Paket von einem der Geräte empfängt, die mit seinen physischen Ports verbunden sind, liest der Switch seinen Header, gleicht dann die Zieladresse oder -adressen ab und sendet das Paket über die entsprechenden Ports an die Zielgeräte. Im Folgenden sind einige der Funktionen von Bildverarbeitungskameras aufgeführt, die die Verwendung eines Schalters erfordern:

-

- Multiplexing – In Hochgeschwindigkeitssystemen mit mehreren Kameras (z. B. Systemen mit 64 Kameras), bei denen jede Kamera große Mengen an Pixeldaten ausgibt, sind Switches erforderlich, um Pixeldaten, die von mehreren Ethernet-Ports kommen, zu konsolidieren und an einen Server oder Host-PC auszugeben Verwendung eines einzelnen Ports.

-

- Multicasting – Bildverarbeitungsanwendungen, die Multicasting verwenden, benötigen einen Switch, um Kameradaten an mehrere Host-PCs zu senden.

-

- Precision Time Protocol (PTP) – Ein Switch ist erforderlich, wenn Zeitstempel mehrerer Kameras mit der Uhr eines einzelnen Geräts synchronisiert werden müssen.

- Precision Time Protocol (PTP) – Ein Switch ist erforderlich, wenn Zeitstempel mehrerer Kameras mit der Uhr eines einzelnen Geräts synchronisiert werden müssen.

- Ethernet-Hubs - Ein Hub kann auch mehrere Geräte miteinander verbinden, um Ressourcen gemeinsam zu nutzen, und die Sammlung von Geräten, die an einen Hub angeschlossen sind, wird als LAN-Segment bezeichnet. Ein Hub unterscheidet sich von einem Switch dadurch, dass Pakete, die von einem der angeschlossenen Geräte gesendet werden, an alle Geräte gesendet werden, die mit dem Hub verbunden sind. Bei einem Switch werden Pakete nur an den Port geleitet, der zum adressierten Gerät führt.

- Motherboard-residente Ethernet-Ports – Heutzutage verfügen alle Motherboards über integrierte Ethernet-Ports, die hauptsächlich Geschwindigkeiten von 1 Gbit/s und in einigen Fällen auch Geschwindigkeiten von 5 Gbit/s und 10 Gbit/s unterstützen. Eingebaute Ethernet-Ports auf einem Motherboard werden aufgrund ihrer begrenzten internen Puffergröße und begrenzten Leistung nicht für Hochgeschwindigkeitsanwendungen empfohlen.

Universal Serial Bus (USB)

- USB-PCIe-Karten – USB-Karten sind PCIe-basierte Erweiterungskarten, die verwendet werden, um die Anzahl der USB-Ports an einem PC zu erhöhen. Auf dem Markt ist eine Vielzahl von USB-Karten erhältlich, die verschiedene USB-Standards wie USB 2.0 und USB 3.0 unterstützen und verschiedene USB-Anschlüsse wie USB-A, USB-B, USB-C und Micro-USB unterstützen.

- USB-Port-Hubs – USB-Hubs sind externe Geräte, die über einen USB-Stecker mit einem Computer verbunden werden und über USB-Buchsen verfügen. USB-Hubs fügen Ihrem Computer zusätzliche USB-Anschlüsse hinzu, sodass Sie zusätzliche USB-Geräte anschließen können.

- Motherboard-residente USB-Ports – Die meisten Motherboards sind heutzutage mit integrierten USB 3.0-Anschlüssen ausgestattet, wobei einige Motherboards immer noch sowohl USB 2.0 als auch USB 3.0 unterstützen.

CoaXPress

- Framegrabber – CoaXPress-Framegrabber „greifen“ einzelne Frames von einer Kamera und ermöglichen eine Vielzahl von High-End-Erfassungs- und Bildverarbeitungsfunktionen wie Echtzeitkomprimierung und die Möglichkeit, Regions Of Interest (ROI) für zusätzliche Bandbreitennutzung auszulagern.

Kameraverbindung & CLHS

- Framegrabber – Ähnlich wie CoaXPress-Framegrabber „greifen“ Camera Link-Framegrabber einzelne Frames von einer Kamera und umfassen verschiedene integrierte Verarbeitungsfunktionen wie programmierbare Region of Interest, Pixeldezimierung, Bildskalierung und Lookup-Tabellen.

Computerplattformen

Der Prozessor in einer Bildverarbeitungskamera ist normalerweise ein eingebetteter Prozessor oder ein Field Programmable Gate Array (FPGA), auf dem eine modellspezifische Firmware ausgeführt wird. Diese Firmware ist verantwortlich für das Lesen der Pixelwerte vom Bildsensor, die Implementierung von Bildsensorfunktionen, die Verarbeitung von Pixeldaten zur Erstellung eines vollständigen Bildes, die Anwendung von Bildverbesserungsalgorithmen und die Kommunikation mit externen Geräten zur Ausgabe eines vollständigen Bildes.

Der Prozessor in einer Kamera ist eingeschränkt zu Stromverbrauch minimieren ud Hitzeentwicklung reduzieren. Infolgedessen ist es in seiner Verarbeitungsfähigkeit begrenzt, wenn es darum geht, sehr hohe Bildraten zu verarbeiten und gleichzeitig nachbearbeitete Bilder auszugeben. Um große Mengen von Bilddaten, die von einem Sensor mit sehr hoher Bildrate stammen, nachzubearbeiten, werden diese Daten vorzugsweise zur Verarbeitung an ein externes System gesendet, anstatt Ressourcen des Kameraprozessors zu verwenden. Verschiedene Systeme, die bei der Nachbearbeitung von Bildern verwendet werden, sind:

- Consumer-PCs – Consumer-PC-basierte Systeme sind die flexibelsten und billigsten Optionen Standardkomponenten können verwendet werden, um ein System zu entwerfen. Bildverarbeitungskameras können über Schnittstellen wie Ethernet, USB, CoaXpress und Camera Link mit PC-basierten Systemen verbunden werden.

- Industrie-PCs – Industrie-PCs sind eingebaut in ein robustes Gehäuse zum Schutz vor Staub und Schmutz. Diese PCs halten Schock, Vibration und extremen Temperaturen im industriellen Umfeld stand. Ähnlich wie Consumer-PCs können Kameras auch an Industrie-PCs über Schnittstellen wie Ethernet, USB, CoaXpress und Camera Link angeschlossen werden.

- Vision Controller – Vision-Controller sind ebenfalls PC-basierte Systeme, bieten aber neben der PC-Funktionalität auch Unterstützung für serielle und E/A-Geräte. Vision-Controller verfügen über integrierte serielle und E/A-Schnittstellen wie RS232/RS485-Anschlüsse, analoge E/A und digitale E/A. Serielle und E/A-Schnittstellen ermöglichen eine einfachere Integration mit speicherprogrammierbaren Steuerungen (SPS) und industriellen Kommunikationsmodulen der C-Serie und ermöglichen die Implementierung von Kommunikationsprotokollen wie Modbus Serial. Einige Vision Controller verfügen auch über eine PWM-Funktion zur Steuerung der Beleuchtung. Die meisten Vision-Controller verfügen über Ethernet- und USB-Anschlüsse zum Anschließen von Bildverarbeitungskameras.

- Eingebettete Systeme - Eingebettete Systeme sind hochgradig konfigurierbare Computer, die so konzipiert sind, dass sie in andere größere Systeme wie autonome Fahrzeuge, Drohnen und medizinische Geräte eingebettet werden können. Da diese eingebetteten Systeme auch die gleichen Standardschnittstellen wie Ethernet und USB unterstützen, können sie einfach mit Bildverarbeitungskameras verbunden werden. Einige Beispiele für eingebettete Systeme sind NVIDIA Jetson Orin und NVIDIA Jetson Xavier.

- Arbeitsplatz-PCs – Workstation-PCs mit Prozessoren wie AMD Threadripper PRO oder Intel i9 sind die bevorzugte Wahl für den Aufbau von Multikamerasystemen, wenn es darum geht, Leistung und Kosten in Einklang zu bringen.

- Unternehmensserver – Unternehmensserver mit Prozessoren wie AMD EPYC und Intel Xeon können nicht nur die Verteilung von Pixeldaten von Hochgeschwindigkeitssystemen mit mehreren Kameras an Verarbeitungsknoten verwalten, sondern bieten auch eine außergewöhnliche Leistung für Bildverarbeitungs-Workloads.

- Cloudbasierte Systeme – Da die Komplexität von Bildverarbeitungsanwendungen beispielsweise durch den Einsatz von künstlicher Intelligenz zunimmt, können selbst PC-basierte Systeme die Verarbeitungsanforderungen teilweise nicht erfüllen. Hier kommen Cloud-basierte Verarbeitungsplattformen ins Spiel AWS, Azure und Google Cloud füllen die Lücke, da sie reichlich Ressourcen zur Skalierung der Verarbeitung bereitstellen.

Software

Während eine Bildverarbeitungskamera dafür verantwortlich ist, ein Bild aufzunehmen und an den Host-PC zu senden, ist eine Bildverarbeitungssoftware, die auf dem Host-PC ausgeführt wird, für Folgendes verantwortlich:

-

- Schnittstelle zur Kamera-Hardware

- Steuerung der Kamerafunktionen

- Empfangen, Verarbeiten und Analysieren von Bildern

- Entscheidungsfindung anhand von Bildergebnissen

- Kommunikation mit anderen angeschlossenen Geräten oder Maschinen, die eine Kameraeingabe benötigen

Die drei Kategorien von Imaging-Software in der Bildverarbeitung sind:

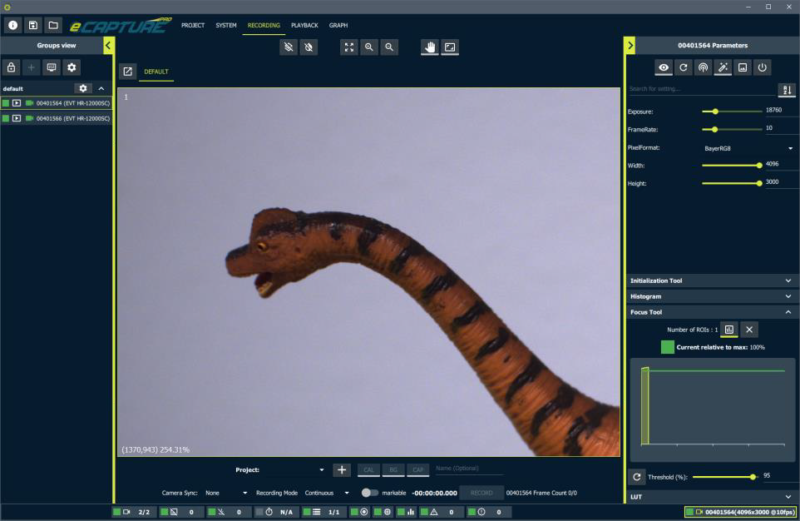

- Kamerabetrachter – Kamera-Viewer ist der benutzerfreundlichste und interaktivste Teil der Imaging-Software, der den schnellen Einstieg in eine Kamera erleichtert. Neben Netzwerkkonfiguration, Kamerakonfiguration, Bilderfassung, Verbesserung, Anzeige und Aufzeichnungsfunktionen bieten einige Imaging-Software auch erweiterte Tools zur Analyse von Bildern wie Histogramme und Liniendiagramme.

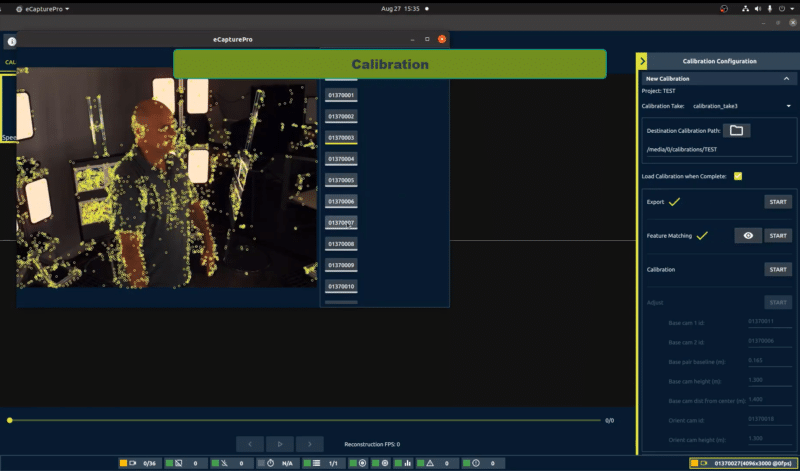

- Umfassende Software – Zusätzlich zu allen Funktionen eines Kamera-Viewers, a Umfassende Software bietet erweiterte Funktionen wie Projektmanagement, Multi-Kamera-Konfiguration, Multi-Server-Konfiguration, GPU-Unterstützung, 3D-Bildrekonstruktion und 3D-Objektbetrachter.

- Software Development Kit (SDK) – SDK ist eine Sammlung von Codebeispielen, Codebibliotheken, Anwendungsprogrammierschnittstellen (API), Dokumentationen und Complierern/Debuggern usw. Die meisten Machine-Vision-SDKs unterstützen die Programmiersprachen C/C++/C#/Python und können zur Entwicklung benutzerdefinierter Anwendungen für Windows und Linux verwendet werden und ARM-Plattformen.