Portal tecnológico

Portal tecnológico

Cámaras de visión artificial: cómo elegir la cámara adecuada para su aplicación de visión artificial

Gracias a las mejoras y la asequibilidad, los sistemas de visión artificial se han vuelto más útiles y accesibles para una amplia gama de aplicaciones. Sin embargo, se deben considerar una variedad de factores al seleccionar un sistema de cámaras industriales.

Conocer las especificaciones ópticas y de cámaras industriales es fundamental a la hora de intentar seleccionar la cámara adecuada para una aplicación de visión artificial. Después de todo, la relación entre el sensor y la lente permite que una cámara capture una imagen de un objeto adecuadamente iluminada. Durante una operación de procesamiento de imágenes industrial, el sensor de la cámara convierte la luz (fotones) de una lente en señales eléctricas (electrones). La señal resultante, generalmente generada utilizando un dispositivo de carga acoplada (CCD) o un sensor de imagen de semiconductor de óxido metálico complementario (CMOS), produce una imagen que consta de píxeles. Luego, los procesadores analizan la imagen, que se compone de píxeles oscuros causados por niveles bajos de luz y píxeles brillantes resultantes de niveles de luz más intensos.

Si bien cada proyecto de inspección por visión artificial es diferente, la mayoría de los desarrolladores de sistemas de inspección por cámara comienzan definiendo requisitos integrales, enumerando cada tarea de visión artificial y recopilando una variedad de piezas de muestra de las que se tomarán imágenes. Después de decidir lo que se debe lograr, como OCR (reconocimiento óptico de caracteres), lectura de códigos de barras, metrología, obtención de imágenes en color de alta calidad, observación de eventos de alta velocidad o alguna otra tarea, la fase de diseño generalmente comienza con la selección de una máquina de visión industrial. cámara.

Elegir cámaras para sistemas de inspección por cámara no es trivial. El panorama de las cámaras de visión artificial ha experimentado una rápida expansión en los últimos años, y numerosos fabricantes ofrecen una vertiginosa variedad de modelos de cámaras. Desde escaneo lineal, matriz de área, alta velocidad, alta resolución y analógico hasta ultravioleta (UV), monocromo, color, NIR, SWIR, IR, multiespectral e hiperespectral, cada tipo de cámara industrial cuenta con funcionalidades únicas.

Porque elegir la cámara de visión artificial adecuada (o cámara de visión por computadora) de las miles disponibles en el mercado puede ser una tarea desalentadora, este artículo tiene como objetivo facilitar la navegación a través de este entorno complejo y ayudar con la selección de la cámara óptima para abordar necesidades específicas. Este artículo aborda los factores clave que se deben considerar al seleccionar una cámara de visión artificial. No sólo aborda el tipo de radiación, la resolución, el tamaño de píxel, la eficiencia cuántica, la velocidad de cuadros, el tiempo de exposición, el tamaño de la cámara, la velocidad de transferencia de imágenes y otros factores, sino que también describe qué buscar cuando se trata de las tecnologías involucradas en la alta velocidad. Aplicaciones de visión artificial, como interfaces de cámaras y sus protocolos, tecnologías de procesamiento y software. Finalmente, explicará las diferencias entre las implementaciones GigE basadas en RDMA, TCP y UDP dentro del contexto de las cámaras de visión artificial de alta velocidad listas para RDMA disponibles en la actualidad para dichos sistemas.

Restricciones de la aplicación

Seleccionar la cámara industrial ideal requiere una cuidadosa consideración de múltiples factores, incluidos sus dimensiones físicas, peso y consumo de energía. Estas limitaciones pueden afectar significativamente las opciones, especialmente en aplicaciones únicas. Consideremos, por ejemplo, un robot móvil autónomo (AMR) encargado de mover artículos a través de un almacén. Este AMR necesita una cámara que sea pequeña, liviana y que ofrezca un bajo consumo de energía para maximizar el tiempo de funcionamiento. En este escenario, las limitaciones de tamaño y peso se convierten en puntos de decisión críticos.

Los factores ambientales también juegan un papel crucial en las comparaciones de cámaras. ¿Se utilizará la cámara en exteriores y será necesaria una carcasa para protegerla? ¿O funcionará en un ambiente interior controlado? Comprender las condiciones ambientales guiará la selección de las funciones de la cámara adecuadas para esas condiciones específicas. La velocidad del sujeto es otro factor que puede afectar significativamente la selección de la cámara. Para capturar movimientos rápidos y congelar la acción, las cámaras de alta velocidad son esenciales, ya que permiten un análisis detallado del movimiento del sujeto.

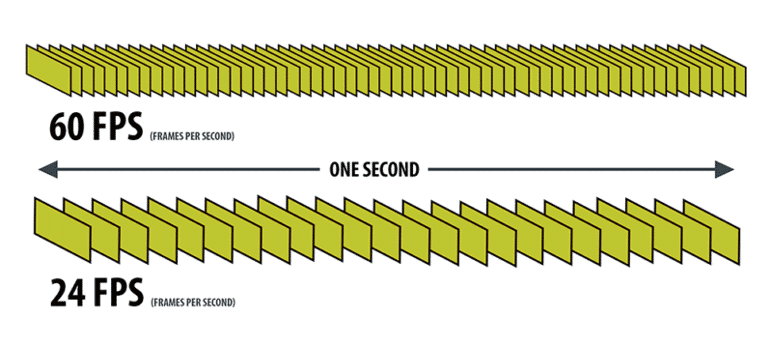

Si la luz brillante es limitada, considere cámaras con alta sensibilidad a la luz. Estas cámaras pueden capturar imágenes claras incluso con una mínima luz disponible, lo que las hace ideales para espacios reducidos o entornos con poca luz. Los factores adicionales a evaluar en las comparaciones de cámaras incluyen la velocidad de fotogramas, la resolución y el rango dinámico. La velocidad de fotogramas especifica cuántos fotogramas captura la cámara por segundo. Se necesitan velocidades de fotogramas más altas para capturar sujetos que se mueven rápidamente o para una reproducción fluida a cámara lenta. La resolución determina el detalle y la claridad de la imagen. Las resoluciones más altas capturan más detalles pero requieren espacio de almacenamiento de imágenes adicional. El rango dinámico se refiere a la capacidad de la cámara para capturar detalles en áreas brillantes y oscuras de la escena. Las cámaras de mayor rango dinámico producen imágenes con una iluminación más realista y menos luces apagadas o sombras perdidas.

Una mirada al interior de una cámara de visión artificial

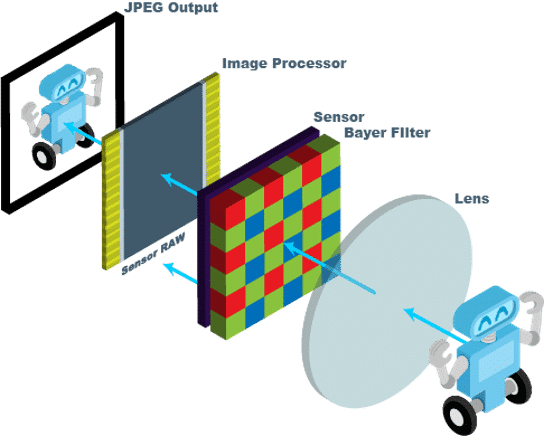

Abrir una cámara de visión artificial básica revela su funcionamiento interno. La mayoría de las cámaras de visión artificial se pueden dividir en dos partes principales: un conjunto de placas de circuito y el propio sensor de imagen. Las placas de circuito, comúnmente llamadas circuitos de fondo, manejan la lógica de funcionalidad de la cámara. Pueden incluir convertidores A/D (analógico a digital), amplificadores, relojes para exposición y velocidad de fotogramas, circuitos de lectura, FPGA (arreglos de puertas programables en campo), memoria y otros dispositivos. Piense en este circuito como el cerebro de la cámara, que maneja tareas como convertir señales, controlar el tiempo y almacenar las imágenes entrantes.

La interfaz de la cámara de visión artificial es esencialmente el sensor de imágenes. El sensor de imagen es el ojo de la cámara, captura la luz y genera la imagen. El sensor de imagen viene en dos versiones principales: sensores de luz visible (CCD o CMOS de silicio) y sensores infrarrojos (que utilizan varios otros materiales). Si bien esta discusión es aplicable para seleccionar cámaras de luz visible e infrarroja, no cubrirá muchos otros tipos de sensores, como sensores infrarrojos enfriados y no enfriados, hechos de una amplia variedad de materiales diferentes. En lugar de ello, nos centraremos en los sensores de luz visible, que son como esponjas de silicona que absorben la luz y la convierten en imágenes digitales.

Radiación electromagnética

El ojo humano, como una pequeña ventana al mundo, sólo deja entrar una porción del gran espectro electromagnético. Afortunadamente, las cámaras se han convertido en poderosas extensiones que permiten ver mucho más allá de las limitaciones de la visión. Imagine un vasto espectáculo de luces cósmicas, donde cada banda del espectro desempeña un papel único. Cada banda del espectro tiene una longitud de onda específica y estas longitudes de onda dictan lo que es visible.

Piense en las longitudes de onda como una regla para el universo. Las longitudes de onda más cortas, como las de los rayos ultravioleta o los rayos X, pueden resolver detalles increíblemente pequeños, como los intrincados patrones del ala de una mariposa o la delicada estructura de un virus. Por otro lado, las longitudes de onda más largas, como la infrarroja, tienen dificultades para distinguir los detalles finos. Son excelentes para detectar señales de calor, revelar la presencia de humanos o incluso una taza de café caliente en la oscuridad. Pero para acercarse a las estructuras microscópicas, se quedan cortos.

Las aplicaciones específicas requieren cámaras especializadas. Por ejemplo, ciertas funciones de imágenes y visión artificial exigen cámaras con una sensibilidad que supere el espectro de luz visible. Alternativamente, algunas tareas requieren cámaras equipadas para examinar materiales altamente reflectantes como el vidrio. Para los integradores de sistemas que buscan cámaras de escaneo de área con sensibilidad más allá del espectro de la luz visible y al mismo tiempo que funcionan a altas velocidades y altas tasas de datos, Emergent Vision Technologies ofrece cámaras multiespectrales de 10GigE y 25GigE con sensibilidad ultravioleta, así como cámaras de 10GigE con sensores de imagen polarizados con Sensores Sony CMOS.

Tanto el 25GigE Bolt HB-8000-SB-U y el 10GigE HR-8000-SB-U Utilice el sensor de imagen CMOS UV Pregius S IMX8.1 de 487 MP de Sony, que ofrece una mayor sensibilidad dentro del espectro UV que abarca de 200 nm a 400 nm. El IMX487, un sensor CMOS de 2/3″ con funcionalidad de obturador global, captura eficientemente la luz ultravioleta. Al emplear una estructura de píxeles retroiluminada en un sensor CMOS apilado como otros sensores Sony Pregius S, ofrece capacidades de imágenes rápidas y sin distorsiones.

El 25GigE HB-8000-SB-U alcanza una velocidad de cuadros de 201 fps, mientras que el 10GigE HR-8000-SB-U alcanza 145 fps. Estas cámaras GigE Vision, que cumplen con los estándares GenICam, están diseñadas para aplicaciones de imágenes multiespectrales, incluida la inspección de semiconductores, clasificación de residuos de plástico, inspección de cables de alto voltaje, inspección de impresiones, microscopía de alta resolución y espectroscopia de luminiscencia.

Entonces, ¿cómo capturan las cámaras imágenes de estos mundos visibles e invisibles? El viaje comienza con la radiación electromagnética, comúnmente conocida como luz. Cuando la luz llega a un píxel, desencadena la generación de un electrón libre. El objetivo de la obtención de imágenes es convertir fotones en electrones, retenidos dentro del píxel, actuando de forma similar a un condensador. A medida que continúa incidiendo más luz, se producen y almacenan electrones libres adicionales como cargas dentro de estos píxeles hasta que finalmente se recuperan durante el proceso de lectura.

Capacidad total del pozo: ¿cuánta luz puede soportar un píxel?

¿Alguna vez has visto un objeto brillante irradiar su luz hacia las áreas circundantes en una imagen? Eso se llama florecer y ocurre cuando un píxel se sobrecarga de luz, como un balde desbordado. La cantidad máxima de luz que un píxel puede manejar antes de florecer se denomina capacidad total de pozo (FWC). Es como el tamaño de ese cubo, medido en pequeñas partículas cargadas llamadas electrones. Cuando el píxel está totalmente saturado y no puede retener más carga, se dice que ha alcanzado su FWC.

Las hojas de datos suelen definir el FWC de un sensor en términos de cuántos electrones se necesitan para alcanzar ese estado. Por ejemplo, el FWC de un sensor puede ser de 20,000 electrones. Si las hojas de datos de la empresa de cámaras no incluyen el FWC para una cámara determinada, la empresa de cámaras podría indicar qué sensor utiliza. De lo contrario, consulte a la empresa de la cámara y obtenga la hoja de datos del sensor de imagen de la fundición, que debe especificar el FWC. Conocer el CM es crucial para diferentes aplicaciones:

Imágenes con poca luz: En condiciones de poca luz, cada fotón cuenta. Un sensor con un FWC alto puede capturar detalles débiles incluso con velocidades de obturación más largas, evitando el ruido y el granulado y permitiendo imágenes más claras incluso en la oscuridad.

Imágenes de alto rango dinámico: Los sensores FWC altos permiten que las cámaras capturen una gama más amplia de intensidades de luz sin recortar las luces brillantes (blancos apagados). Piense en las cámaras utilizadas en vehículos autónomos que tienen que navegar a través de un túnel oscuro y emerger de manera segura a un paisaje urbano con un sol brillante y sombras profundas. Un sensor FWC alto puede retener los detalles en ambos extremos sin recortes, creando imágenes más ricas y realistas.

Imágenes científicas: Los valores FWC precisos son vitales para realizar mediciones precisas en aplicaciones de investigación. Captar el delicado brillo de la Vía Láctea o las galaxias distantes requiere un sensor que pueda manejar la amplia gama de niveles de luz en el cielo nocturno. Para aplicaciones como astronomía o imágenes médicas, donde capturar señales débiles es crucial, un sensor FWC alto es esencial.

Los circuitos de sensores deciden cuándo permitir que esta luz comience a crear electrones, lo que se llama integración, y cuándo detenerse. El circuito eléctrico enciende o apaga el píxel, iniciando y deteniendo la generación de voltaje proporcional a la cantidad de carga acumulada en cada pocillo. Finalmente, la señal se puede leer a partir de los píxeles en una fila lineal a una velocidad de línea específica, o a una velocidad de fotogramas específica cuando se lee un conjunto de píxeles de área completa.

Eficiencia cuántica y relación señal/ruido

La capacidad de los píxeles para convertir fotones en electrones se denomina eficiencia cuántica (QE). Cuando los fotones entran en los píxeles, generan electrones. Sin embargo, al mismo tiempo el calor y otros factores también generan algunos electrones, lo que se denomina ruido. El objetivo de cada píxel es generar más electrones a partir de la luz que del calor y otros factores. En otras palabras, los sensores de imagen con más señal (electrones de la luz) que ruido (electrones del calor y otros factores) tienen una relación señal-ruido (S/N) alta.

Los sensores de imagen con una relación S/N alta, poco ruido y un FWC grande tendrán un rango dinámico amplio. El rango dinámico es la relación entre la carga máxima y mínima medida. Durante la lectura, se produce la conversión de voltaje analógico a número digital, o A/D. Por ejemplo, si el circuito posterior de una cámara tiene la capacidad de proporcionar una conversión analógica a digital de 8 bits, proporciona un potencial de 256 (o 28) niveles. Si la carga del píxel leída es 0, no tiene electrones y es negra. Si el píxel está completamente saturado y en su carga máxima, es blanco y tiene un recuento de 255.

El A/D determina cuántas divisiones en escala de grises existen. Una S/N baja significa que se pierde mucha señal en el ruido, en la oscuridad. Por ejemplo, sería difícil diferenciar una característica de un objeto que sólo contrasta ligeramente con su fondo y las partes circundantes. Sin embargo, un A/D de 10 bits es 210 = 1024. Si hay una diferencia sutil en la escala de grises entre la característica de interés y el área circundante, una mayor cantidad de divisiones en escala de grises aumentará la probabilidad de poder diferenciar la característica.

Pixel Tamaño

Los píxeles más grandes suelen tener la ventaja en la calidad de la imagen. En comparación con los píxeles más pequeños, en general, los píxeles más grandes cuentan con una relación S/N y un rango dinámico más altos gracias a sus "cubos" más grandes para recolectar electrones. Más superficie también se traduce en capturar más electrones. Sin embargo, este beneficio tiene un precio: los píxeles más grandes aumentan el costo del sensor. ¿Por qué los sensores más grandes son más caros? Piense en la oblea de silicio, donde están grabados múltiples sensores. El coste de producir esta oblea se divide entre todos los sensores que produce. Los píxeles más pequeños permiten colocar más sensores en una sola oblea, lo que reduce efectivamente el costo por sensor. Por este motivo, los sensores más pequeños son significativamente más baratos que sus homólogos más grandes.

Más allá del escenario ideal, el rendimiento de las fábricas también desempeña un papel crucial. No todos los sensores fabricados son perfectos y el menor volumen de producción de sensores grandes amplifica el impacto de los defectos. Unos pocos píxeles defectuosos en un lote tan limitado pueden reducir significativamente la cantidad de sensores utilizables. Por lo tanto, elegir “lo mejor y lo más grande” no siempre es el enfoque más sensato. Si bien los píxeles más grandes ofrecen ventajas de rendimiento, los más pequeños pueden ser una alternativa rentable, especialmente cuando entran en juego limitaciones de tamaño o preocupaciones presupuestarias.

Tamaño de la cámara

El tamaño de la cámara juega un papel crucial en el rendimiento de la cámara, pero las convenciones de nomenclatura pueden resultar confusas. Términos como “un cuarto de pulgada” y “media pulgada” pueden parecer obsoletos, especialmente cuando las dimensiones reales están en milímetros. Entonces, ¿de dónde vienen estos términos y qué significan realmente? Estos términos se remontan a la era de la fotografía cinematográfica. Los tamaños de película estándar (8 mm, 16 mm y 35 mm) utilizaban aperturas de diámetros específicos. Las lentes de las cámaras fueron diseñadas para proyectar un círculo de imagen sobre la película dentro de estas aperturas.

Estos términos simplemente representan las dimensiones diagonales aproximadas de los sensores de imagen, haciendo referencia al formato de película equivalente. Por ejemplo, un sensor de media pulgada corresponde aproximadamente a la diagonal de un fotograma de película de 16 mm. Si bien la convención de nomenclatura tiene su origen en la película, los tamaños reales de los sensores se miden en milímetros para mayor precisión. Esto permite realizar comparaciones y cálculos de compatibilidad más precisos con lentes y otros componentes de la cámara.

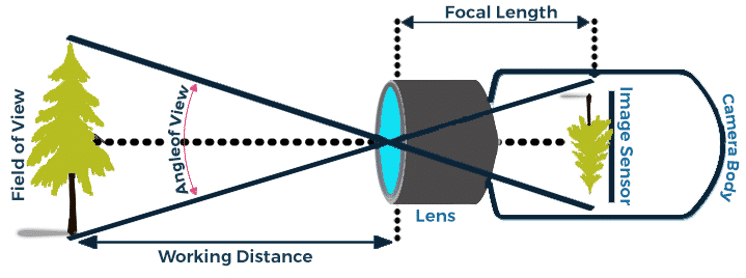

Tamaño diagonal del sensor

La dimensión más importante a la hora de elegir una lente es el tamaño diagonal del sensor. Esto determina el diámetro mínimo del círculo de imagen que la lente debe proyectar para cubrir todo el sensor. Las cámaras suelen especificar los tamaños de los sensores utilizando estos términos familiares de “un cuarto de pulgada” a “una pulgada”, pero es importante consultar el manual o el sitio web del fabricante para conocer la medida diagonal real en milímetros.

La lente debe proyectar un círculo de imagen que cubra completamente la diagonal del sensor. La dimensión diagonal del sensor influye directamente en el círculo de imagen requerido por la lente. Un sensor de una pulgada exige una lente con al menos un círculo de imagen de una pulgada para evitar viñeteados o una captura de imagen incompleta. Si bien se pueden utilizar lentes más grandes, su círculo de imagen puede exceder el área del sensor, lo que genera un desperdicio de potencial de resolución. Por el contrario, el uso de una lente más pequeña en un sensor más grande ilumina solo una parte central, lo que reduce el campo de visión.

En aplicaciones de metrología, donde las mediciones precisas son primordiales, puede resultar ventajoso sobredimensionar intencionalmente la lente en relación con el sensor. Esto aprovecha la región central de alto rendimiento de la lente para una resolución de detalle óptima. Elegir una lente con un círculo de imagen más pequeño provocará viñetas (esquinas oscuras) o incluso imágenes recortadas. Por el contrario, un círculo de imagen mucho más grande de lo necesario podría ser excesivo y afectar el rendimiento o el costo.

Comprender el tamaño del sensor y su relación con la compatibilidad de la lente es crucial para una selección informada de la cámara. No confíe únicamente en las etiquetas de “un cuarto de pulgada” o “media pulgada”; Siempre verifique la medida diagonal y asegúrese de que la lente elegida pueda cubrir el sensor adecuadamente. Sin embargo, si no hay disponible una lente compatible con la cámara especificada, es posible que el diseñador tenga que elegir una cámara diferente.

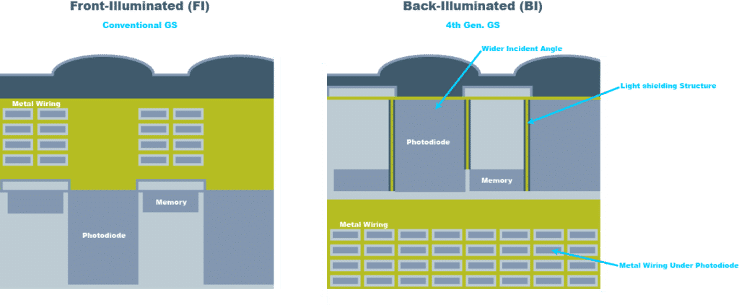

Las microlentes mejoran el rendimiento de los píxeles más pequeños

¿Alguna vez te has preguntado cómo los sensores de las cámaras se vuelven cada vez más pequeños y más potentes sin dejar de capturar detalles sorprendentes? Parte de la magia reside en pequeñas lentes llamadas microlentes colocadas encima de cada píxel. Imagine una sección transversal del sensor de una cámara. En la parte inferior se encuentra la oblea de silicio, donde residen los píxeles. Estas pequeñas áreas sensibles a la luz son como cubos que recolectan fotones para crear la imagen que ves. Encima de los píxeles se encuentra una capa de intrincado cableado metálico. Estas "venas" transportan señales eléctricas que controlan cada píxel, indicándoles cuándo comenzar y dejar de recolectar luz y, en última instancia, cómo traducir esos datos en una imagen.

Para las cámaras en color, una capa especial de filtros rojos, verdes y azules se coloca encima de los píxeles. Estos filtros actúan como pequeñas puertas, permitiendo que solo pasen longitudes de onda de luz específicas, creando la información de color para cada píxel. Ahora, imagine rayos de luz que ingresan al sensor en varios ángulos. Algunos podrían pasar por alto los pequeños cubos de píxeles y escapar de la captura. ¡Entra en las microlentes! Estas lentes en miniatura se ubican encima de cada píxel, como pequeñas lupas. Ellos doblan y enfocan los rayos de luz, asegurando que incluso los que entran en ángulo lleguen a la zona sensible a la luz.

Captura más luz

Las microlentes aumentan significativamente la cantidad de luz capturada por cada píxel, lo que produce dos cosas: mayor sensibilidad y mejor resolución. Con una sensibilidad mejorada, los sensores pueden capturar más detalles, incluso en condiciones de poca luz. La resolución mejorada garantiza que más luz se traduzca en imágenes más nítidas y claras con detalles más finos. Sin embargo, este aumento del rendimiento tiene un costo. Las microlentes son accesorios permanentes unidos al sensor. Si bien aumentan la captura general de luz, también pueden bloquear la luz ultravioleta.

Algunas microlentes están hechas de materiales que absorben la luz ultravioleta, lo que limita la capacidad del sensor para capturar ciertos tipos de información. Las microlentes también limitan la flexibilidad de las lentes. La naturaleza fija de las microlentes restringe el uso de ciertos tipos de lentes que podrían requerir interacción directa con la superficie del sensor.

Las microlentes varían en tamaño y forma según el sensor específico y su uso previsto. Los avances en la tecnología de microlentes continúan y los investigadores exploran nuevos materiales y diseños para superar las limitaciones actuales.

Las microlentes son una innovación crucial en la tecnología de sensores, ya que permiten sensores más pequeños y más eficientes sin sacrificar la calidad de la imagen. Pero su naturaleza permanente y las posibles limitaciones en la sensibilidad a los rayos UV y la compatibilidad de las lentes son factores importantes a considerar. La elección entre un sensor con o sin microlentes depende de sus necesidades y prioridades específicas. Para condiciones de poca luz o aplicaciones que requieren alta resolución, las microlentes ofrecen ventajas significativas.

Sensores retroiluminados

La búsqueda de capturar más luz y lograr una calidad de imagen asombrosa en sensores compactos ha dado lugar a innovaciones interesantes. Uno de esos avances es el sensor retroiluminado con microlentes. Esta tecnología invierte el guión del diseño de sensores tradicional y ofrece varias ventajas. Imagine la sección transversal de un sensor. Normalmente, las microlentes se sitúan encima de los píxeles, recogen la luz y la dirigen a través de capas de cableado metálico antes de llegar a las zonas sensibles a la luz. En los sensores retroiluminados los papeles se invierten. Las microlentes están integradas con los filtros de color en la parte posterior del sensor, lo que permite que la luz ingrese directamente a los píxeles sin atravesar el cableado metálico.

Permitir que los fotones entren en la parte trasera del sensor mejora enormemente la relación señal/ruido. Los beneficios incluyen una mayor captura de luz, una sensibilidad mejorada y un rango dinámico mejorado. La eliminación del obstáculo del cableado metálico aumenta significativamente la cantidad de luz que llega a cada píxel, lo que resulta en una sensibilidad mejorada para capturar imágenes más nítidas en condiciones de poca luz y un rango dinámico mejorado para una mejor captura de detalles en áreas brillantes y oscuras de una escena.

Obleas adelgazantes

Para implementar eficazmente esta tecnología de sensor retroiluminado, es necesario adelgazar el sustrato de silicio para permitir que la luz pase a través de él con una absorción mínima. Sin embargo, el adelgazamiento de las obleas es un proceso delicado, a menudo considerado una “receta secreta” en las fundiciones. Ocurre después de que se haya fabricado todo el sensor, lo que hace que cualquier error sea costoso. Imagine la transición del mundo controlado del procesamiento de películas delgadas al vacío gaseoso al mundo desordenado del lapeado mecánico con una suspensión. Este enfoque poco convencional, similar al pulido de un diamante, puede parecer inusual en una fundición de semiconductores, pero es crucial para lograr la delgadez deseada. Sin embargo, existen varios desafíos y compensaciones.

Si bien los sensores retroiluminados con microlentes ofrecen ventajas significativas, todavía existen algunos desafíos, incluidas las limitaciones de la sensibilidad UV y una mayor complejidad y costos debido a los pasos de procesamiento adicionales y las técnicas especializadas involucradas en la fabricación de estos sensores. A pesar de estos desafíos, la tecnología de sensores retroiluminados con microlentes representa un gran avance en el rendimiento de los sensores.

Sin embargo, dado que los sensores retroiluminados se han vuelto más comunes en las cámaras de los teléfonos, un aumento significativo en la investigación y el desarrollo ha llevado a nuevas mejoras en la eficiencia, la sensibilidad y la sensibilidad a los rayos UV, allanando el camino para soluciones de imágenes aún más sorprendentes y versátiles. Los últimos sensores CMOS utilizan materiales y diseños de microlentes específicos en sensores retroiluminados que pueden optimizar aún más la sensibilidad a los rayos UV. Las técnicas alternativas de raleo también han ayudado a mejorar el rendimiento y reducir los costos.

Si bien tecnologías como los CCD multiplicadores de electrones (EMCCD) y la integración de retardo de tiempo (TDI) ofrecen una sensibilidad aún mayor, son más complejas y quedan fuera del alcance de esta discusión. No obstante, es importante saber que existen varias técnicas disponibles que pueden mejorar significativamente el rendimiento en condiciones de poca luz en tipos específicos de cámaras.

Sensores de persiana enrollables versus sensores globales

No todas las cámaras son iguales. La industria ofrece dos opciones: persianas enrollables y globales. Cuando se trata de capturar objetos o procesos web de alta velocidad, la elección del sensor es crucial. En general, elegir el sensor adecuado depende de las limitaciones de la aplicación específica, como la velocidad y la precisión.

Una persiana enrollable es como un escáner rápido que lee líneas de datos una tras otra. Los sensores de persiana enrollable son excelentes para muchas tareas cotidianas de captura de imágenes y para capturar imágenes fijas. Pero para movimientos de alta velocidad o mediciones precisas, los objetos de la imagen pueden distorsionarse.

Se puede considerar un obturador global como una cámara que captura toda la escena a la vez, como una instantánea, lo cual es perfecto para capturar objetos que se mueven rápidamente sin distorsión. Los sensores de obturador global son ideales para aplicaciones científicas y mediciones precisas.

Cámaras de exploración lineal

¿Alguna vez te has preguntado cómo las cámaras capturan imágenes de cosas que se mueven sobre cintas transportadoras? Las cámaras de escaneo de línea son una forma de realizar esta tarea. Las cámaras de escaneo de líneas utilizan un sensor de imagen lineal 1D para capturar una sola línea de la imagen a la vez, a partir de la cual construye una imagen 2D para su análisis. Las cámaras de escaneo lineal se utilizan a menudo para facilitar la inspección de los objetos en movimiento que pasan. Piense en estas cámaras como un rayo láser que escanea una sola línea a alta velocidad. Las cámaras de escaneo de línea son ideales para procesos web como la inspección de productos en cintas transportadoras. Las cámaras de escaneo de líneas crean una imagen completa línea por línea. Para ello, deben estar sincronizados con el movimiento del objeto.

Así es como funciona: imagine una cinta transportadora con un paquete moviéndose sobre ella. Una cámara de escaneo de líneas tiene un sensor largo y delgado que, cuando está equipado con la lente adecuada, capturará una imagen que abarca todo el ancho del transportador y captura una sola línea de píxeles a la vez. Si el paquete no se mueve, la cámara solo captura una línea de la imagen, lo que dificulta discernir muchos detalles del paquete. Sin embargo, a medida que el paquete se mueve, la cámara captura línea tras línea, creando una imagen completa.

Cuando la cámara de escaneo lineal se activa en sincronía con el movimiento, se puede producir una imagen durante el tiempo que sea necesario. Esto proporciona a las cámaras de escaneo lineal la capacidad de capturar de forma rentable imágenes de alta resolución de objetos grandes. Además de objetos grandes en movimiento, las cámaras de escaneo lineal también se pueden utilizar para fotografiar objetos cilíndricos en rotación. Si el movimiento es constante o se puede utilizar un sensor o codificador de velocidad, entonces una cámara de escaneo lineal puede resultar rentable.

Emergent ofrece una gama de cámaras de escaneo de líneas en configuraciones de 10GigE, 25GigE y 100GigE, diseñadas para satisfacer las rápidas demandas de las necesidades contemporáneas de imágenes de escaneo de líneas. Estas familias de cámaras garantizan una implementación confiable y brindan capacidades de generación de imágenes sin copias ni pérdida de datos. La gama incluye varios modelos, empezando por el LR-4KG35 Cámara de escaneo de línea 10GigE, capaz de alcanzar velocidades de 172KHz, al LZ-16KG5 Cámara de escaneo de línea 100GigE, que alcanza una velocidad rápida de 400KHz.

Imágenes rentables de alta resolución

Las cámaras de escaneo de línea ofrecen una ventaja sorprendente en términos de coste. Lo logran empaquetando más píxeles en una sola oblea en comparación con las cámaras de área. Debido a que la tecnología de escaneo de líneas solo captura una línea a la vez, permite una colocación de píxeles más densa, lo que se traduce en más píxeles por oblea. Los sensores de escaneo de líneas suelen estar disponibles con 2000, 4000 e incluso 16,000 XNUMX píxeles. Conjuntos de áreas comparables serían gigantescos e increíblemente caros.

En general, un sensor de escaneo de líneas de 1K es menos costoso que un conjunto de áreas de 1K debido a la mayor densidad de empaquetado, lo que resulta en un menor costo por píxel. Si la aplicación implica imágenes de alta resolución de objetos en movimiento (por ejemplo, cintas transportadoras) y el movimiento se puede controlar, las cámaras de escaneo lineal son una opción rentable. Las cámaras de escaneo de líneas también son capaces de capturar información de color.

Sin embargo, existen ciertas limitaciones asociadas con una cámara de escaneo lineal. La iluminación debe ser precisa y la apertura de la cámara debe permanecer abierta la mayor parte del tiempo, lo que reduce la profundidad de campo y dificulta la captura de objetos a diferentes distancias de la cámara.

Cámaras de exploración de área

Mientras que las cámaras de escaneo lineal brillan cuando los objetos se mueven a una velocidad constante, lo que permite una captura de imágenes precisa y un procesamiento de imágenes eficiente, las cámaras de escaneo de área son mejores para objetos estacionarios y escenas con movimientos impredecibles y requisitos de mayor profundidad de campo. Las cámaras de escaneo de área con sensores de escaneo de área tienen una gran matriz o conjunto de píxeles que produce una imagen 2D en una sola exposición.

En comparación con las cámaras de escaneo lineal, las cámaras de escaneo de área generalmente requieren menos luz y la iluminación suele ser más fácil de instalar debido al campo de visión rectangular. Además, las cámaras de escaneo de área pueden capturar imágenes de exposición corta utilizando iluminación estroboscópica, que lleva grandes cantidades de luz al sensor rápidamente. La mayoría de las aplicaciones de adquisición de imágenes utilizan cámaras de escaneo de área.

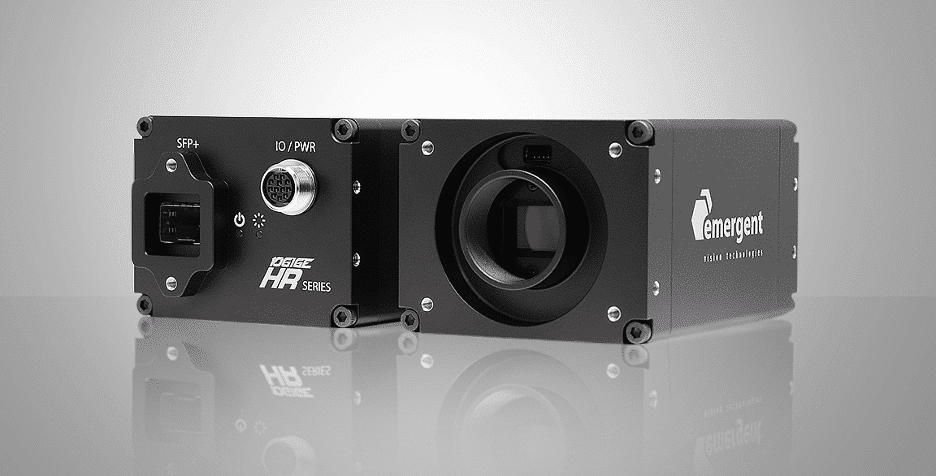

Algunas aplicaciones pueden requerir cámaras de alta resolución, particularmente en situaciones donde es esencial la visualización precisa de pequeños detalles o la inspección exhaustiva de piezas grandes. Para satisfacer estos requisitos, Emergent presenta una amplia gama de modelos de alta resolución que abarcan varias familias de cámaras, como las cámaras Eros 5GigE, HR 10GigE y Bolt 25GigE.

Estos modelos incorporan sensores IMX avanzados de la serie Sony Pregius S, que incluyen:

- 1 MP IMX547: Cámara HE-5000-SBL 5GigE (45.5 fps), Cámara HR-5000-SBL 10GigE (99fps)

- 1 MP IMX546: Cámara HE-8000-SBL 5GigE (36.5 fps), Cámara HR-8000-SBL 10GigE (73fps)

- 4 MP IMX545: Cámara HE-12000-SBL 5GigE (34 fps), Cámara HR-12000-SBL 10GigE (68fps)

- 13 MP IMX542: Cámara HE-16000-SBL 5GigE (26 fps), Cámara HR-16000-SBL 10GigE (52fps)

- 28 MP IMX541: Cámara HE-20000-SBL 5GigE (21.5 fps), Cámara HR-20000-SBL 10GigE (43fps)

- 47 MP IMX540: Cámara HE-25000-SBL 5GigE (17.5 fps), Cámara HR-25000-SBL 10GigE (35fps)

La serie 25GigE Bolt también aprovecha el IMX5.1 de 537MP en su HB-5000-SB (269 fps), 8.1MP IMX536 en su HB-8000-SB (201 fps), 12.3MP IMX535 en su HB-12000-SB (192 fps), 20.28MP IMX531 en su HB-20000-SB, y el IMX24.47 de 530MP en su HB-25000-SB (98 fps). Las opciones disponibles se extienden a resoluciones más altas con cámaras como la Zenith HZ-100-G (103.7 MP Gpixel GMAX32103) y Perno HB-127-S (Sony IMX127.7 de 661 MP).

Las opciones de interfaz y conectividad también pueden afectar significativamente la elección de la cámara, al igual que la facilidad de uso de la cámara, las opciones de control y los puertos de conectividad disponibles para integrarla con otros sistemas. Más allá de los factores discutidos anteriormente, varias consideraciones adicionales pueden afectar significativamente la selección de su cámara.

Color versus monocromo

Si bien la reproducción del color puede ser importante para determinadas aplicaciones, como el diagnóstico médico, las cámaras monocromáticas suelen presentar una alternativa viable. En general, las cámaras monocromáticas ofrecen varias ventajas. Por lo general, presentan una mayor sensibilidad a la luz que las cámaras en color, lo que permite un mejor rendimiento en condiciones de poca luz. Además, las cámaras monocromáticas son generalmente más asequibles que sus homólogas en color y las imágenes monocromáticas requieren menos espacio de almacenamiento, lo que las hace preferibles para aplicaciones donde el almacenamiento de datos es limitado.

Las cámaras en color más comunes son las de un solo chip y un solo sensor. El patrón de filtro predominante empleado se conoce como patrón de Bayer. Dentro de este patrón, los filtros rojos cubren un píxel, dos filtros verdes abarcan dos píxeles y un filtro azul se superpone a otro píxel. Entonces, por cada píxel, hay uno equipado con un filtro rojo, dos con verde y uno con azul. Se utilizan dos filtros verdes porque el ojo humano responde mejor a las longitudes de onda verdes. Esto ayuda al sensor a replicar los colores fielmente, reflejando cómo los perciben los humanos.

Estos filtros de color son integrales; están fijados permanentemente encima de los píxeles, lo que hace imposible eliminarlos o modificarlos. Permiten selectivamente que ciertas longitudes de onda de luz lleguen a cada píxel, generando así el patrón característico de dos verdes, uno rojo y uno azul del filtro Bayer. Sin embargo, es importante señalar que sólo alrededor de un tercio de los fotones entrantes pasan con éxito a través de estos filtros.

En consecuencia, las cámaras en color generalmente requieren más luz que las monocromáticas. Esto se debe a que los sensores de color capturan sólo una parte de la luz disponible para cada píxel, a diferencia de los sensores monocromáticos que la capturan toda. Si bien los píxeles individuales se capturan con precisión, recrear la imagen a todo color requiere interpolación. Imagine una pequeña cuadrícula de píxeles en su monitor. Cada píxel necesita una combinación de rojo, verde y azul para representar el color real.

Los algoritmos de demostración analizan los píxeles rojos, verdes y azules circundantes para estimar esta mezcla para cada píxel, pero este proceso puede difuminar ligeramente los bordes y reducir la resolución percibida. Para obtener una precisión de color precisa, los fotógrafos profesionales utilizan un Macbeth ColorChecker. Este cuadro estandarizado contiene una gama de colores, lo que permite comparar los colores capturados por una cámara con la referencia, lo que también puede ser útil en aplicaciones de cámaras de inspección automatizadas que implican una identificación correcta del color. Preste especial atención a los rojos, ya que pueden resultar complicados para una cámara con sistema de visión.

Imágenes de polarización e infrarrojos de onda corta (SWIR)

Los escenarios específicos exigen tecnologías de imágenes especializadas, como la identificación de marcas de agua antifalsificación o códigos de seguridad en etiquetas o imágenes a través de botellas para garantizar niveles de llenado precisos. Cámaras SWIR como los que ofrece Emergent Vision Technologies se pueden implementar de manera confiable para tales casos. La serie de cámaras Eros 5GigE de Emergent incluye modelos como HE-300-SI, HE-1300-SI, HE-3200-SI y HE-5300-SI, equipado con sensores avanzados Sony SenSWIR capaces de capturar imágenes dentro del rango de 400 a 1700 nm. Estas cámaras utilizan sensores Sony de 0.33 MP IMX991, 1.31 MP IMX990, 3.14 MP IMX993 y 5.24 MP IMX992.

Los métodos de obtención de imágenes tradicionales enfrentan desafíos al inspeccionar materiales brillantes o reflectantes que causan deslumbramiento. Cámaras de polarización como HR-12000-S-P,HR-5000-S-P, HR-XNUMX-S-P, HE-5000-S-PM monocromo, y HE-5000-S-PC Las cámaras en color abordan estos problemas mejorando el brillo y el color y permitiendo la detección de detalles minuciosos que los sensores normales suelen pasar por alto. Adecuada para escenarios que requieren la diferenciación de escenas reflejadas y transmitidas, las imágenes de polarización son útiles para identificar irregularidades de la superficie como suciedad, áreas elevadas, hendiduras, rayones y deformaciones.

Estas cámaras de polarización se basan en sensores Sony IMX5MZR (mono) e IMX250MYR (color) de 250 MP, así como en sensores Sony IMX12MZR (mono) e IMX253MYR (color) de 253 MP. Estos sensores integran polarizadores microscópicos de rejilla de alambre sobre cada lente, con ángulos de polarización de 0°, 45°, 90° y 135° en grupos de cuatro píxeles; esta interpolación reduce la resolución efectiva del sensor en 4 veces, y cada bloque de cuatro píxeles se traduce en un solo píxel de salida.

Imágenes de alta velocidad

Si el vídeo es principalmente para análisis, priorice funciones como una alta velocidad de fotogramas para capturar sujetos en rápido movimiento y permitir una reproducción fluida a cámara lenta. La alta resolución proporciona imágenes detalladas para un análisis de datos preciso y un alto rango dinámico puede capturar una iluminación realista y evitar la pérdida de detalles en áreas brillantes u oscuras. Para la transmisión de video en vivo, priorice funciones como baja latencia para transmitir video con un retraso mínimo para una respuesta en tiempo real, así como una compresión de datos eficiente para reducir el uso de ancho de banda y lograr una transmisión fluida.

Las opciones de grabación también pueden desempeñar un papel importante en la elección de la cámara. La transmisión en vivo sin grabación es ideal para aplicaciones donde el análisis en tiempo real es crucial y no se requiere retención de datos. Sin embargo, la grabación de alta velocidad que puede capturar eventos de rápido movimiento para su posterior análisis requiere soluciones de almacenamiento de alto rendimiento como RAID o unidades de estado sólido. Es importante recordar que las cámaras con mayor resolución y velocidad de fotogramas exigen más espacio de almacenamiento. Los formatos de grabación comprimidos ofrecen tamaños de archivo más pequeños pero pueden sacrificar la calidad de la imagen. Para el almacenamiento, considere RAM, matrices RAID o unidades de estado sólido según el volumen de datos y los requisitos de velocidad de acceso.

A medida que más y más aplicaciones de imágenes se extienden más allá de la configuración de fábrica, la capacidad de GigE Vision para simplificar las operaciones se vuelve aún más importante para los fabricantes de equipos originales (OEM). La longitud del cable se vuelve crucial en escenarios donde hay una distancia considerable entre la cámara y la PC, como en aplicaciones de vigilancia, transporte y tecnología deportiva. La accesibilidad de componentes transceptores rentables como SFP+ (10G), SFP28 (25G) y QSFP28 (100G) permite el uso de fibras monomodo que abarcan distancias de hasta 10 km o más.

Técnica de imágenes de copia cero para visión artificial de alta velocidad

En el contexto de GigE Vision, la utilización del protocolo de control de transmisión (TCP) o acceso remoto directo a memoria (RDMA) y RDMA sobre Ethernet convergente (RoCE) y RoCE v2 ha surgido debido a un desafío específico. Este desafío implica el desmontaje de paquetes Ethernet en el receptor para entregar datos de imágenes en un formato continuo a la aplicación, lo que requiere la separación de los encabezados de los paquetes Ethernet. Si bien se puede lograr mediante software, este proceso conlleva una penalización en el rendimiento con un aumento tres veces mayor en el ancho de banda de la memoria y un mayor uso de la CPU, un aspecto que los usuarios de RDMA suelen destacar al comparar GigE Vision y RDMA tradicionales.

Emergent Vision Technologies ha adoptado una metodología de transferencia de imágenes de copia cero, un requisito esencial para lograr un rendimiento óptimo en imágenes de alta velocidad. Esta técnica reduce significativamente la carga de la CPU y el ancho de banda de la memoria al aprovechar las capacidades de división inherentes presentes en las tarjetas de interfaz de red contemporáneas. Una animación adjunta demuestra el impacto del uso del ancho de banda de la memoria de copia cero cuando se emplea el refinado GigE Vision Stream Protocol (GVSP) para la transferencia de imágenes de copia cero. El segmento inicial de la animación ilustra un sistema no optimizado que experimenta un desbordamiento del búfer en la NIC, mientras que el segmento siguiente muestra el flujo fluido y confiable de datos facilitado por la optimización del sistema y la copia cero.

Presupuesto

El costo juega un papel vital al decidir qué cámara comprar y puede ser tan importante como la resolución y la velocidad. Es muy probable que en este punto, la decisión de comprar una cámara industrial para inspección o para otra tarea de visión artificial ya se haya tomado en función de la rentabilidad y el retorno de la inversión (ROI) del sistema de inspección por visión artificial.

Cuando se trata de sistemas de visión artificial, el costo determina lo que se puede lograr y el presupuesto de la cámara se determinará en función de estas evaluaciones. Aunque la inspección a un nivel muy granular de detalle puede resultar atractiva, también puede resultar prohibitivamente costosa. Los compradores de cámaras deben sopesar el costo con el retorno de la inversión. Trabajar hacia atrás desde el costo es un buen punto de partida. Obliga a priorizar características verdaderamente esenciales para la aplicación y garantizar la viabilidad financiera.

Dado que el costo es un factor importante a la hora de elegir la cámara adecuada, se deben priorizar las características y especificaciones en función de las limitaciones presupuestarias. Estas consideraciones ayudan a delimitar el campo de cámaras que serán adecuadas para una aplicación específica. Priorizar cada restricción y evaluarlas con respecto al presupuesto conducirá a seleccionar algunas cámaras que sean las más adecuadas para el proyecto determinado.

Priorizar las restricciones de la aplicación

En general, es mejor comenzar considerando el tamaño del objeto a escanear y la característica más pequeña posible que debe diferenciarse en ese objeto. Cuanto más pequeño sea el píxel, menor será el detalle que se puede resolver. Hay una amplia selección de cámaras con una variedad de especificaciones para elegir, como cámaras de escaneo lineal de hasta 16K, matrices de área de 80 MP o más, hasta cámaras de alta velocidad que capturan miles de fotogramas por segundo.

Las cámaras de alta resolución y alta velocidad necesitan un gran ancho de banda. Luego está la longitud del cable y los protocolos de vídeo: analógico (RS-170), USB, Camera Link (CL), CoaXPress y GigE. La elección del protocolo dependerá a menudo de los requisitos de ancho de banda y longitud del cable. Tenga en cuenta las distintas monturas de lentes, como M12, CS, C, F, M42, M75, y considere que cuanto más grande sea el sensor de imagen, mayor será la montura de la lente. Para determinar el círculo de imagen mínimo requerido para un sensor de matriz lineal, considere la longitud del sensor de manera similar a la diagonal del área de la matriz.

Otras características que pueden necesitar ser evaluadas incluyen ROI (región de interés) seleccionable, FPGA, memoria en la cámara, procesamiento de imágenes integrado y más. Decida qué tan grande deberá ser la lente para cumplir con los requisitos del campo de visión y la distancia de trabajo. Piense en el espectro electromagnético y descubra exactamente cómo iluminar las características de interés requeridas y nada más. Elija entre monocromo y color, UV, polarizado, NIR, SWIR, multiespectral o hiperespectral. Tener en cuenta todas estas prioridades ayudará a seleccionar las cámaras adecuadas para una aplicación.

GPUDirect: imágenes sin pérdida de datos

En todas sus cámaras GigE Vision de alta velocidad y alta resolución, Emergent garantiza el mejor rendimiento de su clase mediante el uso de un enfoque GigE Vision optimizado y una infraestructura Ethernet ubicua para una adquisición y transferencia de datos confiable y sólida en lugar de depender de tecnologías patentadas o de punto de acceso. -Interfaces de puntos y tableros de adquisición de imágenes. Además, Emergent admite tecnologías de transferencia directa como GPUDirect de NVIDIA, que permite la transferencia de imágenes directamente a la memoria de la GPU, mitigando el impacto de grandes transferencias de datos en la CPU y la memoria del sistema. Esta configuración aprovecha la capacidad de GPU más potente para el procesamiento de datos al tiempo que mantiene la compatibilidad con el estándar GigE Vision y la interoperabilidad con software y periféricos compatibles.

Al utilizar el software Emergent eCapture Pro, las cámaras con tecnología GPUDirect también pueden transferir imágenes directamente a la memoria de la GPU. Al implementar esta tecnología, se logra una utilización cero de la CPU y una generación de imágenes de ancho de banda de memoria cero sin pérdida de datos. Al utilizar capacidades de GPU más potentes, esta tecnología reduce el impacto de grandes transferencias de datos en la CPU y la memoria del sistema, al tiempo que mantiene la compatibilidad con el estándar GigE Vision y la interoperabilidad con periféricos y software compatibles.

Cámaras emergentes:

Utilizando tecnologías de visión de 10, 25 y 100 GigE, Emergent ha demostrado un rendimiento superior en una amplia gama de mercados, incluidos la visión artificial y el entretenimiento. Con una amplia gama de opciones de cámara, incluidas cámaras 10GigE, 25GigE y 100GigE que van desde 0.5 MP a 100 MP+, con velocidades de cuadros de hasta 3462 fps con una resolución completa de 2.5 MP para satisfacer necesidades de imágenes dispares.

CÁMARAS DE VISIÓN GIGE EMERGENTES PARA APLICACIONES DE VISIÓN MÁQUINA

Cámaras SWIR, polarizadas y UV

| Modelo | Chroma | Resolución | Cuadros por segundo | Fácil de usar | Nombre del sensor | Pixel Tamaño | |

|---|---|---|---|---|---|---|---|

|

HE-5300-SI | SWIR | 5.24MP | 130fps | 1, 2.5, 5 Gigas | Sony IMX992 | 3.45 × 3.45 µm |

|

HE-3200-SI | SWIR | 3.14MP | 170fps | 1, 2.5, 5 Gigas | Sony IMX993 | 3.45 × 3.45 µm |

|

HE-1300-SI | SWIR | 1.31MP | 135fps | 1, 2.5, 5 Gigas | Sony IMX990 | 5 × 5 µm |

|

HE-300-SI | SWIR | 0.33MP | 260fps | 1, 2.5, 5 Gigas | Sony IMX991 | 5 × 5 µm |

|

HE-5000-S-PM | mono polarizado | 5MP | 81.5fps | 1, 2.5, 5 Gigas | Sony IMX250MZR | 3.45 × 3.45 µm |

|

HE-5000-S-PC | Color Polarizado | 5MP | 81.5fps | 1, 2.5, 5 Gigas | Sony IMX250MYR | 3.45 × 3.45 µm |

|

HR-8000-SB-U | UV | 8.1MP | 145fps | SFP+ de 10 Gigas | Sony IMX487 | 2.74 × 2.74 μm |

Cámaras de exploración de área

| Modelo | Chroma | Resolución | Cuadros por segundo | Fácil de usar | Nombre del sensor | Pixel Tamaño | |

|---|---|---|---|---|---|---|---|

|

HE-5000-SBL-M | Mono | 5.1MP | 45.5fps | 1, 2.5, 5 Gigas | Sony IMX547 | 2.74 × 2.74 μm |

|

HE-5000-SBL-C | Color | 5.1MP | 45.5fps | 1, 2.5, 5 Gigas | Sony IMX547 | 2.74 × 2.74 μm |

|

HE-8000-SBL-M | Mono | 8.1MP | 36.5fps | 1, 2.5, 5 Gigas | Sony IMX546 | 2.74 × 2.74 μm |

|

HE-8000-SBL-C | Color | 8.1MP | 36.5fps | 1, 2.5, 5 Gigas | Sony IMX546 | 2.74 × 2.74 μm |

|

HE-12000-SBL-M | Mono | 12.4MP | 34fps | 1, 2.5, 5 Gigas | Sony IMX545 | 2.74 × 2.74 μm |

|

HE-12000-SBL-C | Color | 12.4MP | 34fps | 1, 2.5, 5 Gigas | Sony IMX545 | 2.74 × 2.74 μm |

|

HE-16000-SBL-M | Mono | 16.13MP | 26fps | 1, 2.5, 5 Gigas | Sony IMX542 | 2.74 × 2.74 μm |

|

HE-16000-SBL-C | Color | 16.13MP | 26fps | 1, 2.5, 5 Gigas | Sony IMX542 | 2.74 × 2.74 μm |

|

HE-20000-SBL-M | Mono | 20.28MP | 21.5fps | 1, 2.5, 5 Gigas | Sony IMX541 | 2.74 × 2.74 μm |

|

HE-20000-SBL-C | Color | 20.28MP | 21.5fps | 1, 2.5, 5 Gigas | Sony IMX541 | 2.74 × 2.74 μm |

|

HE-25000-SBL-M | Mono | 24.47MP | 17.5fps | 1, 2.5, 5 Gigas | Sony IMX540 | 2.74 × 2.74 μm |

|

HE-25000-SBL-C | Color | 24.47MP | 17.5fps | 1, 2.5, 5 Gigas | Sony IMX540 | 2.74 × 2.74 μm |

|

HR-5000-SBL-M | Mono | 5.1MP | 99fps | SFP+ de 10 Gigas | Sony IMX547 | 2.74 × 2.74 μm |

|

HR-5000-SBL-C | Color | 5.1MP | 99fps | SFP+ de 10 Gigas | Sony IMX547 | 2.74 × 2.74 μm |

|

HR-8000-SBL-M | Mono | 8.1MP | 73fps | SFP+ de 10 Gigas | Sony IMX546 | 2.74 × 2.74 μm |

|

HR-8000-SBL-C | Color | 8.1MP | 73fps | SFP+ de 10 Gigas | Sony IMX546 | 2.74 × 2.74 μm |

|

HR-12000-SBL-M | Mono | 12.4MP | 68fps | SFP+ de 10 Gigas | Sony IMX545 | 2.74 × 2.74 μm |

|

HR-12000-SBL-C | Color | 12.4MP | 68fps | SFP+ de 10 Gigas | Sony IMX545 | 2.74 × 2.74 μm |

|

HR-16000-SBL-M | Mono | 16.13MP | 52fps | SFP+ de 10 Gigas | Sony IMX542 | 2.74 × 2.74 μm |

|

HR-16000-SBL-C | Color | 16.13MP | 52fps | SFP+ de 10 Gigas | Sony IMX542 | 2.74 × 2.74 μm |

|

HR-20000-SBL-M | Mono | 20.28MP | 43fps | SFP+ de 10 Gigas | Sony IMX541 | 2.74 × 2.74 μm |

|

HR-20000-SBL-C | Color | 20.28MP | 43fps | SFP+ de 10 Gigas | Sony IMX541 | 2.74 × 2.74 μm |

|

HR-25000-SBL-M | Mono | 24.47MP | 35fps | SFP+ de 10 Gigas | Sony IMX540 | 2.74 × 2.74 μm |

|

HR-25000-SBL-C | Color | 24.47MP | 35fps | SFP+ de 10 Gigas | Sony IMX540 | 2.74 × 2.74 μm |

|

HB-5000-SB-M | Mono | 5.1MP | 269fps | SFP25 de 28 gigas | Sony S IMX537 | 2.74 × 2.74 μm |

|

HB-5000-SB-C | Color | 5.1MP | 269fps | SFP25 de 28 gigas | Sony S IMX537 | 2.74 × 2.74 μm |

|

HB-8000-SB-M | Mono | 8.1MP | 201fps | SFP25 de 28 gigas | Sony S IMX536 | 2.74 × 2.74 μm |

|

HB-8000-SB-C | Color | 8.1MP | 201fps | SFP25 de 28 gigas | Sony S IMX536 | 2.74 × 2.74 μm |

|

HB-12000-SB-M | Mono | 12.4MP | 192fps | SFP25 de 28 gigas | Sony S IMX535 | 2.74 × 2.74 μm |

|

HB-12000-SB-C | Color | 12.4MP | 192fps | SFP25 de 28 gigas | Sony S IMX535 | 2.74 × 2.74 μm |

|

HB-16000-SB-M | Mono | 16.13MP | 145fps | SFP25 de 28 gigas | Sony S IMX532 | 2.74 × 2.74 μm |

|

HB-16000-SB-C | Color | 16.13MP | 145fps | SFP25 de 28 gigas | Sony S IMX532 | 2.74 × 2.74 μm |

|

HB-20000-SB-M | Mono | 20.28MP | 100fps | SFP25 de 28 gigas | Sony S IMX531 | 2.74 × 2.74 μm |

|

HB-20000-SB-C | Color | 20.28MP | 100fps | SFP25 de 28 gigas | Sony S IMX531 | 2.74 × 2.74 μm |

|

HB-25000-SB-M | Mono | 24.47MP | 98fps | SFP25 de 28 gigas | Sony S IMX530 | 2.74 × 2.74 μm |

|

HB-25000-SB-C | Color | 24.47MP | 98fps | SFP25 de 28 gigas | Sony S IMX530 | 2.74 × 2.74 μm |

|

HB-127-SM | Mono | 127.7MP | 17fps | SFP25 de 28 gigas | Sony IMX661 | 3.45 × 3.45 µm |

|

HB-127-SC | Color | 127.7MP | 17fps | SFP25 de 28 gigas | Sony IMX661 | 3.45 × 3.45 µm |

|

HZ-100-GM | Mono | 103.7MP | 24fps | 100 GigE QSFP28 | Gpíxel GMAX32103 | 3.2 × 3.2 µm |

|

HZ-100-GC | Color | 103.7MP | 24fps | 100 GigE QSFP28 | Gpíxel GMAX32103 | 3.2 × 3.2 µm |

Cámaras de exploración lineal

| Modelo | Chroma | Resolución | Velocidad de línea | Tri Tarifa | Fácil de usar | Nombre del sensor | Pixel Tamaño | |

|---|---|---|---|---|---|---|---|---|

|

LR-4KG35-M | Mono | 4Kx2 | 172KHz | 57KHz | SFP+ de 10 Gigas | Gpíxel GL3504 | 3.5 × 3.5 µm |

|

LR-4KG35-C | Color | 4Kx2 | 172KHz | 57KHz | SFP+ de 10 Gigas | Gpíxel GL3504 | 3.5 × 3.5 µm |

|

TLZ-9KG5-M | Mono | 9K 256 TDI | 608KHz | – | 100 GigE QSFP28 | Pixel GLT5009BSI | 5 × 5 µm |

|

LB-8KG7-M | Mono | 8Kx4 | 300KHz | 100KHz | SFP25 de 28 gigas | Gpíxel GL7008 | 7 × 7 µm |

|

LB-8KG7-C | Color | 8Kx4 | 300KHz | 100KHz | SFP25 de 28 gigas | Gpíxel GL7008 | 7 × 7 µm |

|

LZ-16KG5-M | Mono | 16Kx16 | 400KHz | 133KHz | 100 GigE QSFP28 | Gpíxel GL5016 | 5 × 5 µm |

|

LZ-16KG5-C | Color | 16Kx16 | 400KHz | 133KHz | 100 GigE QSFP28 | Gpíxel GL5016 | 5 × 5 µm |

Para opciones de cámara adicionales, consulte nuestra herramienta de diseño de sistemas interactivos.