Emergent präsentiert Innovationen im Bereich Hochgeschwindigkeits-GigE-Vision-Kameras auf der Vision Stuttgart 2024

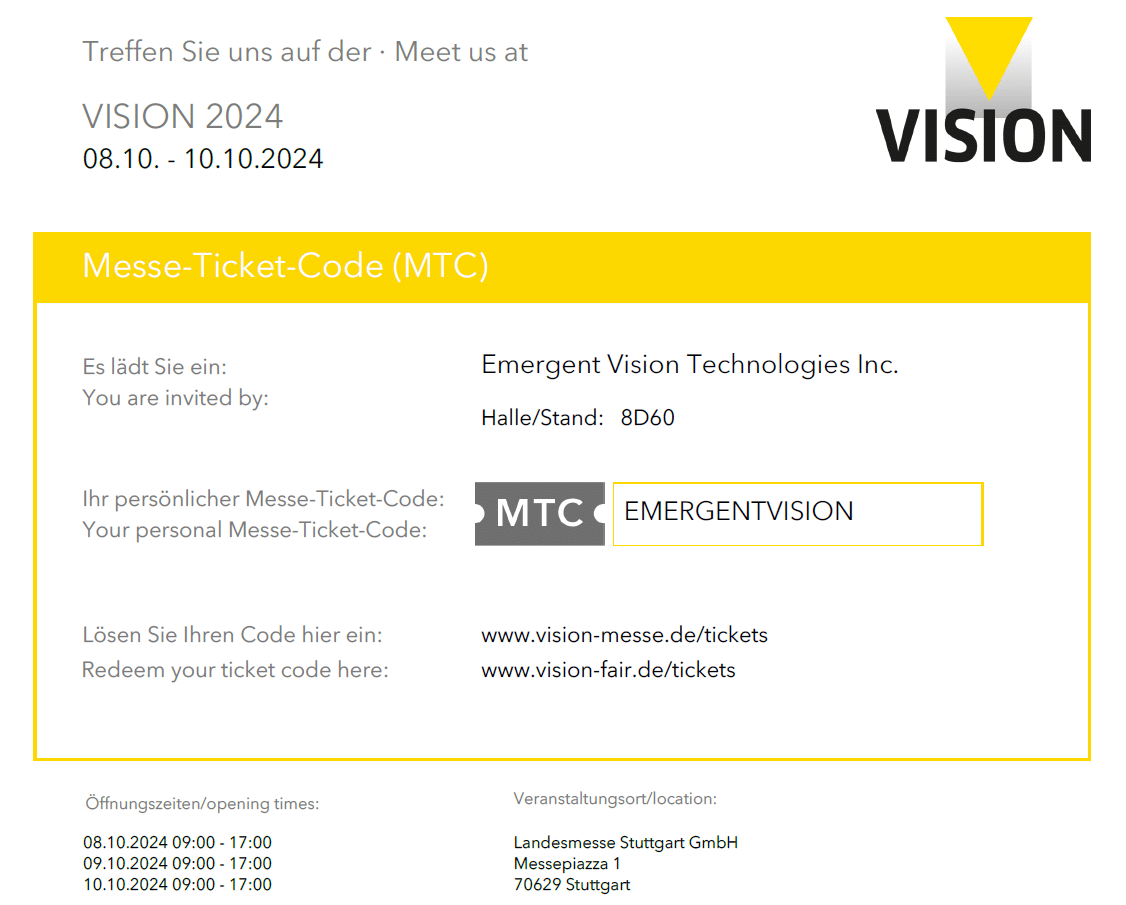

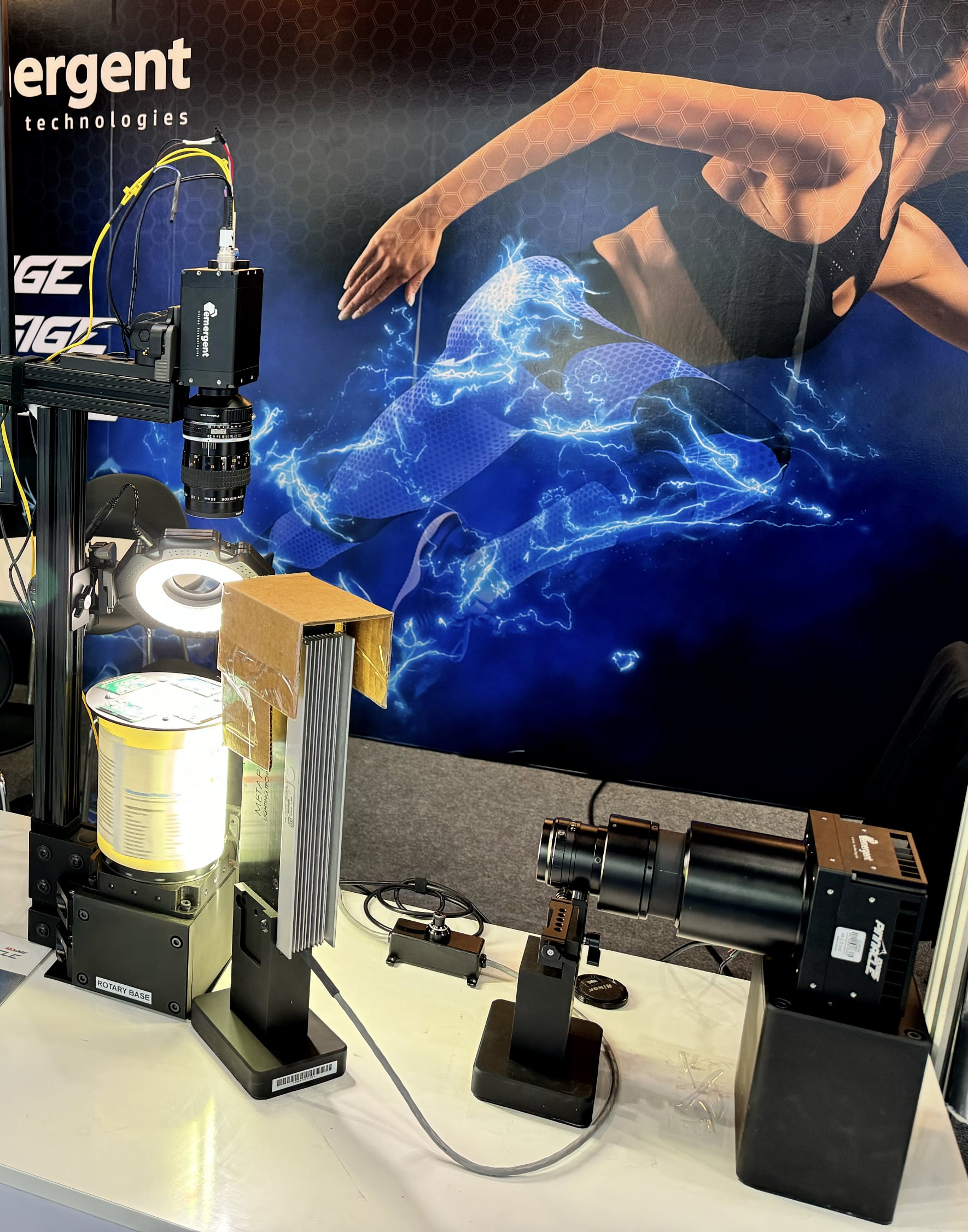

Emergent Vision Technologies wird seine preisgekrönten Hochgeschwindigkeits-Bildgebungstechnologien vorstellen Vision Stuttgart 2024 vom 8. bis 10. Oktober. In Halle 8, Stand 8D60 der Messe Stuttgart, zeigt Emergent seine FlexProc- und FlexTrans-Technologie, Echtzeit-3D-Rekonstruktion Fähigkeiten, seine GigE Vision-Kameras, Software. und Netzwerkschnittstellenkarten, Und vieles mehr.

Verpassen Sie nicht die Gelegenheit, das Emergent-Team persönlich kennenzulernen und zu erfahren, wie wir Ihre anspruchsvollsten KI- und Machine-Learning-Anwendungen angehen können. Holen Sie sich Ihr kostenloses Ticket werden auf dieser Seite erläutert und verwenden Sie einfach den Code EMERGENTVISION zur Anmeldung. Wir freuen uns auf Sie!

Nachfolgend finden Sie einen Überblick über die verschiedenen Produkte und Technologien, über die sich die Teilnehmer beim Besuch des Stands von Emergent Vision Technologies auf der Vision Stuttgart 2024 informieren können.

Vision Stuttgart 2024 Demos

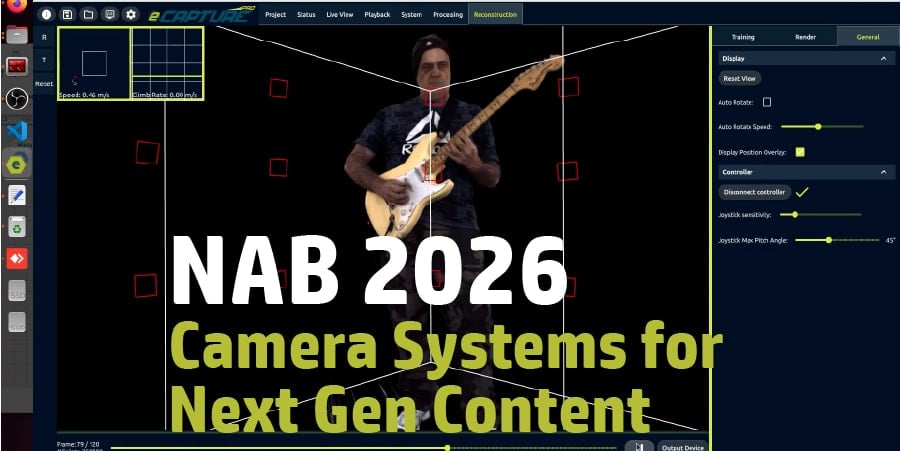

eCapture Pro – Demo der Software zur 3D-Rekonstruktion in Echtzeit

eCapture Pro ist eine Drag-and-Drop-Anwendung, mit der man über eine grafische Oberfläche Geräte zum System hinzufügen kann. Wir fügen die Kameras, Server, Speicher, GPUs usw. hinzu und verbinden sie dann, um die Hardware für das System zu definieren, oder verwenden die automatische Verbindungsfunktion. Wir konfigurieren auch die Verarbeitungsknoten wie die GPU, um ihr Verhalten zu definieren, was in diesem Fall Folgendes ist: Volumetrisches Video in Echtzeit. Für eine volumetrische Videoanwendung wird ein Projekt erstellt und einzelne Aufnahmen mit mehreren Kameras werden mit einfachen Kalibrierungszielen gemacht. Wenn dies erledigt ist, klicken wir einfach auf „Ausführen“, um die Anwendung auszuführen, die das volumetrische Video generiert. Wir können dies auf verschiedene Arten anzeigen. Wir können einen Joystick verwenden und um das Volumen herumfliegen und das Objekt in unserem 3D-Raum auf einem 2D-Monitor anzeigen. Wir können beispielsweise auch Meta Quest 3 verwenden, um mit den Quest-Controllern durch den 3D-Raum zu fliegen und mit der Quest-Brille durch Bewegen unseres Kopfes rundum zu blicken. Die Quest-Integration wird durch die Verwendung von Unity ermöglicht. Der 3D-Inhalt könnte zur Fernanzeige an einen anderen Ort übertragen werden.

Und all dies im Video wird auf einem einzigen Midrange-Server mit nur 1 GPU durchgeführt. eCapture Pro ist eine UI-basierte Software, die es Kunden ermöglicht, preisgekrönte Emergent-Kameras mit Geschwindigkeiten von 5GigE, 10GigE, 25GigE und 100GigE. Die Software wird häufig für große Aufnahmesysteme mit mehreren Servern, Switches, Speichermedien usw. verwendet. Bisher war die Software darauf beschränkt, Kameradaten mit sehr hoher Leistung auf Speichermedien aufzuzeichnen, um sie für volumetrische Videoanwendungen nachträglich 3D-rekonstruieren zu können. Emergent hat seine preisgekrönte eCapture Pro-Software um die Fähigkeit erweitert, volumetrische Videos in Echtzeit zu generieren, sodass man sofort in das gefilmte Ereignis oder Motiv eintauchen kann. Stellen Sie sich vor, Sie sind in einer anderen Stadt mit einer VR-Brille wie der Meta Quest 3 und können sich überall in dem von uns bereitgestellten 3D-Raum bewegen. Stellen Sie sich vor, Sie fliegen mit den Quest 3-Controllern, die Geschwindigkeit und Richtung steuern, durch den Raum. Stellen Sie sich vor, Sie drehen beim Herumfliegen einfach den Kopf, um in eine beliebige Richtung zu schauen. Oder suchen Sie sich auf jeden Fall eine bequeme Ansicht und genießen Sie die Show aus dieser einzigartigen Perspektive.

100GigE HZ-65000 Dual Fisheye-Demo

Diese Demo verwendet die 100GigE HZ-65000 Kamera und die neue Canon RF Dual Fisheye Halterung. In Kombination mit einem VR Headsets wie dem Oculus Quest 2 usw. können Benutzer in ein lebendiges, hochauflösendes 3D-Erlebnis eintauchen. Dieses Objektiv wurde speziell für herausragende stereoskopische 3D-Bilder entwickelt. Es verfügt über zwei 5.2-mm-Fischaugenobjektive mit einem Abstand von 60 mm zwischen den Mitten der linken und rechten Linse und bietet einen Augenabstand, der dem menschlichen Sehen sehr nahe kommt, mit einer natürlichen Parallaxe für ein kraftvolles, immersives Erlebnis, das dem Betrachter das Gefühl gibt, er sei mitten in der Szene, in der das Video oder Standbild stattfindet. Mit einem beeindruckenden optischen Sichtfeld von 190 Grad bietet es dem Betrachter die Möglichkeit, seinen Blickwinkel innerhalb der aufgezeichneten Szene zu ändern und sich mithilfe eines kompatiblen Head-Mount-Displays umzusehen.

100GigE HZ65000 Little Planet/Entaniya Fischaugenobjektiv-Demo

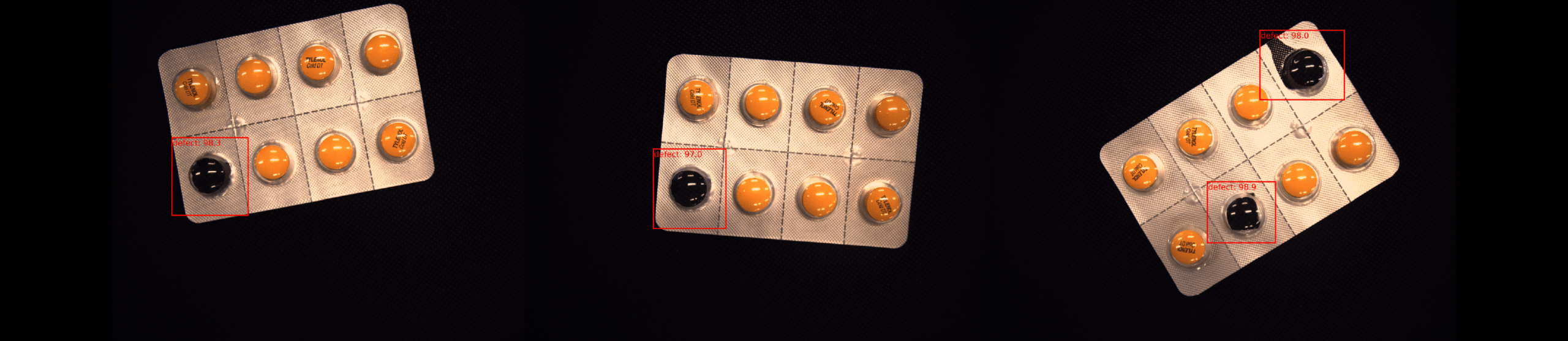

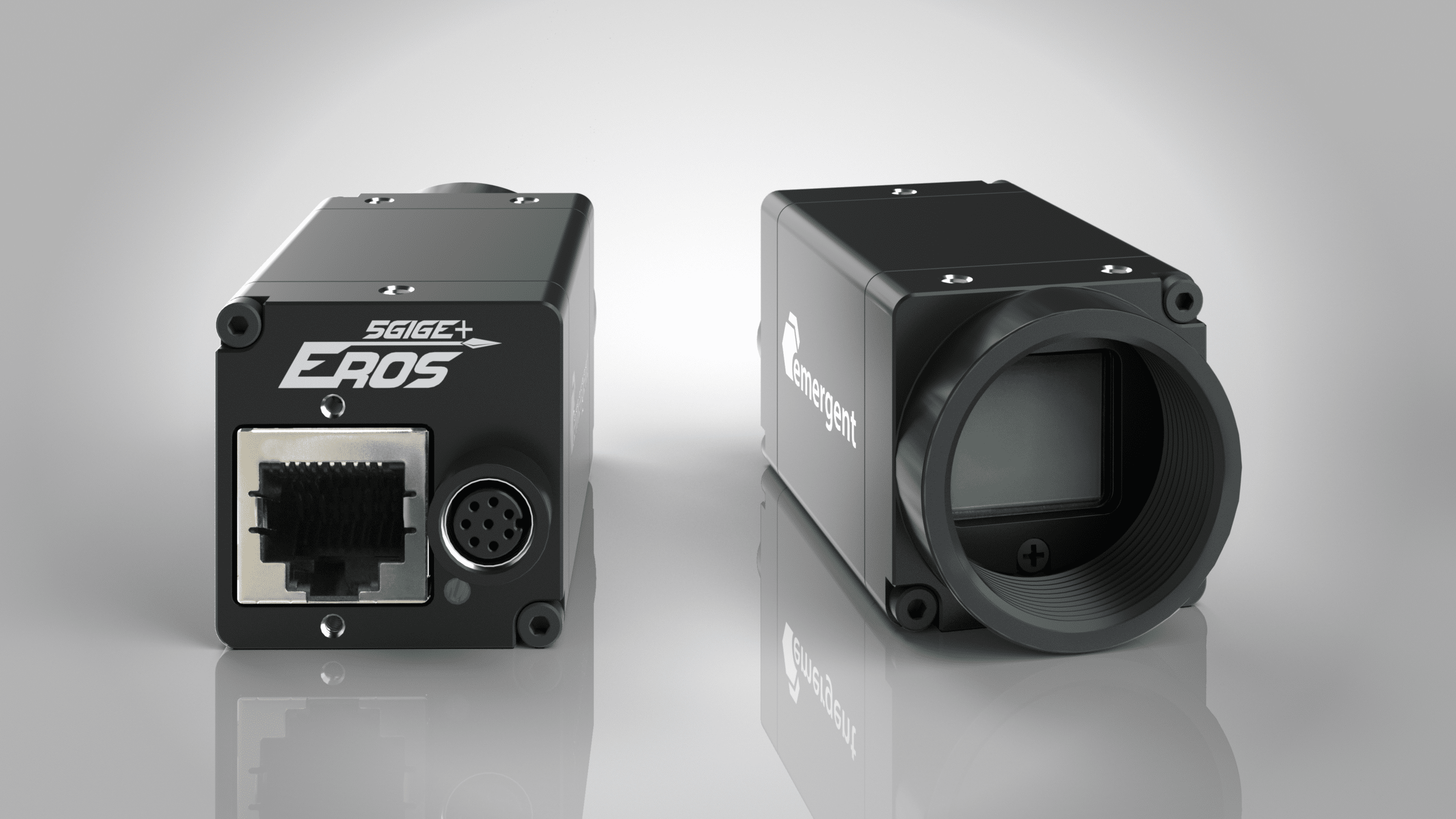

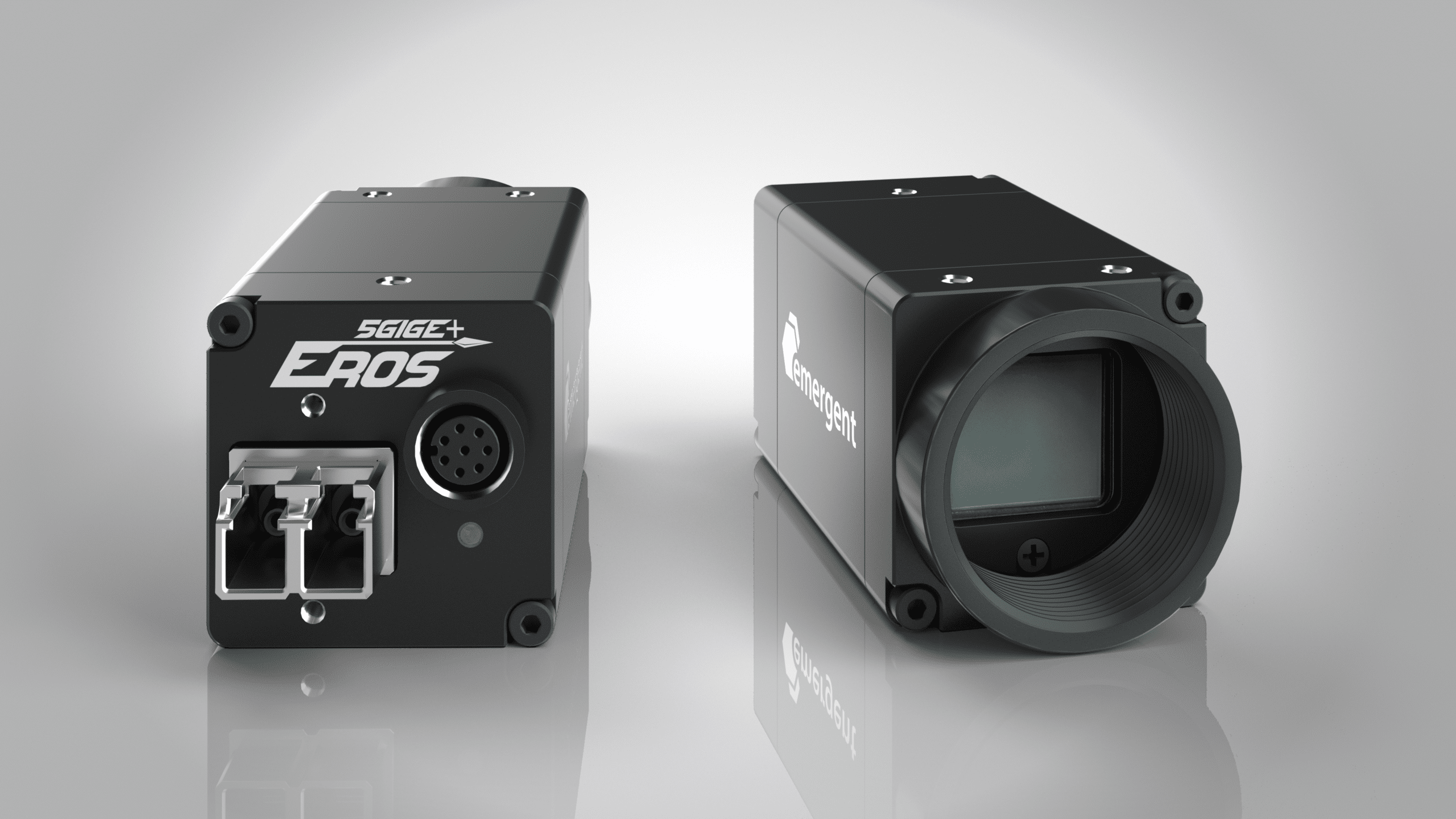

Eros/SWIR HE25000-SBL und HE5300-SI Förderband-Demo für maschinelles Lernen

Diese Demo enthält zwei 5GigE HE25000-SBL Kameras und zwei 5GigE SWIR HE5300-SI Kameras. Mithilfe von Machine-Learning-Bibliotheken wie PyTorch werden diese Modelle darauf trainiert, Defekte an Objekten wie Blisterpackungen zu erkennen und zu melden. Mithilfe von GPU Direct werden Bilder direkt von den Kameras auf die GPU übertragen. Die GPU führt das intern trainierte Machine-Learning-Modell aus, um Ergebnisse in Echtzeit zu liefern. Diese Demo stellt die Algorithmen mithilfe der Plug-in-Funktion eCapture Pro für schnelles Hochleistungsprototyping mit Zero Copy und GPU Direct bereit.

Diese Demo kann mit Nvidia Orin IGX, Nvidia Orin AGX oder auf einfacheren Computern basierend auf einem Asus-Motherboard mit Intel i7 vorgeführt werden.

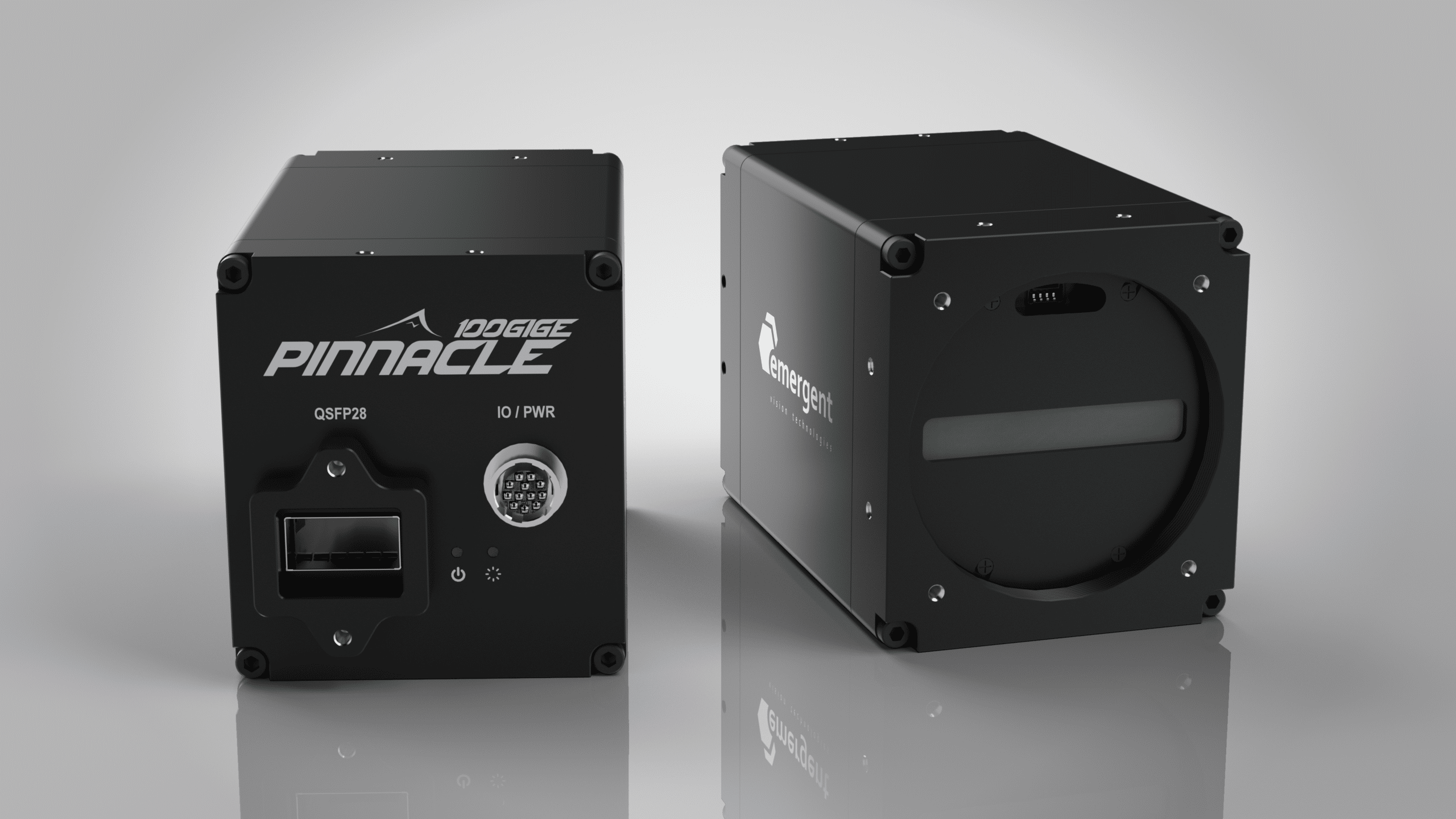

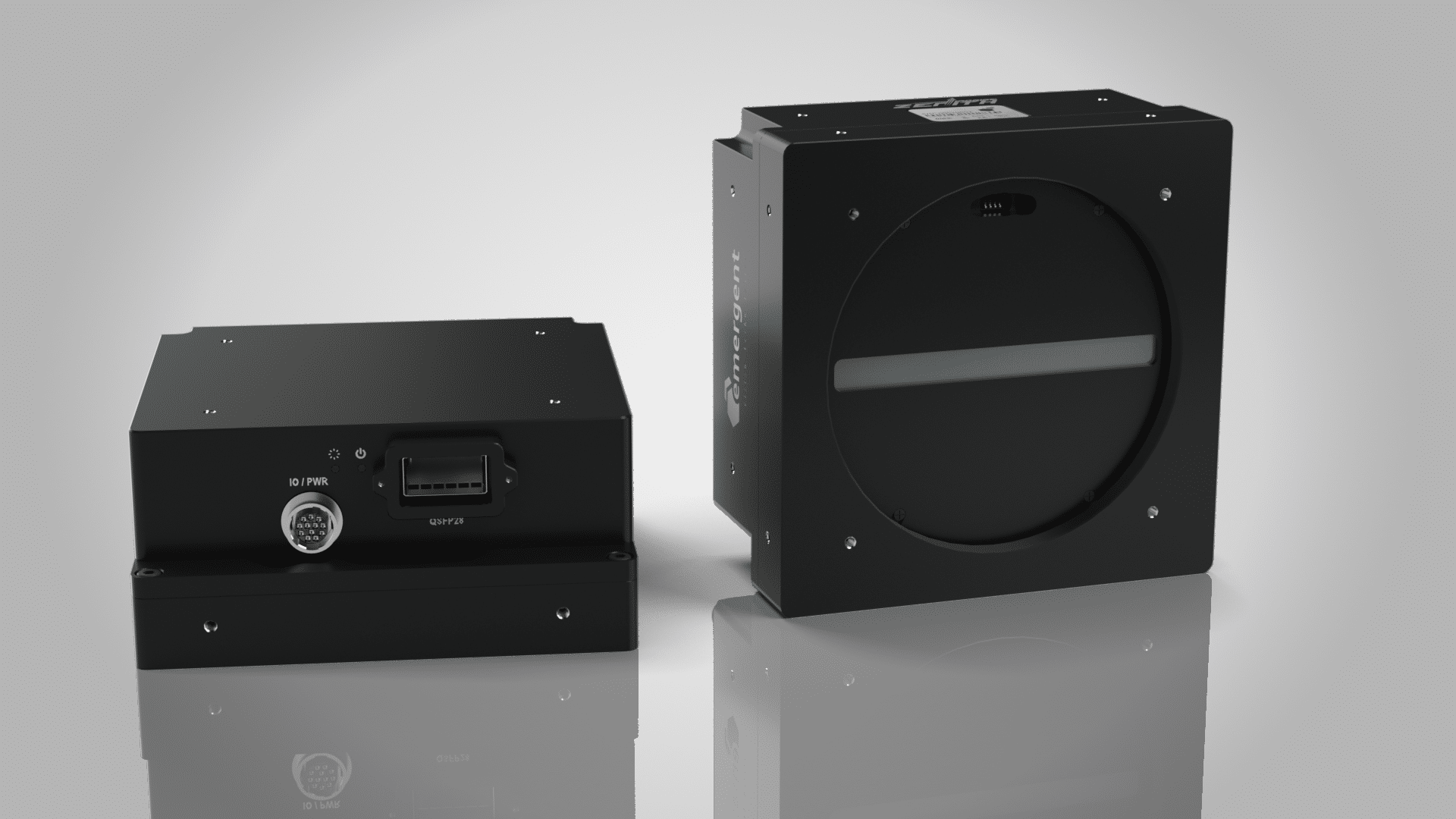

100GigE LZ-16KG5 & LZT-9KG5 Zeilenscan-Demo

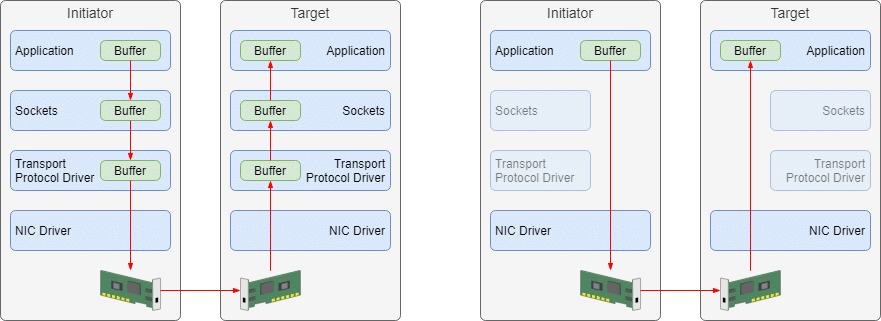

In dieser Demo läuft ein Zeilenscan mit einem einzigen Drehtisch und integriertem Encoder. LZ-16KG5-M hat eine Zeilenfrequenz von 400 KHz und eine Auflösung von 16 Kx16, während der LZT-9KG5 hat eine Zeilenrate von 608 kHz und eine Auflösung von 9K 256TDI. Diese Zeilenkameras sind die schnellsten monochromen Zeilenkameras mit einer 100GigE-Schnittstelle und scannen ein bedrucktes Blatt Papier auf einer Trommel, die sich um die vertikale Achse dreht. Emergent eCapture Pro und eSDK werden für die beste Zero-Copy-Treiberleistung ihrer Klasse verwendet. GigEVision 3.0 RDMA/RoCEv2 wird in dieser Demo ebenfalls verwendet und gilt als die am schnellsten implementierte Lösung für RoCEv2 für die neue Ergänzung des GigEVision-Standards, der in 1-2 Jahren veröffentlicht werden soll.

Neue 100GigE-Zeilenkamera: Pinnacle LZT-9KG5

Neue 100GigE-Zeilenkamera: Pinnacle LZ-16KG5

Vergleich von Socket-basiertem Transport mit RoCEv2 Zero-Copy RDMA

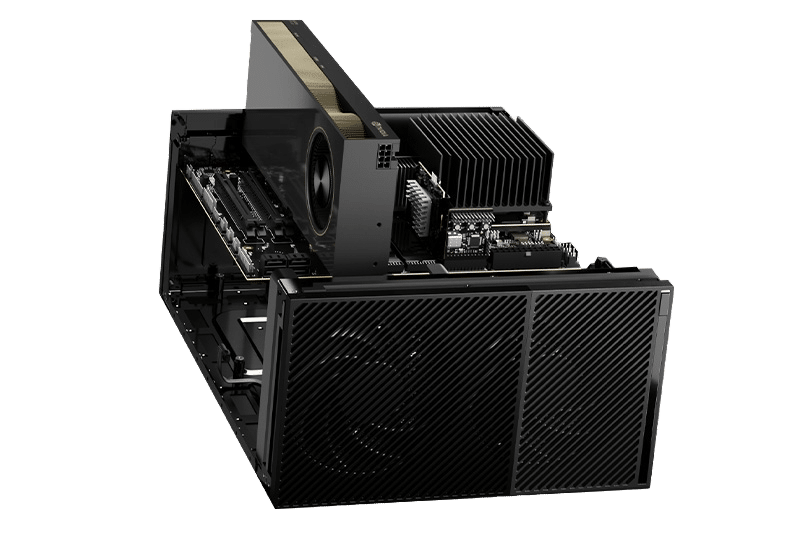

eCapture Pro – FlexProc- und FlexTrans-Demo

FlexProc

– Benutzerdefinierte Verarbeitung

– Benutzerdefinierte CPU-, GPU- und FPGA-Plug-ins

– eCapture Pro- und eSDK-Unterstützung

– Unendliche Flexibilität bei der Verarbeitung

FlexTrans

– Transfers von jedem Knoten zu jedem Knoten

– Zero-Copy- und GPU DIrect-Unterstützung

– eCapture Pro- und eSDK-Unterstützung

– Endlose Skalierbarkeit

Diese Demo verwendet 8 der 25GigE HB-25000-SB-C-Kameras.

FlexProc ermöglicht die Entwicklung und einfache Verteilung von Verarbeitungsaufgaben überall im System. Die Blöcke in der Grafikansicht von eCapture Pro können mit integrierten Verarbeitungs-Plugins konfiguriert werden, oder der Benutzer kann seine eigenen benutzerdefinierten Plugins erstellen. Für ein benutzerdefiniertes GPU-Plugin würde man CUDA-Code entwickeln, um die Aufgabe zu definieren. Der Code wird dann in eine DLL kompiliert und diese DLL definiert den benutzerdefinierten Block in der Grafikansicht von eCapture Pro. Wenn alle Kameras und Blöcke in eCapture Pro verbunden sind, klickt der Benutzer einfach auf „Ausführen“, um die Anwendung auszuführen.

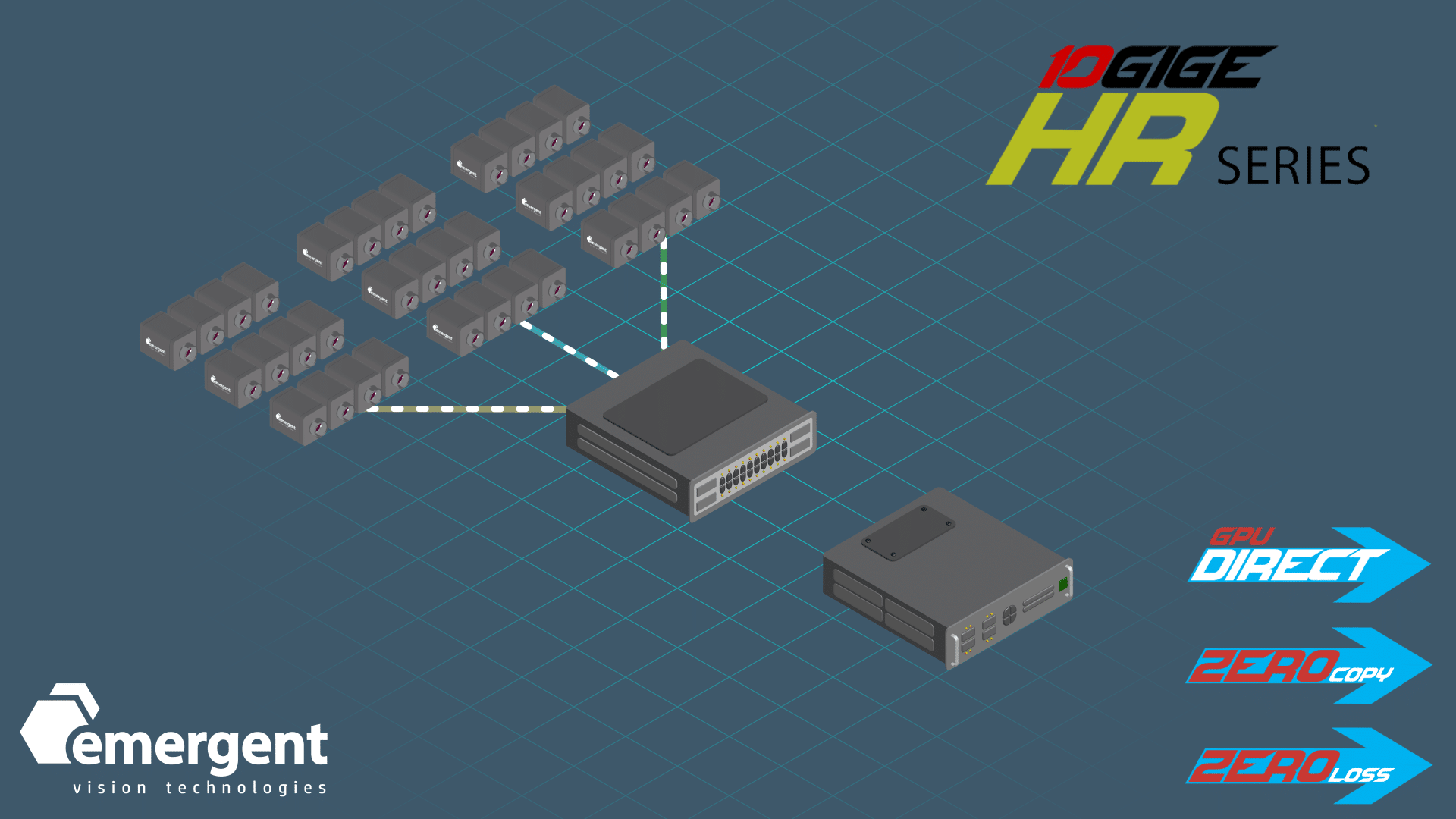

FlexTrans ist mehr als nur die Fähigkeit, Inhalte von einem Verarbeitungsknoten zu einem beliebigen anderen Knoten im System zu verschieben. Es geht auch darum, dies mit der höchstmöglichen Leistung und der geringstmöglichen Latenz zu tun. Dies bedeutet, die von Emergent entwickelten Methoden GPU Direct und Zero Copy zu verwenden. GPU Direct ist eine Methode zum direkten Kopieren und Übertragen zwischen GPU-Speicher und Netzwerk. Wir können Hochleistungsdaten nahtlos zwischen einer GPU in einem Server und einer GPU in einem anderen Server übertragen. Peer-to-Peer ist eine Methode zum direkten Kopieren und Übertragen zwischen GPUs innerhalb desselben Servers. Wir können dieselben Technologien auch verwenden, um Daten von Serverspeichergeräten und Systemspeicher an andere Orte innerhalb des Systems zu übertragen. eCapture Pro FlexTrans ermöglicht all dies und das ohne jegliche Codierung. In eCapture Pro verbindet man einfach die Blöcke in der Diagrammansicht, um anzugeben, wohin die Daten als Nächstes in der Verarbeitungspipeline gehen sollen. Der Leistungsaspekt ist hier ziemlich wichtig, da ein System, das diese Leistungsmethoden nicht nutzt, bis zu dreimal so viele Ressourcen beanspruchen kann, was dreimal so viel kostet. Die Latenz in solchen Systemen ist für die Anwendung nicht tolerierbar.

Diese Messe läuft bis Donnerstag, 10. Oktober 2024. Sie finden uns in Halle 8, Stand 8D60, Messe Stuttgart. Kommen Sie an unserem Stand vorbei und erfahren Sie mehr darüber, wie Emergent Ihre anspruchsvollsten KI- und maschinellen Lernanwendungen bewältigen kann!

Besuchen Sie uns bei Vision Stuttgart 2024 und erleben Sie aus erster Hand die Leistungsfähigkeit und das Potenzial unserer Technologien. Bei Emergent gestalten wir die Zukunft schon heute.

Leistung und Zuverlässigkeit bewährt!

10+ Jahre Versand 10GigE

6+ Jahre Versand 25GigE

3+ Jahre Versand 100GigE

Vermeiden Sie die Nachahmer

Engagieren Sie die Innovatoren

8. Oktober – 10. Oktober | Messe Stuttgart – Halle 8 Stand 8D60 | Stuttgart, Deutschland