Tech-Portal

Tech-Portal

Bildverarbeitungskameras: So wählen Sie die richtige Kamera für Ihre Bildverarbeitungsanwendung aus

Dank Verbesserungen und Erschwinglichkeit sind Bildverarbeitungssysteme für eine Vielzahl von Anwendungen nützlicher und zugänglicher geworden. Bei der Auswahl eines Industriekamerasystems müssen jedoch verschiedene Faktoren berücksichtigt werden.

Bei der Auswahl der richtigen Kamera für eine Bildverarbeitungsanwendung ist es von entscheidender Bedeutung, die technischen Daten von Industriekameras und Optiken zu kennen. Denn die Beziehung zwischen Sensor und Objektiv ermöglicht es einer Kamera, ein richtig ausgeleuchtetes Bild eines Objekts aufzunehmen. Bei einem industriellen Bildverarbeitungsvorgang wandelt der Kamerasensor Licht (Photonen) von einer Linse in elektrische Signale (Elektronen) um. Das resultierende Signal, das normalerweise entweder mit einem CCD-Bildsensor (Charge-Coupled Device) oder einem CMOS-Bildsensor (Complementary Metal Oxide Semiconductor) erzeugt wird, erzeugt ein Bild, das aus Pixeln besteht. Prozessoren analysieren dann das Bild, das aus dunklen Pixeln besteht, die durch niedrige Lichtverhältnisse verursacht werden, und hellen Pixeln, die durch intensivere Lichtverhältnisse entstehen.

Während jedes Bildverarbeitungs-Inspektionsprojekt anders ist, beginnen die meisten Entwickler von Kamera-Inspektionssystemen damit, umfassende Anforderungen zu definieren, jede Bildverarbeitungsaufgabe aufzulisten und eine Reihe von Musterteilen zu sammeln, die abgebildet werden sollen. Nach der Entscheidung, was erreicht werden muss – etwa OCR (optische Zeichenerkennung), Barcode-Lesung, Messtechnik, Erhalt hochwertiger Farbbilder, Betrachtung von Hochgeschwindigkeitsereignissen oder einer anderen Aufgabe – beginnt die Entwurfsphase normalerweise mit der Auswahl einer industriellen Bildverarbeitungsmaschine Kamera.

Die Auswahl von Kameras für Kamerainspektionssysteme ist nicht trivial. Die Bildverarbeitungskameralandschaft hat in den letzten Jahren ein rasantes Wachstum erfahren, und zahlreiche Hersteller bieten eine schwindelerregende Auswahl an Kameramodellen an. Von Zeilenscan, Flächenarray, Hochgeschwindigkeit, hoher Auflösung und analog bis hin zu Ultraviolett (UV), Monochrom, Farbe, NIR, SCHWIROb IR, Multispektral oder Hyperspektral – jeder Industriekameratyp verfügt über einzigartige Funktionalitäten.

Denn die Wahl der richtigen Bildverarbeitungskamera (bzw Computer-Vision-Kamera) von den Tausenden, die auf dem Markt erhältlich sind, kann eine entmutigende Aufgabe sein. Dieser Artikel soll die Navigation durch diese komplexe Umgebung erleichtern und bei der Auswahl der optimalen Kamera für spezifische Anforderungen helfen. In diesem Artikel geht es um die Schlüsselfaktoren, die bei der Auswahl einer Bildverarbeitungskamera berücksichtigt werden müssen. Es geht nicht nur auf Strahlungsart, Auflösung, Pixelgröße, Quanteneffizienz, Bildrate, Belichtungszeit, Kameragröße, Bildübertragungsgeschwindigkeit und andere Faktoren ein, sondern zeigt auch auf, worauf man bei den Hochgeschwindigkeitstechnologien achten sollte Bildverarbeitungsanwendungen wie Kameraschnittstellen und deren Protokolle, Verarbeitungstechnologien und Software. Abschließend werden die Unterschiede zwischen RDMA-, TCP- und UDP-basierten GigE-Implementierungen im Kontext der heute für solche Systeme verfügbaren Hochgeschwindigkeits-RDMA-fähigen Bildverarbeitungskameras erläutert.

Anwendungsbeschränkungen

Die Auswahl der idealen Industriekamera erfordert eine sorgfältige Berücksichtigung mehrerer Faktoren, einschließlich der physischen Abmessungen, des Gewichts und des Stromverbrauchs. Diese Einschränkungen können erhebliche Auswirkungen auf die Optionen haben, insbesondere bei einzigartigen Anwendungen. Stellen Sie sich zum Beispiel einen autonomen mobilen Roboter (AMR) vor, der die Aufgabe hat, Artikel durch ein Lager zu bewegen. Dieser AMR benötigt eine Kamera, die klein und leicht ist und einen geringen Stromverbrauch bietet, um die Betriebszeit zu maximieren. In diesem Szenario werden Größen- und Gewichtsbeschränkungen zu kritischen Entscheidungspunkten.

Auch Umweltfaktoren spielen beim Kameravergleich eine entscheidende Rolle. Wird die Kamera im Freien verwendet und ist zum Schutz ein Gehäuse erforderlich? Oder wird es in einer kontrollierten Innenumgebung betrieben? Das Verständnis der Umgebungsbedingungen wird bei der Auswahl der Kamerafunktionen hilfreich sein, die für diese spezifischen Bedingungen geeignet sind. Die Geschwindigkeit des Motivs ist ein weiterer Faktor, der die Kameraauswahl erheblich beeinflussen kann. Für die Erfassung schneller Bewegungen und das Einfrieren des Geschehens sind Hochgeschwindigkeitskameras unerlässlich, da sie eine detaillierte Analyse der Bewegung des Motivs ermöglichen.

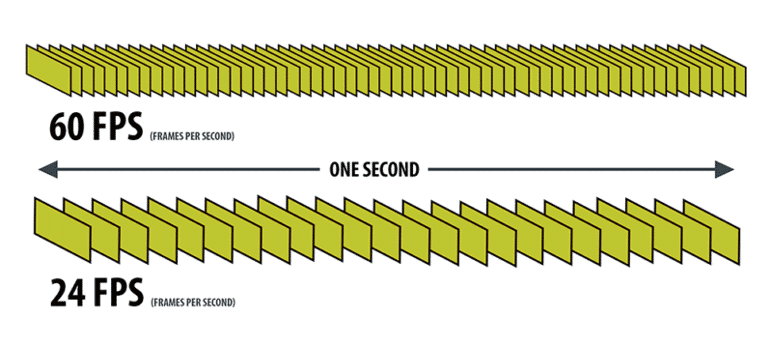

Wenn das helle Licht begrenzt ist, sollten Sie Kameras mit hoher Lichtempfindlichkeit in Betracht ziehen. Diese Kameras können selbst bei minimalem verfügbaren Licht klare Bilder aufnehmen und eignen sich daher ideal für beengte Räume oder Umgebungen mit wenig Licht. Weitere Faktoren, die bei Kameravergleichen berücksichtigt werden müssen, sind Bildrate, Auflösung und Dynamikbereich. Die Bildrate gibt an, wie viele Bilder die Kamera pro Sekunde aufnimmt. Für die Aufnahme sich schnell bewegender Motive oder eine flüssige Zeitlupenwiedergabe sind höhere Bildraten erforderlich. Die Auflösung bestimmt die Detailgenauigkeit und Klarheit des Bildes. Höhere Auflösungen erfassen mehr Details, erfordern jedoch zusätzlichen Bildspeicherplatz. Der Dynamikbereich bezieht sich auf die Fähigkeit der Kamera, Details in hellen und dunklen Bereichen der Szene zu erfassen. Kameras mit höherem Dynamikbereich erzeugen Bilder mit realistischerer Beleuchtung und weniger ausgeblendeten Lichtern oder verlorenen Schatten.

Ein Blick in eine Bildverarbeitungskamera

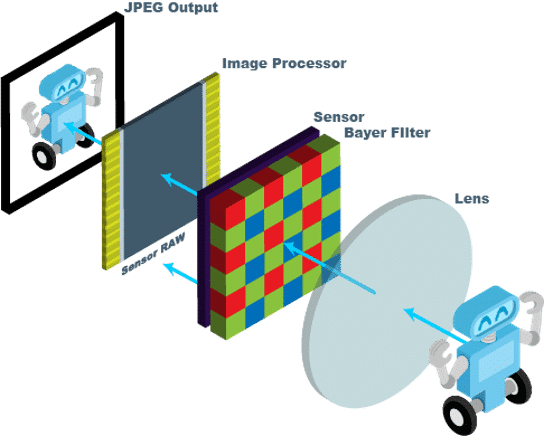

Das Aufbrechen einer einfachen Bildverarbeitungskamera offenbart ihr Innenleben. Die meisten Bildverarbeitungskameras lassen sich in zwei Hauptteile unterteilen: eine Reihe von Leiterplatten und den Bildsensor selbst. Die Leiterplatten, allgemein als Back-End-Schaltkreise bezeichnet, verwalten die Funktionslogik der Kamera. Dazu können A/D-Wandler (Analog-zu-Digital), Verstärker, Taktgeber für Belichtung und Bildrate, Ausleseschaltungen, FPGAs (feldprogrammierbare Gate-Arrays), Speicher und andere Geräte gehören. Stellen Sie sich diesen Schaltkreis als das Gehirn der Kamera vor, das Aufgaben wie die Umwandlung von Signalen, die Steuerung des Timings und das Speichern eingehender Bilder übernimmt.

Das Frontend der Bildverarbeitungskamera ist im Wesentlichen der Bildsensor. Der Bildsensor ist das Auge der Kamera, das Licht einfängt und das Bild erzeugt. Der Bildsensor ist in zwei Hauptvarianten erhältlich: Sensoren für sichtbares Licht (Silizium-CCD oder CMOS) und Infrarotsensoren (unter Verwendung verschiedener anderer Materialien). Diese Diskussion gilt zwar sowohl für die Auswahl von Kameras für sichtbares als auch für Infrarotlicht, deckt jedoch nicht die vielen anderen Arten von Sensoren ab, wie z. B. gekühlte und ungekühlte Infrarotsensoren aus einer Vielzahl unterschiedlicher Materialien. Stattdessen konzentrieren wir uns auf die Sensoren für sichtbares Licht, die wie Silikonschwämme Licht aufsaugen und in digitale Bilder umwandeln.

Elektromagnetische Strahlung

Das menschliche Auge lässt wie ein kleines Fenster zur Welt nur einen Bruchteil des großen elektromagnetischen Spektrums durch. Glücklicherweise sind Kameras zu leistungsstarken Erweiterungen geworden, die eine Sicht ermöglichen, die weit über die Grenzen des Sehvermögens hinausgeht. Stellen Sie sich eine riesige kosmische Lichtshow vor, bei der jedes Band des Spektrums eine einzigartige Rolle spielt. Jedes Band im Spektrum hat eine bestimmte Wellenlänge, und diese Wellenlängen bestimmen, was sichtbar ist.

Stellen Sie sich Wellenlängen wie ein Lineal für das Universum vor. Kürzere Wellenlängen, etwa im Ultraviolett- oder Röntgenbereich, können unglaublich kleine Details auflösen, etwa die komplizierten Muster auf den Flügeln eines Schmetterlings oder die zarte Struktur eines Virus. Andererseits haben längere Wellenlängen wie Infrarot Schwierigkeiten, feine Details zu unterscheiden. Sie eignen sich hervorragend zum Erkennen von Hitzesignaturen, zum Aufdecken der Anwesenheit von Menschen oder sogar für eine heiße Tasse Kaffee im Dunkeln. Für die Vergrößerung mikroskopischer Strukturen reichen sie jedoch nicht aus.

Spezifische Anwendungen erfordern spezielle Kameras. Beispielsweise erfordern bestimmte Bildverarbeitungs- und Bildverarbeitungsfunktionen Kameras mit einer Empfindlichkeit, die über das Spektrum des sichtbaren Lichts hinausgeht. Alternativ erfordern einige Aufgaben Kameras, die für die Untersuchung stark reflektierender Materialien wie Glas ausgestattet sind. Für Systemintegratoren, die Flächenkameras mit einer Empfindlichkeit über das Spektrum des sichtbaren Lichts hinaus suchen und gleichzeitig mit hohen Geschwindigkeiten und Datenraten arbeiten möchten, bietet Emergent Vision Technologies 10GigE- und 25GigE-Multispektralkameras mit UV-Empfindlichkeit sowie 10GigE-Kameras mit polarisierten Bildsensoren an Sony CMOS-Sensoren.

Sowohl der 25GigE Bolt HB-8000-SB-U und das 10GigE HR-8000-SB-U Nutzen Sie den 8.1 MP UV Pregius S IMX487 CMOS-Bildsensor von Sony, der eine erhöhte Empfindlichkeit im UV-Spektrum von 200 nm bis 400 nm bietet. Der IMX487, ein 2/3-Zoll-CMOS-Sensor mit Global-Shutter-Funktionalität, erfasst effizient UV-Licht. Durch den Einsatz einer von hinten beleuchteten Pixelstruktur auf einem mehrschichtigen CMOS-Sensor wie bei anderen Sony Pregius S-Sensoren liefert er eine unverzerrte, schnelle Bildgebung.

Der 25GigE HB-8000-SB-U erreicht eine Bildrate von 201 fps, während das 10GigE HR-8000-SB-U erreicht 145 fps. Diese GigE Vision-Kameras, die den GenICam-Standards entsprechen, sind für multispektrale Bildgebungsanwendungen konzipiert, darunter Halbleiterinspektion, Kunststoffabfallsortierung, Hochspannungskabelinspektion, Druckinspektion, hochauflösende Mikroskopie und Lumineszenzspektroskopie.

Wie erfassen Kameras also Bilder dieser sichtbaren und unsichtbaren Welten? Die Reise beginnt mit elektromagnetischer Strahlung, allgemein bekannt als Licht. Wenn Licht ein Pixel erreicht, löst es die Erzeugung eines freien Elektrons aus. Das Ziel bei der Bildgebung besteht darin, Photonen in Elektronen umzuwandeln, die im Pixel zurückgehalten werden und wie ein Kondensator wirken. Wenn weiterhin mehr Licht auftrifft, werden zusätzliche freie Elektronen erzeugt und als Ladungen in diesen Pixeln gespeichert, bis sie schließlich während des Auslesevorgangs abgerufen werden.

Volle Kapazität: Wie viel Licht verträgt ein Pixel?

Haben Sie schon einmal gesehen, wie ein helles Objekt in einem Bild sein Licht in die umliegenden Bereiche ausstrahlt? Das nennt man Blooming und es passiert, wenn ein Pixel mit Licht überladen wird – wie ein überlaufender Eimer. Die maximale Lichtmenge, die ein Pixel vor dem Aufblühen verarbeiten kann, wird als Full-Well-Kapazität (FWC) bezeichnet. Es ist wie die Größe dieses Eimers, gemessen in winzigen geladenen Teilchen, den sogenannten Elektronen. Wenn das Pixel vollständig gesättigt ist und keine Ladung mehr halten kann, hat es seinen FWC erreicht.

In Datenblättern wird der FWC eines Sensors typischerweise anhand der Anzahl der Elektronen definiert, die erforderlich sind, um diesen Zustand zu erreichen. Beispielsweise kann die FWC eines Sensors mit 20,000 Elektronen angegeben werden. Wenn die Datenblätter des Kameraherstellers die FWC für eine bestimmte Kamera nicht enthalten, gibt der Kamerahersteller möglicherweise an, welchen Sensor er verwendet. Wenn nicht, fragen Sie den Kamerahersteller und holen Sie sich das Datenblatt des Bildsensors vom Hersteller, in dem der FWC angegeben sein sollte. Die Kenntnis des FWC ist für verschiedene Anwendungen von entscheidender Bedeutung:

Bildgebung bei schwachem Licht: Bei schwacher Beleuchtung zählt jedes Photon. Ein Sensor mit einem hohen FWC kann auch bei längeren Verschlusszeiten schwache Details erfassen, Rauschen und Körnung vermeiden und selbst bei Dunkelheit klarere Bilder ermöglichen.

Bildgebung mit hohem Dynamikbereich: Sensoren mit hohem FWC ermöglichen es Kameras, einen größeren Bereich an Lichtintensitäten zu erfassen, ohne helle Glanzlichter (ausgeblasene Weißtöne) abzuschneiden. Denken Sie an Kameras, die in autonomen Fahrzeugen eingesetzt werden, die sowohl durch einen dunklen Tunnel navigieren als auch sicher in einer Stadtlandschaft mit heller Sonne und tiefen Schatten auftauchen müssen. Ein Sensor mit hohem FWC kann die Details in beiden Extremen ohne Übersteuerung festhalten und so sattere, realistischere Bilder erzeugen.

Wissenschaftliche Bildgebung: Genaue FWC-Werte sind für präzise Messungen in Forschungsanwendungen von entscheidender Bedeutung. Um das zarte Leuchten der Milchstraße oder entfernter Galaxien einzufangen, ist ein Sensor erforderlich, der die große Bandbreite an Lichtstärken am Nachthimmel bewältigen kann. Für Anwendungen wie die Astronomie oder medizinische Bildgebung, bei denen die Erfassung schwacher Signale von entscheidender Bedeutung ist, ist ein Sensor mit hoher FWC unerlässlich.

Sensorschaltkreise entscheiden, wann dieses Licht mit der Erzeugung von Elektronen beginnen darf, was als Integration bezeichnet wird, und wann es aufhört. Der elektrische Schaltkreis schaltet das Pixel ein oder aus und startet und stoppt die Spannungserzeugung proportional zur in jedem Well angesammelten Ladungsmenge. Schließlich kann das Signal dann aus den Pixeln in einer linearen Zeile mit einer bestimmten Zeilenrate oder mit einer bestimmten Bildrate ausgelesen werden, wenn ein gesamtes Flächenarray von Pixeln ausgelesen wird.

Quanteneffizienz und Signal/Rausch-Verhältnis

Die Fähigkeit der Pixel, Photonen in Elektronen umzuwandeln, wird als Quanteneffizienz (QE) bezeichnet. Wenn Photonen in die Pixel eindringen, erzeugen sie Elektronen. Gleichzeitig erzeugen Wärme und andere Faktoren jedoch auch einige Elektronen, was als Rauschen bezeichnet wird. Das Ziel für jedes Pixel besteht darin, dass durch Licht mehr Elektronen erzeugt werden als durch Wärme und andere Faktoren. Mit anderen Worten: Bildsensoren mit mehr Signalen (Elektronen aus Licht) als Rauschen (Elektronen aus Wärme und anderen Faktoren) weisen ein hohes Signal-Rausch-Verhältnis (S/N) auf.

Bildsensoren mit einem hohen S/N-Verhältnis, geringem Rauschen und einem großen FWC verfügen über einen großen Dynamikbereich. Der dynamische Bereich ist das Verhältnis der gemessenen maximalen zur minimalen Ladung. Während des Auslesens erfolgt die Umwandlung einer analogen Spannung in eine digitale Zahl (A/D). Wenn die Back-End-Schaltung einer Kamera beispielsweise in der Lage ist, eine 8-Bit-Analog-Digital-Umwandlung bereitzustellen, bietet sie ein Potenzial von 256 (oder 2).8) Ebenen. Wenn die ausgelesene Pixelladung 0 ist, hat es keine Elektronen und ist schwarz. Wenn das Pixel vollständig gesättigt und maximal aufgeladen ist, ist es weiß und hat einen Zählwert von 255.

Der A/D bestimmt, wie viele Graustufenunterteilungen vorhanden sind. Ein niedriges S/N bedeutet, dass viel Signal im Rauschen verloren geht, d. h. in den schwarzen Zahlen. Beispielsweise wäre es schwierig, ein Merkmal auf einem Objekt zu unterscheiden, das sich nur geringfügig vom Hintergrund und den umgebenden Teilen abhebt. Ein 10-Bit-A/D ist jedoch 210 = 1024. Wenn zwischen dem interessierenden Merkmal und dem umgebenden Bereich ein geringfügiger Graustufenunterschied besteht, erhöht eine größere Anzahl von Graustufenunterteilungen die Wahrscheinlichkeit, das Merkmal unterscheiden zu können.

Pixel Größe

Größere Pixel bieten oft einen Vorteil bei der Bildqualität. Im Vergleich zu kleineren Pixeln weisen größere Pixel aufgrund ihrer größeren „Eimer“ zum Sammeln von Elektronen im Allgemeinen ein höheres S/N-Verhältnis und einen höheren Dynamikbereich auf. Eine größere Oberfläche führt auch dazu, dass mehr Elektronen eingefangen werden. Dieser Vorteil hat jedoch seinen Preis: Größere Pixel erhöhen die Kosten des Sensors. Warum sind größere Sensoren teurer? Denken Sie an den Siliziumwafer, auf dem mehrere Sensoren geätzt sind. Die Kosten für die Herstellung dieses Wafers werden auf alle daraus resultierenden Sensoren aufgeteilt. Kleinere Pixel ermöglichen mehr Sensoren auf einem einzigen Wafer, wodurch die Kosten pro Sensor effektiv gesenkt werden. Deshalb sind kleinere Sensoren deutlich günstiger als ihre größeren Pendants.

Über das Idealszenario hinaus spielt auch der Fabrikertrag eine entscheidende Rolle. Nicht jeder hergestellte Sensor ist perfekt und das geringere Produktionsvolumen großer Sensoren verstärkt die Auswirkungen von Defekten. Ein paar fehlerhafte Pixel in einer so begrenzten Menge können die nutzbare Anzahl von Sensoren erheblich reduzieren. Daher ist die Auswahl des „Größten und Besten“ nicht immer der sinnvollste Ansatz. Während größere Pixel Leistungsvorteile bieten, können kleinere eine kostengünstige Alternative sein, insbesondere wenn Größenbeschränkungen oder Budgetbedenken eine Rolle spielen.

Imager-Größe

Die Bildgröße spielt eine entscheidende Rolle für die Kameraleistung, die Namenskonventionen können jedoch verwirrend sein. Begriffe wie „Viertelzoll“ und „Halbzoll“ scheinen veraltet zu sein, insbesondere wenn die tatsächlichen Abmessungen in Millimetern angegeben sind. Woher kommen diese Begriffe und was bedeuten sie wirklich? Diese Begriffe gehen auf die Ära der Filmfotografie zurück. Standardfilmgrößen (8 mm, 16 mm und 35 mm) verwendeten Blenden mit bestimmten Durchmessern. Kameraobjektive wurden entwickelt, um innerhalb dieser Blendenöffnungen einen Bildkreis auf den Film zu projizieren.

Diese Begriffe stellen lediglich die ungefähren diagonalen Abmessungen der Bildsensoren dar und beziehen sich auf das entsprechende Filmformat. Beispielsweise entspricht ein 16/XNUMX-Zoll-Sensor ungefähr der Diagonale eines XNUMX-mm-Filmbildes. Während die Namenskonvention aus dem Film stammt, werden die tatsächlichen Sensorgrößen aus Präzisionsgründen in Millimetern gemessen. Dies ermöglicht genauere Vergleiche und Kompatibilitätsberechnungen mit Objektiven und anderen Kamerakomponenten.

Diagonale des Sensors

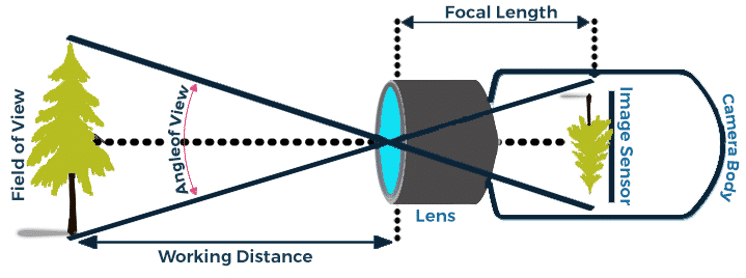

Das wichtigste Maß für die Auswahl eines Objektivs ist die Diagonale des Sensors. Dies bestimmt den minimalen Durchmesser des Bildkreises, den das Objektiv projizieren muss, um den gesamten Sensor abzudecken. Bei Kameras werden Sensorgrößen häufig mit den bekannten Begriffen „Viertelzoll“ bis „Ein Zoll“ angegeben. Es ist jedoch wichtig, die tatsächliche Diagonalmessung in Millimetern im Handbuch oder auf der Website des Herstellers zu konsultieren.

Das Objektiv muss einen Bildkreis erzeugen, der die Diagonale des Sensors vollständig abdeckt. Die diagonale Abmessung des Sensors hat direkten Einfluss auf den erforderlichen Bildkreis des Objektivs. Ein 1-Zoll-Sensor erfordert ein Objektiv mit einem Bildkreis von mindestens 1 Zoll, um Vignettierung oder unvollständige Bilderfassung zu vermeiden. Es können zwar größere Objektive verwendet werden, ihr Bildkreis könnte jedoch die Sensorfläche überschreiten, was zu einer Verschwendung von Auflösungspotenzial führt. Umgekehrt beleuchtet die Verwendung eines kleineren Objektivs an einem größeren Sensor nur einen zentralen Teil und verringert so das Sichtfeld.

Bei Messanwendungen, bei denen es auf präzise Messungen ankommt, kann eine absichtliche Überdimensionierung der Linse im Verhältnis zum Sensor von Vorteil sein. Dadurch wird der leistungsstarke Zentralbereich des Objektivs für eine optimale Detailauflösung genutzt. Die Wahl eines Objektivs mit einem kleineren Bildkreis führt zu Vignettierung (dunkle Ecken) oder sogar zu beschnittenen Bildern. Umgekehrt könnte ein viel größerer Bildkreis als nötig übertrieben sein und sich auf Leistung oder Kosten auswirken.

Das Verständnis der Sensorgröße und ihres Zusammenhangs mit der Objektivkompatibilität ist für eine fundierte Kameraauswahl von entscheidender Bedeutung. Verlassen Sie sich nicht nur auf die Bezeichnungen „Viertelzoll“ oder „Halbzoll“. Überprüfen Sie immer die Diagonalmessung und stellen Sie sicher, dass das gewählte Objektiv den Sensor ausreichend abdecken kann. Wenn jedoch kein mit der angegebenen Kamera kompatibles Objektiv verfügbar ist, muss der Designer möglicherweise eine andere Kamera wählen.

Mikrolinsen verbessern die Leistung kleinerer Pixel

Haben Sie sich jemals gefragt, wie Kamerasensoren immer kleiner und leistungsfähiger werden und dennoch atemberaubende Details einfangen? Ein Teil der Magie liegt in winzigen Linsen, sogenannten Mikrolinsen, die auf jedem Pixel sitzen. Stellen Sie sich einen Querschnitt eines Kamerasensors vor. Unten sitzt der Siliziumwafer, auf dem sich die Pixel befinden. Diese winzigen lichtempfindlichen Bereiche ähneln Eimern und sammeln Photonen, um das Bild zu erzeugen, das Sie sehen. Über den Pixeln liegt eine Schicht komplizierter Metalldrähte. Diese „Adern“ übertragen elektrische Signale, die jedes Pixel steuern und ihnen sagen, wann sie mit dem Sammeln von Licht beginnen und aufhören sollen und letztendlich, wie diese Daten in ein Bild umgewandelt werden sollen.

Bei Farbkameras liegt eine spezielle Schicht aus Rot-, Grün- und Blaufiltern über den Pixeln. Diese Filter wirken wie winzige Tore, die nur bestimmte Lichtwellenlängen durchlassen und so die Farbinformationen für jedes Pixel erzeugen. Stellen Sie sich nun vor, dass Lichtstrahlen in verschiedenen Winkeln in den Sensor einfallen. Einige könnten die winzigen Pixel-Buckets vermissen und der Erfassung entgehen. Betreten Sie die Mikrolinse! Diese Miniaturlinsen sitzen wie winzige Lupen auf jedem Pixel. Sie beugen und bündeln Lichtstrahlen und sorgen dafür, dass auch schräg einfallende Lichtstrahlen den lichtempfindlichen Bereich erreichen.

Fangen Sie mehr Licht ein

Mikrolinsen erhöhen die von jedem Pixel eingefangene Lichtmenge erheblich, was zu zwei Dingen führt: erhöhter Empfindlichkeit und verbesserter Auflösung. Dank der verbesserten Empfindlichkeit können Sensoren auch bei schlechten Lichtverhältnissen mehr Details erfassen. Die verbesserte Auflösung sorgt dafür, dass mehr Licht zu schärferen, klareren Bildern mit feineren Details führt. Diese Leistungssteigerung hat jedoch ihren Preis. Mikrolinsen sind dauerhafte Befestigungen, die mit dem Sensor verbunden sind. Während sie die Gesamtlichtaufnahme verbessern, können sie auch UV-Licht blockieren.

Einige Mikrolinsen bestehen aus Materialien, die UV-Licht absorbieren, wodurch die Fähigkeit des Sensors, bestimmte Arten von Informationen zu erfassen, eingeschränkt wird. Mikrolinsen schränken außerdem die Linsenflexibilität ein. Die feste Natur von Mikrolinsen schränkt die Verwendung bestimmter Linsentypen ein, die möglicherweise eine direkte Interaktion mit der Sensoroberfläche erfordern.

Mikrolinsen variieren je nach Sensor und Verwendungszweck in Größe und Form. Die Fortschritte in der Mikrolinsentechnologie gehen weiter und Forscher erforschen neue Materialien und Designs, um aktuelle Einschränkungen zu überwinden.

Mikrolinsen sind eine entscheidende Innovation in der Sensortechnologie und ermöglichen kleinere, effizientere Sensoren ohne Einbußen bei der Bildqualität. Aber ihre Dauerhaftigkeit und mögliche Einschränkungen der UV-Empfindlichkeit und Linsenkompatibilität sind wichtige Faktoren, die es zu berücksichtigen gilt. Die Wahl zwischen einem Sensor mit oder ohne Mikrolinsen hängt von Ihren spezifischen Bedürfnissen und Prioritäten ab. Bei schlechten Lichtverhältnissen oder Anwendungen, die eine hohe Auflösung erfordern, bieten Mikrolinsen erhebliche Vorteile.

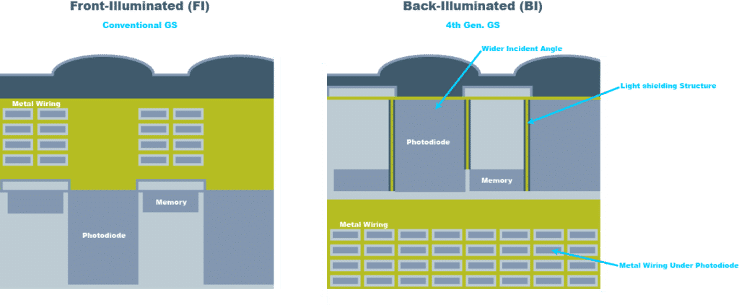

Von hinten beleuchtete Sensoren

Das Bestreben, mit kompakten Sensoren mehr Licht einzufangen und eine atemberaubende Bildqualität zu erzielen, hat zu spannenden Innovationen geführt. Ein solcher Fortschritt ist der rückwärtig beleuchtete Sensor mit Mikrolinsen. Diese Technologie stellt das Skript zum traditionellen Sensordesign um und bietet mehrere Vorteile. Stellen Sie sich den Querschnitt eines Sensors vor. Typischerweise sitzen Mikrolinsen auf den Pixeln, sammeln Licht und leiten es durch Schichten von Metalldrähten, bevor es die lichtempfindlichen Bereiche erreicht. Bei hinterleuchteten Sensoren sind die Rollen vertauscht. Mikrolinsen sind in die Farbfilter auf der Rückseite des Sensors integriert, sodass das Licht direkt in die Pixel eindringen kann, ohne die Metallverdrahtung zu durchlaufen.

Wenn man den Photonen ermöglicht, in die Rückseite des Sensors einzudringen, wird das S/N deutlich verbessert. Zu den Vorteilen gehören eine erhöhte Lichtaufnahme, eine verbesserte Empfindlichkeit und ein erweiterter Dynamikbereich. Durch die Eliminierung des Hindernisses durch Metallverkabelung wird die Lichtmenge, die jedes Pixel erreicht, deutlich erhöht, was zu einer verbesserten Empfindlichkeit für die Aufnahme schärferer Bilder bei schlechten Lichtverhältnissen und einem erweiterten Dynamikbereich für eine bessere Erfassung von Details in hellen und dunklen Bereichen einer Szene führt.

Zurück dünner werdende Waffeln

Um diese rückwärtig beleuchtete Sensortechnologie effektiv zu implementieren, muss das Siliziumsubstrat dünner gemacht werden, damit Licht mit minimaler Absorption durchgelassen werden kann. Allerdings ist das Ausdünnen von Wafern ein heikler Prozess, der in Gießereien oft als „Geheimrezept“ gilt. Dies geschieht, nachdem der gesamte Sensor hergestellt wurde, wodurch Fehler kostspielig werden. Stellen Sie sich den Übergang von der kontrollierten Welt der gasförmigen Vakuum-Dünnschichtverarbeitung zum chaotischen Bereich des mechanischen Läppens mit einer Aufschlämmung vor. Dieser unkonventionelle Ansatz, der dem Polieren eines Diamanten ähnelt, mag in einer Halbleitergießerei ungewöhnlich erscheinen, ist aber für das Erreichen der gewünschten Dicke von entscheidender Bedeutung. Dennoch gibt es mehrere Herausforderungen und Kompromisse.

Während hinterleuchtete Sensoren mit Mikrolinsen erhebliche Vorteile bieten, gibt es immer noch einige Herausforderungen, darunter Einschränkungen der UV-Empfindlichkeit sowie erhöhte Komplexität und Kosten aufgrund der zusätzlichen Verarbeitungsschritte und speziellen Techniken bei der Herstellung dieser Sensoren. Trotz dieser Herausforderungen stellt die rückwärtig beleuchtete Sensortechnologie mit Mikrolinsen einen großen Fortschritt in der Sensorleistung dar.

Da jedoch von hinten beleuchtete Sensoren in Telefonkameras immer häufiger eingesetzt werden, hat ein erheblicher Anstieg der Forschung und Entwicklung zu weiteren Verbesserungen der Effizienz, Empfindlichkeit und UV-Empfindlichkeit geführt und den Weg für noch beeindruckendere und vielseitigere Bildgebungslösungen geebnet. Die neuesten CMOS-Sensoren nutzen ein spezielles Mikrolinsendesign und Materialien in hinterleuchteten Sensoren, die die UV-Empfindlichkeit weiter optimieren können. Alternative Ausdünnungstechniken haben ebenfalls dazu beigetragen, den Ertrag zu steigern und die Kosten zu senken.

Technologien wie elektronenvervielfachende CCDs (EMCCDs) und zeitverzögerte Integration (TDI) bieten zwar eine noch höhere Empfindlichkeit, sind jedoch komplexer und fallen nicht in den Rahmen dieser Diskussion. Dennoch ist es wichtig zu wissen, dass es verschiedene Techniken gibt, die die Leistung bei schlechten Lichtverhältnissen bei bestimmten Kameratypen deutlich verbessern können.

Roll- und Global-Shutter-Sensoren

Nicht alle Kameras sind gleich. Die Branche bietet zwei Möglichkeiten: Rollläden und globale Rollläden. Wenn es um die Erfassung von Hochgeschwindigkeitsobjekten oder Bahnprozessen geht, ist die Wahl des Sensors von entscheidender Bedeutung. Im Allgemeinen hängt die Auswahl des richtigen Sensors von spezifischen Anwendungsbeschränkungen wie Geschwindigkeit und Präzision ab.

Ein Rolling Shutter ist wie ein schneller Scanner, der Datenzeilen nacheinander liest. Rolling-Shutter-Sensoren eignen sich hervorragend für viele alltägliche Bildaufgaben und die Aufnahme von Standbildern. Bei schnellen Bewegungen oder präzisen Messungen kann es jedoch zu Verzerrungen von Objekten im Bild kommen.

Man kann sich einen Global Shutter als eine Kamera vorstellen, die die gesamte Szene auf einmal aufnimmt, wie einen Schnappschuss, der sich perfekt für die Aufnahme sich schnell bewegender Objekte ohne Verzerrung eignet. Global-Shutter-Sensoren eignen sich ideal für wissenschaftliche Anwendungen und genaue Messungen.

Zeilenkameras

Haben Sie sich jemals gefragt, wie Kameras Bilder von Dingen aufnehmen, die sich auf Förderbändern bewegen? Zeilenkameras sind eine Möglichkeit, diese Aufgabe zu erfüllen. Zeilenkameras verwenden einen linearen 1D-Bildsensor, um jeweils eine einzelne Bildzeile zu erfassen und daraus ein 2D-Bild zur Analyse zu erstellen. Zeilenkameras werden häufig verwendet, um die Inspektion vorbeifahrender, sich bewegender Objekte zu erleichtern. Stellen Sie sich diese Kameras wie einen Laserstrahl vor, der mit hoher Geschwindigkeit eine einzelne Linie abtastet. Zeilenkameras eignen sich ideal für Bahnprozesse wie die Inspektion von Produkten auf Förderbändern. Zeilenkameras bauen Zeile für Zeile ein vollständiges Bild auf. Dazu müssen sie mit der Bewegung des Objekts synchronisiert werden.

So funktioniert es: Stellen Sie sich ein Förderband vor, auf dem sich ein Paket entlang bewegt. Eine Zeilenkamera verfügt über einen langen, dünnen Sensor, der, wenn er mit dem entsprechenden Objektiv ausgestattet ist, ein Bild über die gesamte Breite des Förderbands aufnimmt und dabei jeweils eine einzelne Pixelzeile erfasst. Bewegt sich das Paket nicht, erfasst die Kamera nur eine einzelne Bildzeile, wodurch es schwierig ist, sehr viele Details auf dem Paket zu erkennen. Während sich das Paket jedoch bewegt, erfasst die Kamera Zeile für Zeile und erstellt so ein vollständiges Bild.

Wenn die Zeilenkamera bewegungssynchron ausgelöst wird, kann so lange wie nötig ein Bild erzeugt werden. Dies gibt Zeilenkameras die Möglichkeit, kostengünstig hochauflösende Bilder großer Objekte zu erfassen. Neben großen, bewegten Objekten können mit Zeilenkameras auch rotierende zylindrische Objekte abgebildet werden. Wenn die Bewegung konstant ist oder ein Geschwindigkeitssensor oder Encoder verwendet werden kann, kann eine Zeilenkamera kostengünstig sein.

Emergent bietet eine Reihe von Zeilenkameras in 10GigE-, 25GigE- und 100GigE-Konfigurationen an, die darauf ausgelegt sind, den schnellen Anforderungen moderner Zeilenscan-Bildgebungsanforderungen gerecht zu werden. Diese Kamerafamilien gewährleisten einen zuverlässigen Einsatz und bieten Bildfunktionen ohne Kopien und ohne Datenverlust. Das Sortiment umfasst verschiedene Modelle, beginnend mit dem LR-4KG35 10GigE-Zeilenkamera, die Geschwindigkeiten von 172 kHz erreichen kann LZ-16KG5 100GigE Zeilenkamera, die schnelle 400KHz erreicht.

Kostengünstige hochauflösende Bildgebung

Zeilenkameras bieten einen überraschenden Kostenvorteil. Dies erreichen sie, indem sie im Vergleich zu Flächenkameras mehr Pixel auf einen einzelnen Wafer packen. Da die Zeilenscan-Technologie jeweils nur eine einzelne Zeile erfasst, ermöglicht sie eine dichtere Pixelplatzierung, was zu mehr Pixeln pro Wafer führt. Zeilensensoren sind üblicherweise mit 2000, 4000 oder sogar 16,000 Pixeln erhältlich. Vergleichbare Flächenarrays wären gigantisch und unglaublich teuer.

Im Allgemeinen ist ein 1K-Zeilensensor aufgrund der höheren Packungsdichte kostengünstiger als ein 1K-Flächenarray, was zu geringeren Kosten pro Pixel führt. Wenn es um die hochauflösende Abbildung bewegter Objekte (z. B. Förderbänder) geht und die Bewegung kontrolliert werden kann, sind Zeilenkameras eine kostengünstige Option. Zeilenkameras sind auch in der Lage, Farbinformationen zu erfassen.

Mit einer Zeilenkamera sind jedoch bestimmte Einschränkungen verbunden. Die Beleuchtung muss präzise sein und die Kamerablende muss die meiste Zeit geöffnet bleiben, was die Schärfentiefe verringert und es schwieriger macht, Objekte in unterschiedlichen Entfernungen von der Kamera aufzunehmen.

Flächenkameras

Während Zeilenkameras glänzen, wenn sich Objekte mit konstanter Geschwindigkeit bewegen und eine präzise Bilderfassung und effiziente Bildverarbeitung ermöglichen, eignen sich Flächenkameras besser für stationäre Objekte und Szenen mit unvorhersehbaren Bewegungen und größeren Anforderungen an die Schärfentiefe. Flächenkameras mit Flächensensoren verfügen über eine große Pixelmatrix oder -anordnung, die in einer einzigen Aufnahme ein 2D-Bild erzeugt.

Im Vergleich zu Zeilenkameras benötigen Flächenkameras in der Regel weniger Licht und die Beleuchtung ist aufgrund des rechteckigen Sichtfelds in der Regel einfacher zu installieren. Darüber hinaus können Flächenkameras Bilder mit kurzer Belichtungszeit mithilfe von Blitzlicht aufnehmen, das schnell große Lichtmengen auf den Sensor bringt. Die meisten Bilderfassungsanwendungen verwenden Flächenkameras.

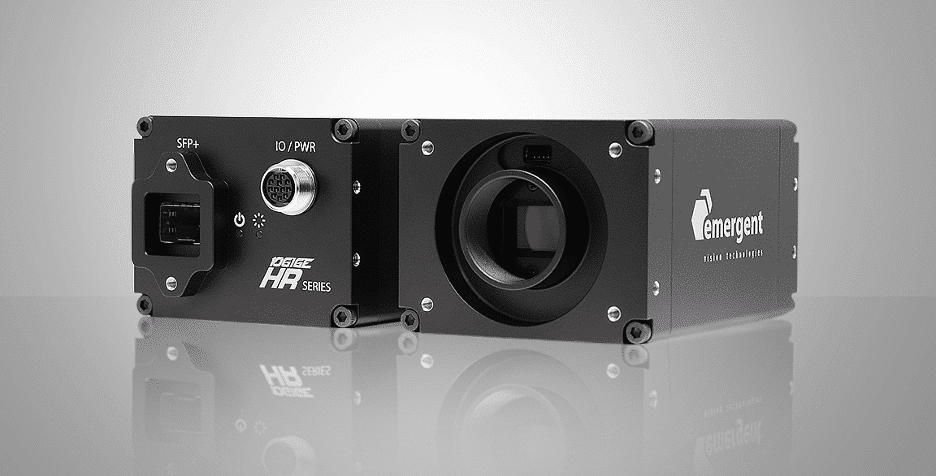

Einige Anwendungen erfordern möglicherweise hochauflösende Kameras, insbesondere in Situationen, in denen eine präzise Visualisierung kleiner Details oder eine umfassende Inspektion großer Teile unerlässlich ist. Um diesen Anforderungen gerecht zu werden, präsentiert Emergent eine umfangreiche Palette hochauflösender Modelle verschiedener Kamerafamilien, wie z. B. Eros 5GigE-, HR 10GigE- und Bolt 25GigE-Kameras.

Diese Modelle verfügen über fortschrittliche IMX-Sensoren der Sony Pregius S-Serie, darunter:

- 1 MP IMX547: HE-5000-SBL 5GigE-Kamera (45.5 fps), HR-5000-SBL 10GigE-Kamera (99fps)

- 1 MP IMX546: HE-8000-SBL 5GigE-Kamera (36.5 fps), HR-8000-SBL 10GigE-Kamera (73fps)

- 4 MP IMX545: HE-12000-SBL 5GigE-Kamera (34 fps), HR-12000-SBL 10GigE-Kamera (68fps)

- 13 MP IMX542: HE-16000-SBL 5GigE-Kamera (26 fps), HR-16000-SBL 10GigE-Kamera (52fps)

- 28 MP IMX541: HE-20000-SBL 5GigE-Kamera (21.5 fps), HR-20000-SBL 10GigE-Kamera (43fps)

- 47 MP IMX540: HE-25000-SBL 5GigE-Kamera (17.5 fps), HR-25000-SBL 10GigE-Kamera (35fps)

Die 25GigE Bolt-Serie nutzt auch den 5.1 MP IMX537 HB-5000-SB (269fps), 8.1MP IMX536 in seinem HB-8000-SB (201fps), 12.3MP IMX535 in seinem HB-12000-SB (192fps), 20.28MP IMX531 in seinem HB-20000-SB, und der 24.47 MP IMX530 in seinem HB-25000-SB (98fps). Die verfügbaren Optionen reichen bis hin zu höheren Auflösungen mit Kameras wie der Zenith HZ-100-G (103.7 MP Gpixel GMAX32103) und Bolzen HB-127-S (127.7 MP Sony IMX661).

Auch Schnittstellen- und Konnektivitätsoptionen können die Kameraauswahl erheblich beeinflussen, ebenso wie die Benutzerfreundlichkeit der Kamera, die Steuerungsoptionen und die verfügbaren Konnektivitätsanschlüsse für die Integration mit anderen Systemen. Über die zuvor besprochenen Faktoren hinaus können mehrere zusätzliche Überlegungen Ihre Kameraauswahl erheblich beeinflussen.

Farbe vs. Monochrom

Während die Farbwiedergabe für bestimmte Anwendungen wie die medizinische Diagnostik wichtig sein kann, stellen Monochromkameras oft eine praktikable Alternative dar. Generell bieten Monochromkameras mehrere Vorteile. Sie weisen in der Regel eine höhere Lichtempfindlichkeit als Farbkameras auf und ermöglichen so eine bessere Leistung bei schlechten Lichtverhältnissen. Darüber hinaus sind Monochromkameras im Allgemeinen günstiger als ihre Gegenstücke in Farbe, und Monochrombilder benötigen weniger Speicherplatz, sodass sie für Anwendungen mit begrenzter Datenspeicherung vorzuziehen sind.

Die gebräuchlichsten Farbkameras sind Single-Chip- und Single-Sensor-Kameras. Das am häufigsten verwendete Filtermuster ist als Bayer-Muster bekannt. Innerhalb dieses Musters decken Rotfilter ein Pixel ab, zwei Grünfilter erstrecken sich über zwei Pixel und ein Blaufilter überlagert ein weiteres Pixel. Für jedes Pixel gibt es also eines, das mit einem Rotfilter ausgestattet ist, zwei mit Grün und eines mit Blau. Da das menschliche Auge stärker auf grüne Wellenlängen reagiert, werden zwei Grünfilter verwendet. Dadurch kann der Sensor Farben originalgetreu wiedergeben und so widerspiegeln, wie Menschen sie wahrnehmen.

Diese Farbfilter sind integraler Bestandteil; Sie sind dauerhaft auf den Pixeln befestigt und können daher nicht entfernt oder verändert werden. Sie lassen selektiv bestimmte Wellenlängen des Lichts jedes Pixel erreichen und erzeugen so die charakteristischen zwei grünen, ein rotes und ein blaues Muster des Bayer-Filters. Es ist jedoch wichtig zu beachten, dass nur etwa ein Drittel der einfallenden Photonen diese Filter erfolgreich passieren.

Daher benötigen Farbkameras im Allgemeinen mehr Licht als Monochromkameras. Dies liegt daran, dass Farbsensoren nur einen Teil des verfügbaren Lichts für jedes Pixel erfassen, im Gegensatz zu Monochromsensoren, die das gesamte Licht erfassen. Während einzelne Pixel genau erfasst werden, ist für die Wiederherstellung des Vollfarbbildes eine Interpolation erforderlich. Stellen Sie sich ein winziges Pixelraster auf Ihrem Monitor vor. Jedes Pixel benötigt eine Mischung aus Rot, Grün und Blau, um die tatsächliche Farbe darzustellen.

Demosaicing-Algorithmen analysieren die umgebenden roten, grünen und blauen Pixel, um diese Mischung für jedes Pixel abzuschätzen. Dieser Prozess kann jedoch Kanten leicht verwischen und die wahrgenommene Auflösung verringern. Für eine präzise Farbgenauigkeit verwenden professionelle Fotografen einen Macbeth ColorChecker. Dieses standardisierte Diagramm enthält eine Reihe von Farben und ermöglicht einen Vergleich der von einer Kamera erfassten Farben mit der Referenz. Dies kann auch bei automatisierten Inspektionskameraanwendungen nützlich sein, bei denen eine korrekte Farbidentifizierung erforderlich ist. Achten Sie besonders auf Rottöne, da diese für eine Vision-System-Kamera schwierig sein können.

Kurzwelleninfrarot (SWIR) und Polarisationsbildgebung

Bestimmte Szenarien erfordern spezielle Bildgebungstechnologien, wie z. B. die Erkennung von fälschungssicheren Wasserzeichen oder Sicherheitscodes auf Etiketten oder die Bildgebung durch Flaschen hindurch, um genaue Füllstände sicherzustellen. SWIR-Kameras Lösungen wie sie von Emergent Vision Technologies angeboten werden, können in solchen Fällen zuverlässig eingesetzt werden. Die Eros 5GigE-Kameraserie von Emergent umfasst Modelle wie HE-300-SI, HE-1300-SI, HE-3200-SIund HE-5300-SI, ausgestattet mit fortschrittlichen SenSWIR-Sensoren von Sony, die Bilder im Bereich von 400 bis 1700 nm aufnehmen können. Diese Kameras nutzen Sonys 0.33 MP IMX991-, 1.31 MP IMX990-, 3.14 MP IMX993- und 5.24 MP IMX992-Sensoren.

Herkömmliche bildgebende Verfahren stoßen bei der Inspektion glänzender oder reflektierender Materialien, die Blendung verursachen, auf Herausforderungen. Polarisationskameras wie Emergents HR-12000-S-P, HR-5000-S-P, HE-5000-S-PM monochrom und HE-5000-S-PC Farbkameras lösen diese Probleme, indem sie Helligkeit und Farbe verbessern und die Erkennung kleinster Details ermöglichen, die von herkömmlichen Sensoren oft übersehen werden. Polarisationsbildgebung eignet sich für Szenarien, in denen die „Unterscheidung von reflektierten und durchgelassenen Szenen“ erforderlich ist, und eignet sich zur Identifizierung von Oberflächenunregelmäßigkeiten wie Schmutz, erhabenen Bereichen, Vertiefungen, Kratzern und Verformungen.

Diese Polarisationskameras basieren auf den 5-Megapixel-Sensoren Sony IMX250MZR (Mono) und IMX250MYR (Farbe) sowie den 12-Megapixel-Sensoren Sony IMX253MZR (Mono) und IMX253MYR (Farbe). Diese Sensoren integrieren über jeder Linse mikroskopisch kleine Drahtgitterpolarisatoren mit Polarisationswinkeln von 0°, 45°, 90° und 135° in Vier-Pixel-Clustern; Durch diese Interpolation wird die effektive Auflösung des Sensors um das Vierfache reduziert, wobei jeder Vier-Pixel-Block in ein einzelnes Ausgabepixel umgewandelt wird.

Hochgeschwindigkeitsbildgebung

Wenn das Video hauptsächlich zur Analyse dient, priorisieren Sie Funktionen wie eine hohe Bildrate, um sich schnell bewegende Motive aufzunehmen und eine reibungslose Zeitlupenwiedergabe zu ermöglichen. Die hohe Auflösung liefert detaillierte Bilder für eine genaue Datenanalyse, und ein hoher Dynamikbereich kann eine realistische Beleuchtung erfassen und Detailverluste in hellen oder dunklen Bereichen vermeiden. Priorisieren Sie bei Live-Video-Feeds Funktionen wie niedrige Latenz, um Videos mit minimaler Verzögerung für Echtzeitreaktionen zu streamen, sowie effiziente Datenkomprimierung, um die Bandbreitennutzung für reibungsloses Streaming zu reduzieren.

Auch Aufnahmeoptionen können bei der Kamerawahl eine wichtige Rolle spielen. Live-Streaming ohne Aufzeichnung ist ideal für Anwendungen, bei denen eine Echtzeitanalyse entscheidend ist und keine Datenspeicherung erforderlich ist. Für eine Hochgeschwindigkeitsaufzeichnung, die sich schnell bewegende Ereignisse zur späteren Analyse erfassen kann, sind jedoch leistungsstarke Speicherlösungen wie RAID oder Solid-State-Laufwerke erforderlich. Es ist wichtig zu bedenken, dass Kameras mit höherer Auflösung und Bildrate mehr Speicherplatz benötigen. Komprimierte Aufnahmeformate bieten kleinere Dateigrößen, können jedoch die Bildqualität beeinträchtigen. Erwägen Sie für die Speicherung je nach Datenvolumen und Zugriffsgeschwindigkeitsanforderungen RAM, RAID-Arrays oder Solid-State-Laufwerke.

Da immer mehr Bildgebungsanwendungen über die Werkseinstellungen hinausgehen, wird die Fähigkeit von GigE Vision zur Vereinfachung von Vorgängen für Originalgerätehersteller (OEMs) noch wichtiger. Die Länge des Kabels ist in Szenarien von entscheidender Bedeutung, in denen zwischen der Kamera und dem PC eine beträchtliche Entfernung besteht, beispielsweise bei Überwachungs-, Transport- und Sporttechnikanwendungen. Die Verfügbarkeit kostengünstiger Transceiver-Komponenten wie SFP+ (10G), SFP28 (25G) und QSFP28 (100G) ermöglicht die Verwendung von Singlemode-Fasern über Entfernungen von bis zu 10 km oder mehr.

Zero-Copy-Bildgebungstechnik für Hochgeschwindigkeits-Bildverarbeitung

Im Kontext von GigE Vision ist die Nutzung von Transmission Control Protocol (TCP) oder Remote Direct Memory Access (RDMA) und RDMA over Converged Ethernet (RoCE) und RoCE v2 aufgrund einer besonderen Herausforderung entstanden. Diese Herausforderung beinhaltet die Zerlegung von Ethernet-Paketen beim Empfänger, um Bilddaten in einem kontinuierlichen Format an die Anwendung zu liefern, was die Trennung der Ethernet-Paket-Header erfordert. Obwohl dieser Prozess durch Software erreichbar ist, führt er zu Leistungseinbußen mit einer Verdreifachung der Speicherbandbreite und einer erhöhten CPU-Auslastung – ein Aspekt, der von RDMA-Benutzern häufig hervorgehoben wird, wenn sie traditionelles GigE Vision und RDMA vergleichen.

Emergent Vision Technologies hat eine Bildübertragungsmethode ohne Kopien eingeführt, eine wesentliche Voraussetzung für die Erzielung optimaler Leistung bei der Hochgeschwindigkeitsbildgebung. Diese Technik reduziert die CPU-Last und die Speicherbandbreite erheblich, indem sie die inhärenten Aufteilungsfunktionen moderner Netzwerkschnittstellenkarten nutzt. Eine begleitende Animation zeigt die Auswirkungen der Speicherbandbreitennutzung ohne Kopie bei Verwendung des verfeinerten GigE Vision Stream Protocol (GVSP) für die Bildübertragung ohne Kopie. Der erste Abschnitt der Animation zeigt ein nicht optimiertes System, bei dem ein Pufferüberlauf in der Netzwerkkarte auftritt, während der folgende Abschnitt den reibungslosen und zuverlässigen Datenfluss zeigt, der durch Nullkopie und Systemoptimierung ermöglicht wird.

Budget

Die Kosten spielen bei der Kaufentscheidung einer Kamera eine entscheidende Rolle und können ebenso wichtig sein wie Auflösung und Geschwindigkeit. Es ist sehr wahrscheinlich, dass zu diesem Zeitpunkt die Entscheidung für den Kauf einer Industriekamera zur Inspektion oder für eine andere Bildverarbeitungsaufgabe aufgrund der Kosteneffizienz und des Return on Investment (ROI) des Bildverarbeitungssystems bereits gefallen ist.

Wenn es um Bildverarbeitungssysteme geht, bestimmen die Kosten, was erreicht werden kann, und das Kamerabudget wird auf Grundlage dieser Bewertungen festgelegt. Obwohl eine Inspektion auf einer sehr detaillierten Detailebene attraktiv sein könnte, könnte sie auch unerschwinglich teuer sein. Kamerakäufer müssen die Kosten gegen den ROI abwägen. Ein guter Ausgangspunkt ist es, ausgehend von den Kosten rückwärts zu arbeiten. Es erzwingt die Priorisierung wirklich wesentlicher Funktionen für die Anwendung und stellt die finanzielle Machbarkeit sicher.

Da die Kosten ein wesentlicher Faktor bei der Auswahl der richtigen Kamera sind, sollten Funktionen und Spezifikationen entsprechend den Budgetbeschränkungen priorisiert werden. Diese Überlegungen helfen dabei, den Bereich der Kameras einzugrenzen, die für eine bestimmte Anwendung geeignet sind. Durch die Priorisierung jeder Einschränkung und deren Bewertung anhand des Budgets werden einige wenige Kameras ausgewählt, die für das jeweilige Projekt am besten geeignet sind.

Priorisieren Sie Anwendungsbeschränkungen

Im Allgemeinen ist es am besten, zunächst die Größe des zu scannenden Objekts und das kleinstmögliche Merkmal zu berücksichtigen, das auf diesem Objekt unterschieden werden muss. Je kleiner das Pixel, desto kleinere Details können aufgelöst werden. Es steht eine große Auswahl an Kameras mit unterschiedlichen Spezifikationen zur Auswahl, von Zeilenkameras mit bis zu 16K, Flächenkameras mit 80 MP oder höher bis hin zu Hochgeschwindigkeitskameras, die Tausende von Bildern pro Sekunde erfassen.

Hochauflösende und schnelle Kameras benötigen eine hohe Bandbreite. Hinzu kommen Kabellänge und Videoprotokolle: Analog (RS-170), USB, Camera Link (CL), CoaXPress und GigE. Die Wahl des Protokolls hängt häufig von den Anforderungen an Bandbreite und Kabellänge ab. Beachten Sie die verschiedenen Objektivanschlüsse wie M12, CS, C, F, M42, M75 und bedenken Sie, dass der Objektivanschluss umso größer ist, je größer der Bildsensor ist. Um den minimalen Bildkreis zu bestimmen, der für einen linearen Array-Sensor erforderlich ist, berücksichtigen Sie die Länge des Sensors ähnlich der Diagonale des Flächenarrays.

Verschiedene andere Funktionen, die möglicherweise bewertet werden müssen, umfassen wählbaren ROI (Region of Interest), FPGAs, Kameraspeicher, eingebettete Bildverarbeitung und mehr. Entscheiden Sie, wie groß das Objektiv sein muss, um den Anforderungen an Sichtfeld und Arbeitsabstand gerecht zu werden. Denken Sie über das elektromagnetische Spektrum nach und finden Sie genau heraus, wie Sie die erforderlichen interessanten Merkmale und nichts anderes beleuchten können. Wählen Sie zwischen Monochrom und Farbe, UV, polarisiert, NIR, SWIR, Multispektral oder Hyperspektral. Die Berücksichtigung all dieser Prioritäten hilft dabei, die für eine Anwendung geeigneten Kameras einzugrenzen.

GPUDirect: Imaging ohne Datenverlust

Bei all seinen Hochgeschwindigkeits-GigE-Vision-Kameras mit hoher Auflösung gewährleistet Emergent erstklassige Leistung durch den Einsatz eines optimierten GigE-Vision-Ansatzes und einer allgegenwärtigen Ethernet-Infrastruktur für zuverlässige und robuste Datenerfassung und -übertragung, anstatt sich auf proprietäre oder Point-to-Lösungen zu verlassen -Punktschnittstellen und Bilderfassungskarten. Darüber hinaus unterstützt Emergent Direktübertragungstechnologien wie NVIDIAs GPUDirect, das die Übertragung von Bildern direkt in den GPU-Speicher ermöglicht und so die Auswirkungen großer Datenübertragungen auf die System-CPU und den Speicher abschwächt. Ein solches Setup nutzt die leistungsstärkere GPU-Fähigkeit für die Datenverarbeitung und behält gleichzeitig die Kompatibilität mit dem GigE Vision-Standard und die Interoperabilität mit kompatibler Software und Peripheriegeräten bei.

Mit der Emergent eCapture Pro-Software können Kameras mit GPUDirect-Technologie Bilder auch direkt in den GPU-Speicher übertragen. Durch den Einsatz dieser Technologie wird eine Null-CPU-Auslastung und ein Null-Speicherbandbreiten-Image ohne Datenverlust erreicht. Durch den Einsatz leistungsfähigerer GPU-Funktionen reduziert diese Technologie die Auswirkungen großer Datenübertragungen auf die CPU und den Speicher des Systems und behält gleichzeitig die Kompatibilität mit dem GigE Vision-Standard und die Interoperabilität mit kompatiblen Peripheriegeräten und Software bei.

Neue Kameras:

Mit 10-, 25- und 100-GigE-Vision-Technologien hat Emergent Spitzenleistungen in einer Vielzahl von Märkten gezeigt, darunter maschinelles Sehen und Unterhaltung. Mit einer umfangreichen Auswahl an Kameraoptionen, darunter 10GigE-, 25GigE- und 100GigE-Kameras mit 0.5 MP bis 100 MP+, mit Bildraten von bis zu 3462 Bildern pro Sekunde bei voller Auflösung von 2.5 MP, um unterschiedlichen Bildanforderungen gerecht zu werden.

EMERGENT GIGE VISION-KAMERAS FÜR MACHINE-VISION-ANWENDUNGEN

SWIR-, Polarisations- und UV-Kameras

| Modell | Chroma | Auflösung | Frame Rate | Interface | Sensorname | Pixel Größe | |

|---|---|---|---|---|---|---|---|

|

HE-5300-SI | SCHWIR | 5.24MP | 130fps | 1, 2.5, 5GigE | Sony IMX992 | 3.45 × 3.45 μm |

|

HE-3200-SI | SCHWIR | 3.14MP | 170fps | 1, 2.5, 5GigE | Sony IMX993 | 3.45 × 3.45 μm |

|

HE-1300-SI | SCHWIR | 1.31MP | 135fps | 1, 2.5, 5GigE | Sony IMX990 | 5 × 5 μm |

|

HE-300-SI | SCHWIR | 0.33MP | 260fps | 1, 2.5, 5GigE | Sony IMX991 | 5 × 5 μm |

|

HE-5000-S-PM | Monopolarisiert | 5MP | 81.5fps | 1, 2.5, 5GigE | Sony IMX250MZR | 3.45 × 3.45 μm |

|

HE-5000-S-PC | Farbpolarisiert | 5MP | 81.5fps | 1, 2.5, 5GigE | Sony IMX250MYR | 3.45 × 3.45 μm |

|

HR-8000-SB-U | UV | 8.1MP | 145fps | 10GigE SFP+ | Sony IMX487 | 2.74 × 2.74 μm |

Flächenkameras

| Modell | Chroma | Auflösung | Frame Rate | Interface | Sensorname | Pixel Größe | |

|---|---|---|---|---|---|---|---|

|

HE-5000-SBL-M | Mono | 5.1MP | 45.5fps | 1, 2.5, 5GigE | Sony IMX547 | 2.74 × 2.74 μm |

|

HE-5000-SBL-C | Farbe, | 5.1MP | 45.5fps | 1, 2.5, 5GigE | Sony IMX547 | 2.74 × 2.74 μm |

|

HE-8000-SBL-M | Mono | 8.1MP | 36.5fps | 1, 2.5, 5GigE | Sony IMX546 | 2.74 × 2.74 μm |

|

HE-8000-SBL-C | Farbe, | 8.1MP | 36.5fps | 1, 2.5, 5GigE | Sony IMX546 | 2.74 × 2.74 μm |

|

HE-12000-SBL-M | Mono | 12.4MP | 34fps | 1, 2.5, 5GigE | Sony IMX545 | 2.74 × 2.74 μm |

|

HE-12000-SBL-C | Farbe, | 12.4MP | 34fps | 1, 2.5, 5GigE | Sony IMX545 | 2.74 × 2.74 μm |

|

HE-16000-SBL-M | Mono | 16.13MP | 26fps | 1, 2.5, 5GigE | Sony IMX542 | 2.74 × 2.74 μm |

|

HE-16000-SBL-C | Farbe, | 16.13MP | 26fps | 1, 2.5, 5GigE | Sony IMX542 | 2.74 × 2.74 μm |

|

HE-20000-SBL-M | Mono | 20.28MP | 21.5fps | 1, 2.5, 5GigE | Sony IMX541 | 2.74 × 2.74 μm |

|

HE-20000-SBL-C | Farbe, | 20.28MP | 21.5fps | 1, 2.5, 5GigE | Sony IMX541 | 2.74 × 2.74 μm |

|

HE-25000-SBL-M | Mono | 24.47MP | 17.5fps | 1, 2.5, 5GigE | Sony IMX540 | 2.74 × 2.74 μm |

|

HE-25000-SBL-C | Farbe, | 24.47MP | 17.5fps | 1, 2.5, 5GigE | Sony IMX540 | 2.74 × 2.74 μm |

|

HR-5000-SBL-M | Mono | 5.1MP | 99fps | 10GigE SFP+ | Sony IMX547 | 2.74 × 2.74 μm |

|

HR-5000-SBL-C | Farbe, | 5.1MP | 99fps | 10GigE SFP+ | Sony IMX547 | 2.74 × 2.74 μm |

|

HR-8000-SBL-M | Mono | 8.1MP | 73fps | 10GigE SFP+ | Sony IMX546 | 2.74 × 2.74 μm |

|

HR-8000-SBL-C | Farbe, | 8.1MP | 73fps | 10GigE SFP+ | Sony IMX546 | 2.74 × 2.74 μm |

|

HR-12000-SBL-M | Mono | 12.4MP | 68fps | 10GigE SFP+ | Sony IMX545 | 2.74 × 2.74 μm |

|

HR-12000-SBL-C | Farbe, | 12.4MP | 68fps | 10GigE SFP+ | Sony IMX545 | 2.74 × 2.74 μm |

|

HR-16000-SBL-M | Mono | 16.13MP | 52fps | 10GigE SFP+ | Sony IMX542 | 2.74 × 2.74 μm |

|

HR-16000-SBL-C | Farbe, | 16.13MP | 52fps | 10GigE SFP+ | Sony IMX542 | 2.74 × 2.74 μm |

|

HR-20000-SBL-M | Mono | 20.28MP | 43fps | 10GigE SFP+ | Sony IMX541 | 2.74 × 2.74 μm |

|

HR-20000-SBL-C | Farbe, | 20.28MP | 43fps | 10GigE SFP+ | Sony IMX541 | 2.74 × 2.74 μm |

|

HR-25000-SBL-M | Mono | 24.47MP | 35fps | 10GigE SFP+ | Sony IMX540 | 2.74 × 2.74 μm |

|

HR-25000-SBL-C | Farbe, | 24.47MP | 35fps | 10GigE SFP+ | Sony IMX540 | 2.74 × 2.74 μm |

|

HB-5000-SB-M | Mono | 5.1MP | 269fps | 25GigE SFP28 | Sony S IMX537 | 2.74 × 2.74 μm |

|

HB-5000-SB-C | Farbe, | 5.1MP | 269fps | 25GigE SFP28 | Sony S IMX537 | 2.74 × 2.74 μm |

|

HB-8000-SB-M | Mono | 8.1MP | 201fps | 25GigE SFP28 | Sony S IMX536 | 2.74 × 2.74 μm |

|

HB-8000-SB-C | Farbe, | 8.1MP | 201fps | 25GigE SFP28 | Sony S IMX536 | 2.74 × 2.74 μm |

|

HB-12000-SB-M | Mono | 12.4MP | 192fps | 25GigE SFP28 | Sony S IMX535 | 2.74 × 2.74 μm |

|

HB-12000-SB-C | Farbe, | 12.4MP | 192fps | 25GigE SFP28 | Sony S IMX535 | 2.74 × 2.74 μm |

|

HB-16000-SB-M | Mono | 16.13MP | 145fps | 25GigE SFP28 | Sony S IMX532 | 2.74 × 2.74 μm |

|

HB-16000-SB-C | Farbe, | 16.13MP | 145fps | 25GigE SFP28 | Sony S IMX532 | 2.74 × 2.74 μm |

|

HB-20000-SB-M | Mono | 20.28MP | 100fps | 25GigE SFP28 | Sony S IMX531 | 2.74 × 2.74 μm |

|

HB-20000-SB-C | Farbe, | 20.28MP | 100fps | 25GigE SFP28 | Sony S IMX531 | 2.74 × 2.74 μm |

|

HB-25000-SB-M | Mono | 24.47MP | 98fps | 25GigE SFP28 | Sony S IMX530 | 2.74 × 2.74 μm |

|

HB-25000-SB-C | Farbe, | 24.47MP | 98fps | 25GigE SFP28 | Sony S IMX530 | 2.74 × 2.74 μm |

|

HB-127-SM | Mono | 127.7MP | 17fps | 25GigE SFP28 | Sony IMX661 | 3.45 × 3.45 μm |

|

HB-127-SC | Farbe, | 127.7MP | 17fps | 25GigE SFP28 | Sony IMX661 | 3.45 × 3.45 μm |

|

HZ-100-GM | Mono | 103.7MP | 24fps | 100GigE-QSFP28 | Gpixel GMAX32103 | 3.2 × 3.2 μm |

|

HZ-100-GC | Farbe, | 103.7MP | 24fps | 100GigE-QSFP28 | Gpixel GMAX32103 | 3.2 × 3.2 μm |

Zeilenkameras

| Modell | Chroma | Auflösung | Leitungsrate | Tri-Tarif | Interface | Sensorname | Pixel Größe | |

|---|---|---|---|---|---|---|---|---|

|

LR-4KG35-M | Mono | 4Kx2 | 172KHz | 57KHz | 10GigE SFP+ | Gpixel GL3504 | 3.5 × 3.5 μm |

|

LR-4KG35-C | Farbe, | 4Kx2 | 172KHz | 57KHz | 10GigE SFP+ | Gpixel GL3504 | 3.5 × 3.5 μm |

|

TLZ-9KG5-M | Mono | 9K 256 TDI | 608KHz | - | 100GigE-QSFP28 | Gpixel GLT5009BSI | 5 × 5 μm |

|

LB-8KG7-M | Mono | 8Kx4 | 300KHz | 100KHz | 25GigE SFP28 | Gpixel GL7008 | 7 × 7 μm |

|

LB-8KG7-C | Farbe, | 8Kx4 | 300KHz | 100KHz | 25GigE SFP28 | Gpixel GL7008 | 7 × 7 μm |

|

LZ-16KG5-M | Mono | 16Kx16 | 400KHz | 133KHz | 100GigE-QSFP28 | Gpixel GL5016 | 5 × 5 μm |

|

LZ-16KG5-C | Farbe, | 16Kx16 | 400KHz | 133KHz | 100GigE-QSFP28 | Gpixel GL5016 | 5 × 5 μm |

Weitere Kameraoptionen finden Sie in unserem interaktives Systemdesigner-Tool.