NUTZUNG DER MASCHINENVISION ZUR ERKENNUNG UND VORBEUGUNG VON FERTIGUNGSFEHLEN

Mit dem Vormarsch von Industrie 4.0 stehen Hersteller zunehmend unter Druck, die Geschwindigkeit und Genauigkeit ihrer Produktionslinien zu verbessern.

Herstellungsfehler können zu einer hohen finanziellen Belastung werden. Nach Angaben der American Society of Quality geben viele Unternehmen 15–20 % ihres Umsatzes für qualitätsbezogene Kosten aus, einige auch Ausgaben von bis zu 40 % des Gesamtbetriebs. Durch das Erkennen von Fehlern, bevor Produkte auf den Markt kommen – und einen Schritt weiter zu gehen, um sie zu verhindern, bevor sie auftreten – werden Ausschuss und Nacharbeit reduziert, Zeit gespart und das Endergebnis eines Herstellers verbessert.

Anstatt sich allein auf das menschliche Auge zu verlassen, greifen Hersteller auf Bildverarbeitungslösungen zurück, die aus Software- und Hardwareelementen bestehen, um visuelle Inspektionen von Produkten durchzuführen. Maschinelles Sehen entfernt Subjektivität aus dem Inspektionsprozess, liefert konsistentere Ergebnisse und beseitigt das Risiko menschlicher Fehler.

Anwendungen

WIE MACHINE VISION FEHLERERKENNUNG ZUR QUALITÄTSKONTROLLE DURCHFÜHRT

Durch maschinelles Sehen kann Software visuelle Eingaben von Kameras empfangen, analysieren, was sie sieht, und auf diese Informationen reagieren. Bei einer maschinellen Bildverarbeitungslösung zur Fehlererkennung erfassen Industriekameras Bilder, während Produkte die Produktionslinie passieren. Eine Fehlererkennungssoftware scannt die Bilder auf Produktfehler, markiert Anomalien, löst einen Ausschussmechanismus aus, um das Produkt vom Band zu werfen, und sendet Warnungen an die Manager vor Ort. Im Gegensatz zu menschlichen Inspektoren Bildverarbeitungskameras Erfassen und speichern Sie Daten, die Hersteller im Laufe der Zeit über Probleme in ihrem Produktionsprozess informieren können, die zu Fehlern führen, sodass sie Präventionsmaßnahmen ergreifen können.

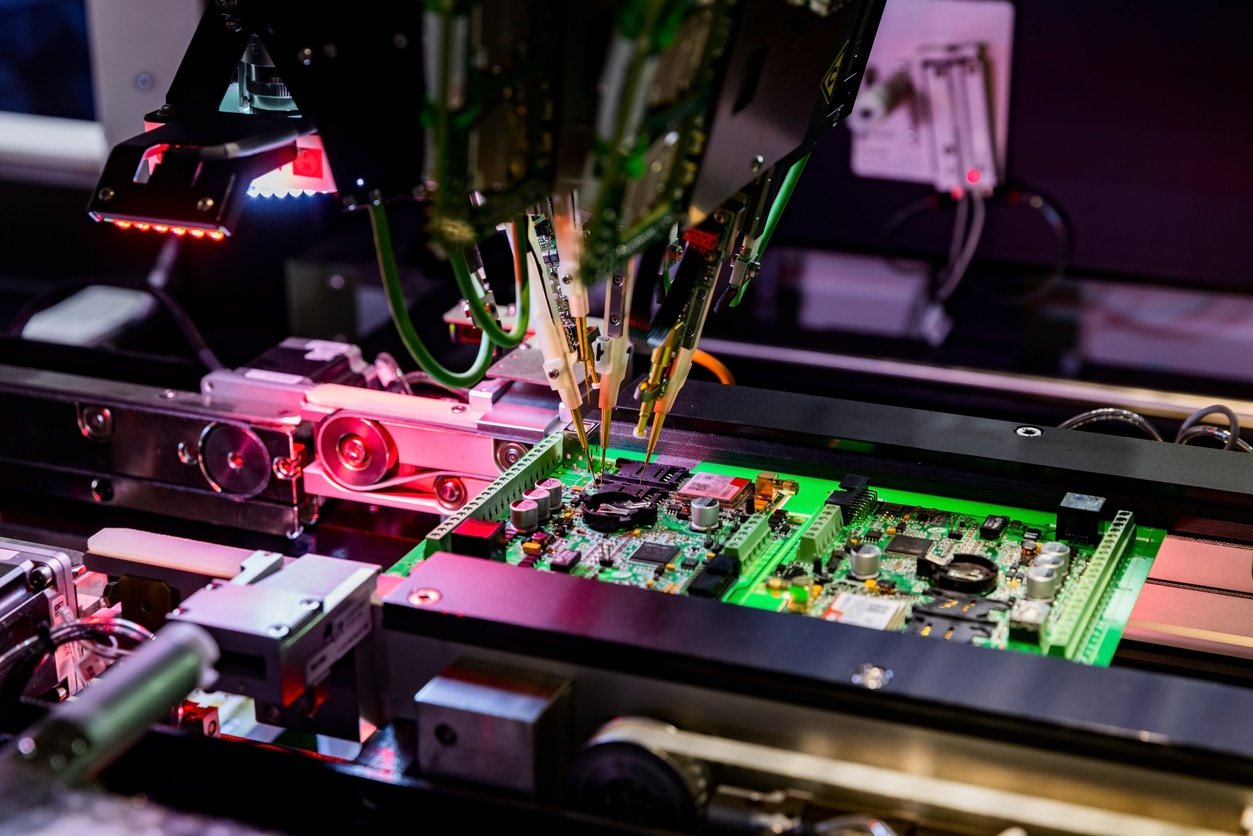

Feige 1: Bildverarbeitungskameras können dabei helfen, Fehler zu erkennen und die ordnungsgemäße Montage elektronischer Leiterplatten sicherzustellen.

Obwohl sich die Technologie schnell weiterentwickelt, gibt es Faktoren, die die maschinelle Bildverarbeitung für einige Qualitätskontrollanwendungen zu einer hervorragenden Wahl machen, für andere jedoch nicht. Bildverarbeitungslösungen zum Einsatz mit Hochgeschwindigkeitskameras kann viele Teile pro Sekunde prüfen, wenn nach bestimmten Details gesucht wird, aber die Software könnte mit unerwarteten Anomalien wie Änderungen im Erscheinungsbild der Teile aufgrund von Verschmutzung, Ausrichtung oder Okklusion zu kämpfen haben. Beispielsweise könnte in einer Halbleiterfertigungsanlage eine maschinelle Bildverarbeitungslösung zur Fehlererkennung die Qualität jedes einzelnen Siliziumwafers bewerten und Artikel aus dem Band werfen, wenn sie Risse oder Mängel aufweisen.

Obwohl es Unterschiede zwischen den Lösungen auf dem Markt gibt, folgen die meisten einem Muster, um sie zum Laufen zu bringen und die Ergebnisse im Laufe der Zeit zu verbessern.

- Merkmalsextraktion: Zunächst legt ein Hersteller der Software eine Vorlage zur Prüfung auf Mängel vor. Oft handelt es sich dabei um ein Bild, in dem bestimmte Faktoren hervorgehoben sind, so dass bei Auftreten von Anomalien diese als Mängel gekennzeichnet werden. Wenn beispielsweise eine Ventilfeder in einem Automobil verbogen ist, sendet die Bildverarbeitungslösung eine Warnung und ein Roboterarm entfernt sie aus der Leitung.

- Training des Modells: Zu Beginn der Implementierung geben menschliche Manager beschriftete Bilder an die Software weiter, um deren Wissen über die Vorlage zu vertiefen. Die Bilder werden in Gutteile oder Schlechtteile eingeteilt, je nachdem, ob ein bestimmter Mangel auftritt.

- Testing: Nach gründlichen Tests und häufigen Korrekturen, um sicherzustellen, dass die Fehlererkennung korrekt ist, ist die Lösung ohne ständige menschliche Aufsicht betriebsbereit.

Da maschinelles Sehen in der Lage ist, Muster in Fehlern schnell zu katalogisieren, was einen Vorteil gegenüber menschlichen Prüfern bietet, kann das System dabei helfen, die Grundursachen der Fehler zu ermitteln. Durch die Anwendung von Fertigungsanalysen in Echtzeit kann die Software genau markieren, welche Variable falsch war – etwa ein falsch ausgerichtetes Produktetikett – und außerdem feststellen, wann und wie oft der Fehler auftritt, sodass Manager die Grundursachen identifizieren können.

ANWENDUNGSFÄLLE DER BILDVERARBEITUNG ZUR IDENTIFIZIERUNG VON FERTIGUNGSFEHLEN

Für die Erkennung und Verhinderung von Bildverarbeitungsdefekten in Produktionsanlagen gibt es ein breites Spektrum potenzieller Anwendungen. Einige Beispiele sind:

- Fertigungsanlagen: Hochauflösende Bildverarbeitungskameras können selbst kleinste Auffälligkeiten in Produkten erkennen. Dieses Maß an detaillierter Prüfung ist besonders wichtig, wenn es sich bei dem Produkt um ein medizinisches Gerät oder eine Automotorkomponente handelt, bei der jeder Defekt gefährlich sein könnte.

- Lebensmittelproduktion: Im Lebensmittelproduktionsprozess kann die maschinelle Bildverarbeitung falsch etikettierte Verpackungen erkennen, Texte und Barcodes auf Etiketten lesen und die Menge hinzugefügter Zutaten überwachen, beispielsweise Gewürze auf Kartoffelchips. Durch die Bereitstellung von Dokumentationen und Daten zu Details wie Etiketten, Inhaltsstoffen und Sicherheitssiegeln helfen Bildverarbeitungslösungen Lebensmittelherstellern, strenge Industriestandards und -vorschriften einzuhalten.

- Transport: Mithilfe der Bildverarbeitungstechnologie können Fahrzeughersteller Montageprozesse überwachen und Fehler in Echtzeit erkennen. Beispielsweise könnte eine Software einen Fehler in der Oberfläche eines Autoreifens erkennen und einen Menschen oder Roboter benachrichtigen, ihn vom Band zu nehmen. Der Einsatz automatisierter Systeme zur Identifizierung und Entfernung defekter Teile trägt zur Einhaltung gesetzlicher Vorschriften bei, da er einen Strom aufgezeichneter Daten liefert.

Medizinische Industrie: Für Krankenhäuser, Ärzte und Patienten hergestellte Produkte müssen sorgfältig geprüft werden, um sicherzustellen, dass sie korrekt versiegelt und gekennzeichnet sind. Auswirkungen von Medikationsfehlern jedes Jahr mehr als sieben Millionen Patienten in den USA, und maschinelle Bildverarbeitungslösungen könnten diese Zahl reduzieren, indem sie Fehler erkennen, die menschliche Prüfer nicht erkennen können.

GPUDIRECT: BILDVERLUST OHNE DATENVERLUST

Emergent nutzt die Leistung und Zuverlässigkeit von GigE-Vision und die allgemein zugängliche Ethernet-Infrastruktur, um eine robuste und zuverlässige Datenerfassung und -übertragung zu gewährleisten und eine außergewöhnliche Leistung zu liefern. Durch die Verwendung eines optimierten GigE Vision-Setups und durch die Unterstützung von Technologien wie NVIDIA GPUDirect Für die direkte Bildübertragung in den GPU-Speicher entlastet Emergent die CPU und den Speicher des Systems bei der Verarbeitung umfangreicher Datenübertragungen. Stattdessen nutzt es die Leistung von GPUs für Datenverarbeitungsaufgaben und behält gleichzeitig die Kompatibilität mit dem GigE Vision-Standard und die Interoperabilität mit kompatibler Software und Peripheriegeräten bei.

MUSTERPASSEND

Das folgende Video zeigt, wie einfach man einen Algorithmus erstellen und prototypisieren kann, um einen qualitativ hochwertigen Mustervergleich durchzuführen, während man nur seinen benutzerdefinierten GPU-Cuda-Code schreibt.

INFERENZ

Das folgende Video zeigt, wie einfach man sein eigenes trainiertes Inferenzmodell hinzufügen und testen kann, um die Erkennung und Klassifizierung beliebiger Objekte durchzuführen. Trainieren Sie Ihr Modell einfach mit PyTorch oder TensorFlow und fügen Sie es Ihrem eigenen eCapture Pro-Plug-in hinzu. Instanziieren Sie dann das Plug-in, verbinden Sie es mit der gewünschten Kamera und klicken Sie auf „Ausführen“ – einfacher geht es nicht.

Mit gut trainierten Modellen können Inferenzanwendungen mithilfe der GPU Direct-Funktionalität von Emergent mit vielen Emergent-Kameras auf einem einzigen PC mit einigen GPUs entwickelt und bereitgestellt werden – niemand bietet Leistungsanwendungen wie Emergent.

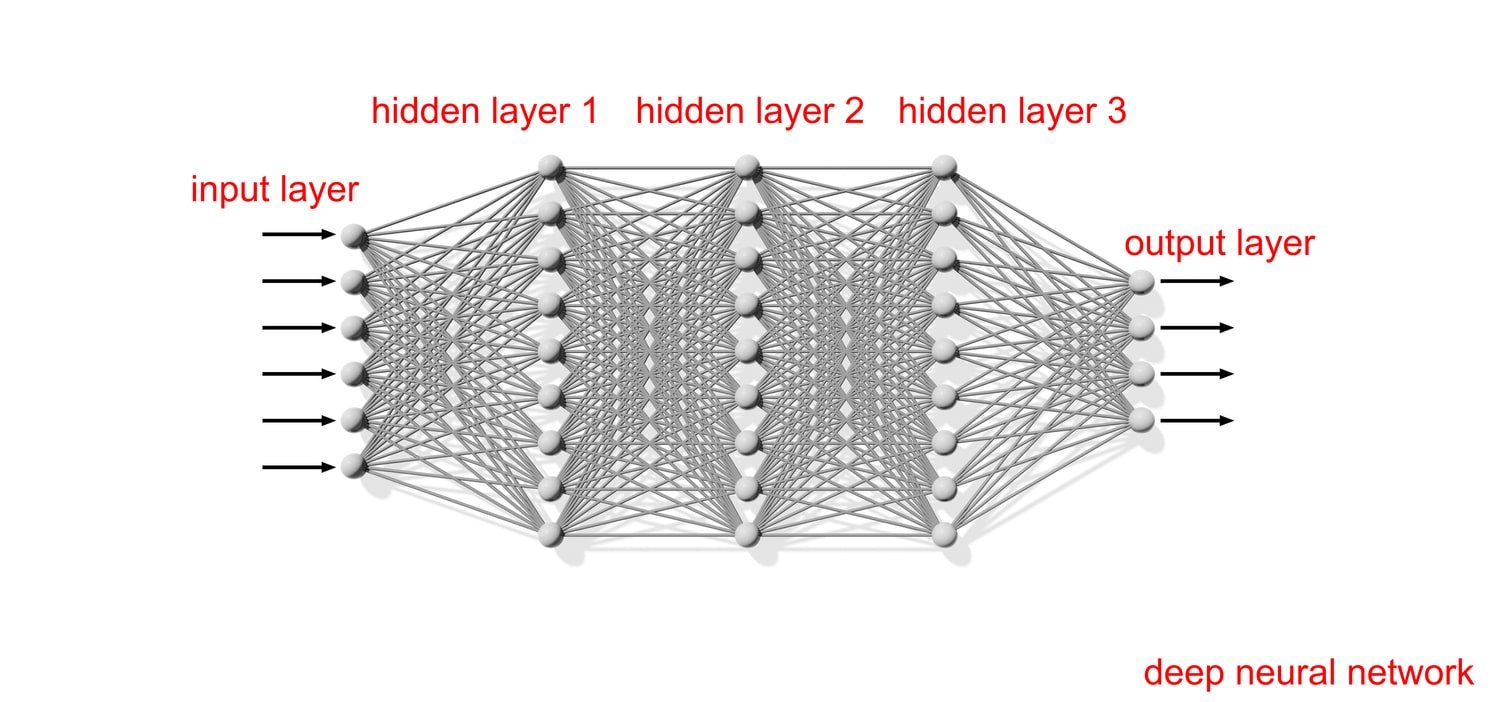

Feige 2: Neuronale Netze sind dem menschlichen Gehirn nachempfunden und stellen eine Teilmenge des maschinellen Lernens dar, die das Herzstück von Deep-Learning-Algorithmen bildet und es einem Computer ermöglicht, anhand von Trainingsbeispielen zu lernen, bestimmte Aufgaben auszuführen.

POLARISATION

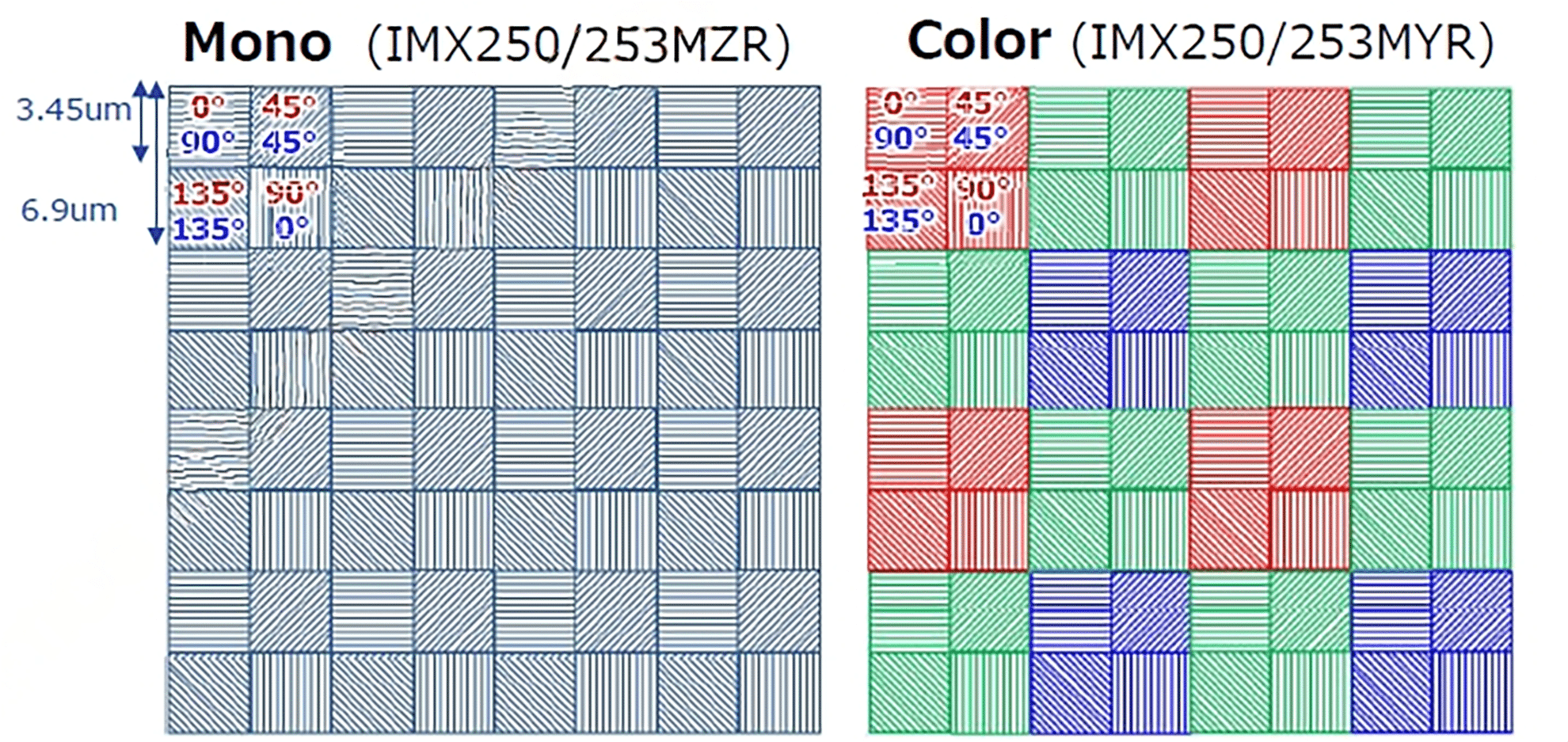

Feige 3: In den CMOS-Polarisationssensoren von Sony PolarSens haben winzige Drahtgitterpolarisatoren über jeder Linse Polarisationswinkel von 0°, 45°, 90° und 135° in Vier-Pixel-Gruppen.

EMERGENT GIGE VISION-KAMERAS FÜR ANWENDUNGEN ZUR FEHLERERKENNUNG

| Modell | Chroma | Auflösung | Frame Rate | Interface | Sensorname | Pixel Größe | |

|---|---|---|---|---|---|---|---|

|

HR-5000-SM | Mono | 5MP | 163fps | 10GigE SFP+ | Sony IMX250LLR | 3.45 × 3.45 μm |

|

HR-5000-SC | Farbe, | 5MP | 163fps | 10GigE SFP+ | Sony IMX250LLR | 3.45 × 3.45 μm |

|

HB-12000-SB-M | Mono | 12.4MP | 100fps | 10GigE SFP+ | Sony IMX535 | 2.74 × 2.74 μm |

|

HB-12000-SB-C | Farbe, | 12.4MP | 100fps | 10GigE SFP+ | Sony IMX535 | 2.74 × 2.74 μm |

|

HB-25000-SB-M | Mono | 24.47MP | 98fps | 25GigE SFP28 | Sony S IMX530 | 2.74 × 2.74 μm |

|

HB-25000-SB-C | Farbe, | 24.47MP | 98fps | 25GigE SFP28 | Sony S IMX530 | 2.74 × 2.74 μm |

|

HZ-10000-GM | Mono | 10MP | 1000fps | 100GigE-QSFP28 | Gpixel GSPRINT4510 | 4.5 × 4.5 μm |

|

HZ-10000-GC | Farbe, | 10MP | 1000fps | 100GigE-QSFP28 | Gpixel GSPRINT4510 | 4.5 × 4.5 μm |

Weitere Kameraoptionen finden Sie in unserem interaktives Systemdesigner-Tool.