産業用 AI: ディープラーニングがどのようにマシンビジョンシステムを補完するか

産業オートメーションの分野では、人工知能 (AI) が非常に流行語になっています。 誇大広告はさておき、AI は産業分野にニッチ市場を開拓し、適切に設計および実装されれば工場現場に多大な価値を提供します。 ディープラーニング (人間の脳の学習プロセスを模倣する畳み込みニューラル ネットワーク (CNN) などのニューラル ネットワークを使用する AI のサブセット) は、主観的な検査の決定や検査シーンを支援する機能により、人気のある産業用 AI ツールとして浮上しています。変動性や複雑性が高いため、特定の特徴を識別することが困難な場合。

ディープ ラーニング ソリューションの選択に関して、メーカーには、PyTorch や TensorFlow などの確立されたフレームワークを活用して社内でソリューションをプログラミングするなど、いくつかの選択肢があります。 メーカーには、既製のソリューションを購入するか、アプリケーション固有の AI 対応システムまたは製品を選択するという選択肢もあります。

ただし、ディープラーニングはスタンドアロンのテクノロジーではありません。 むしろ、従来のシステムと並行して導入すると、 マシンビジョン これらの技術を活用すると、エレクトロニクスや半導体の検査、消費者向けパッケージ製品の検査、自動車の検査などのアプリケーションに導入される産業オートメーション システムの全体的な機能を強化する自動検査の強力なツールになります。

アプリケーション

ディープ ラーニング: マシン ビジョン ツールボックス用のツール

マシンビジョンとは、ハードウェアのセットを指します。 カメラ、光学系、照明 — 適切な照明とともに ソフトウェア、マシンビジョンシステムによって行われた画像分析に基づいて企業が特定の機能を実行するのに役立ちます。 マシン ビジョン アプリケーションの XNUMX つの主要なカテゴリは、検査、識別、ガイダンス、計測です。すべてのシステムの中心となるのは、コンポーネントの機能、信頼性、使いやすさの向上に役立つソフトウェアです。

従来のマシン ビジョン ソフトウェアは、大量の自動イメージング タスクを実行できる個別のルールベースのアルゴリズムを指します。 一般的なマシン ビジョン アルゴリズムの例には、エッジ検出、画像変換、コンテンツ統計、相関、幾何学的検索、OCR/OCV、相関などが含まれます。 ディープ ラーニングをマシン ビジョン システムに組み込む場合は、ディープ ラーニングをすべてのマシン ビジョン アプリケーションに導入できるわけではないことを覚えておくことが重要です。

もちろん、特定のアプリケーションでは、ディープラーニングは従来のアプローチでは埋められないギャップを埋めることができます。 たとえば、溶接部を検査するマシン ビジョン システムは、溶接部の画像上の特定の詳細を検索しますが、各溶接部は固有であるため、ソフトウェアがアルゴリズム的に定義するのは困難です。 一方、ディープラーニングは、人間が溶接部を検査する場合と同様に、より主観的な特徴を識別できます。 金色のイメージと同じに見えないわずかに非晶質の溶接は、必ずしも欠陥のある溶接と同等であるとは限りません。

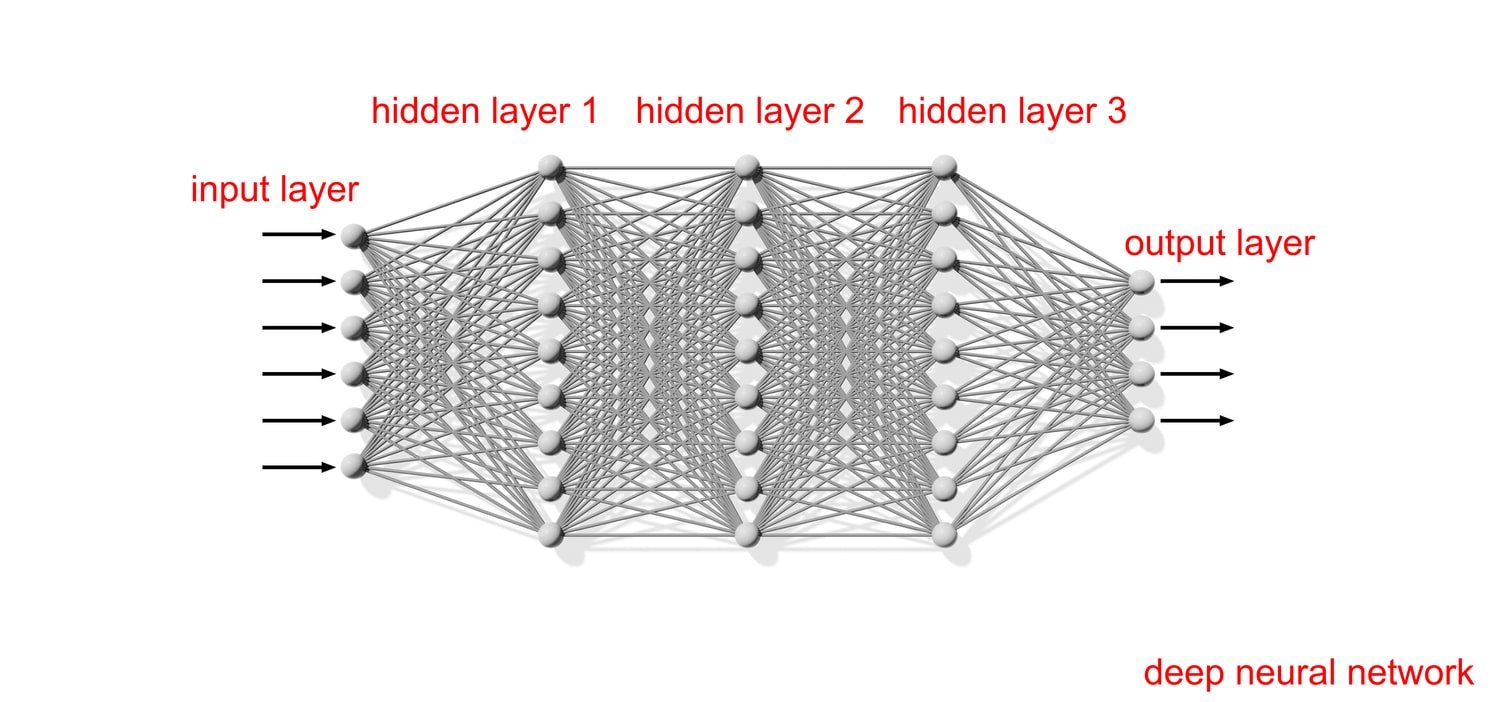

図1: 人間の脳をモデルにしたニューラル ネットワークは、深層学習アルゴリズムの中心となる機械学習のサブセットであり、コンピューターがトレーニング サンプルに基づいて特定のタスクの実行を学習できるようになります。

ディープラーニングがあらゆるレベルの成功を達成するには、高品質のデータセットを作成する必要があります。 メーカーは、検出する必要がある欠陥のクラスや特徴を表す画像を「良好な画像」とともにアップロードすることで、初期データセットを作成できます。 対象分野の専門家チームは、初期データセットにラベルを付けてモデルをトレーニングし、元のデータセットからのテスト画像で結果を検証し、運用環境でのパフォーマンスをテストし、新しいケース、機能、または欠陥をカバーするためにモデルを再トレーニングすることができます。 これが完了し、マシン ビジョン システムへのディープ ラーニングの実装に関するすべての要素が考慮されると、ソフトウェアは、欠陥検出、機能分類、アセンブリ検証に加えて、複雑または非常に変化しやすいシーンの検査を支援し始めることができます。混合部品や製品が入った箱のピッキングなど、特定の特徴を識別するのが難しい場合があります。

ディープラーニングカメラの考慮事項

決まり文句かもしれませんが、ディープ ラーニング アプリケーションの開発に関して言えば、「ゴミは入ったらゴミは出る」というのは事実です。 従来のマシン ビジョン アプローチと同様に、ディープ ラーニング アプリケーションでは不十分な照明や光学設計を克服することはできず、トレーニングとラベル付け用の高品質のデータ セットを作成するには依然として高品質の画像が必要です。 これは、画像に十分なコントラストを提供するための最適な照明設定、または場合によっては特殊な照明スキームを実装することを意味します。 たとえば、特定のアプリケーションでは、単一の部品に対して複数の検査が必要な場合があります。これは、オブジェクトの有無やサイズや形状の確認などのために、異なる照明設定を行うことを意味します。

もちろん、マシン ビジョンやディープ ラーニングのアプリケーションを成功させるには照明が不可欠ですが、システムは必要な速度と解像度で画像をキャプチャするカメラの機能を中心に展開しています。 画像は、可能な限り最高の機能コントラストを備えたターゲット アプリケーションに適した解像度である必要がありますが、他のいくつかのアプリケーションの制約や考慮事項も考慮する必要があります。これらには、サイズ、重量、出力、画像化されるオブジェクトの速度、ストリーミングと録画が含まれます。 、カラーとモノクロ、最小欠陥サイズ、最小視野。

部品や対象物が非常に高速で移動し、詳細を分析するためにシステムがオブジェクトの動作を停止する必要がある高速アプリケーションには、より高速なカメラが必要になります。一方、高レベルの詳細を必要とするシステムには、高性能のカメラが必要になります。解像度のイメージセンサー。 Emergent Vision Technologies は産業用機器の設計と開発を専門としています。 高速カメラ 現在のマシンビジョン市場で最高のフレームレートと解像度を実現します。

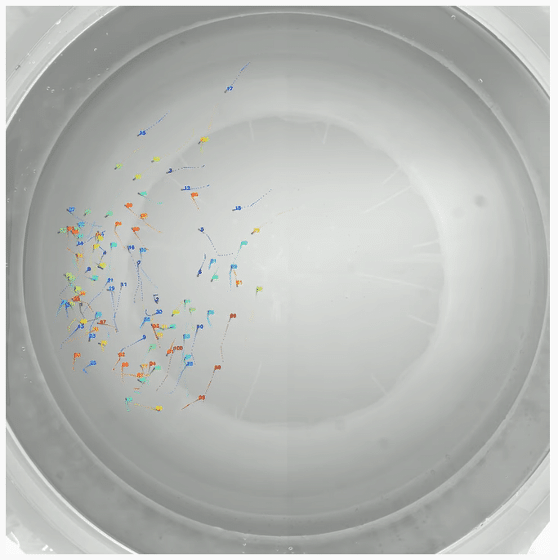

図2: intracker.ai ツールは、動物の種類や大きさに関係なく、標識のない個々の動物の位置を識別して追跡します。 このアプリケーションでは、研究者らは Emergent の 20MP 10GigE カメラを使用して、100 匹のゼブラフィッシュの幼魚の集団を 99.9% の精度で追跡しました。

確立されたものを活用する GigEビジョン および GenICam 標準、緊急 マシンビジョンカメラ 独自の取得ハードウェアやケーブル配線を必要とせずに、準拠したソフトウェア アプリケーションにシームレスに統合できます。エマージェントの 10GigE, 25GigE, 100GigE カメラ 大量のデータを生成し、産業用 PC などのホスト デバイスに迅速かつ確実に送信する必要があるアプリケーション向けに、100MP+ を超える解像度と 3500fps に近いフレーム レートを提供します。

Emergent カメラは、接続インターフェイスとしてイーサネットを使用することにより、センサーの解像度や速度を犠牲にすることなく、最大 100 Gbps の接続速度を実現します。 さらに、カメラは IEEE1588 PTP を使用して同期することができ、CPU 使用率なしで 1 μs 未満でイベントの高速画像キャプチャを行うことができ、最大 10KM のケーブル長でも CPU 使用率、メモリ帯域幅、レイテンシ、ジッターを絶対最小に抑えることができます。

推論

以下のビデオは、独自のトレーニング済み推論モデルを簡単に追加およびテストして、任意のオブジェクトの検出と分類を実行できる方法を示しています。 PyTorch または TensorFlow を使用してモデルをトレーニングし、これを独自の eCapture Pro プラグインに追加するだけです。 次に、プラグインをインスタンス化し、目的のカメラに接続して、「実行」をクリックします。これほど簡単なことはありません。

十分にトレーニングされたモデルを使用すると、Emergent の GPU Direct 機能を使用して、複数の GPU を備えた XNUMX 台の PC 上で多数の Emergent カメラを使用して推論アプリケーションを開発および展開できます。Emergent のようなパフォーマンス アプリケーションを行う人は誰もいません。

カスタムプラグインの開発

この短いクリップでは、顧客が独自のカスタム プラグインを作成して、その後 eCapture Pro にロードしてリアルタイムの結果を生成できるプロセスを説明します。 最大のシステム密度の達成に向けてシステム全体のスループットをテストするために、任意のプラグインを XNUMX つまたは複数のカメラに供給できることに注意してください。

GPUDIRECT: データ損失ゼロのイメージング

現在、多くのアプリケーションは、計算能力要件を処理するためにディープ ラーニング タスクに NVIDIA GPU を利用しています。 Emergent のマシンビジョン カメラは NVIDIA とも互換性があります GPUダイレクト 画像を GPU メモリに直接転送できるテクノロジーです。 GPUDirect テクノロジーを活用するある緊急顧客にとって、これは、次のようなシステムを導入することを意味しました。 ボルト HB-12000-SB 25GigE カメラ、サーバーと CPU 100 台、デュアルポート XNUMXG XNUMX 台 ネットワークインターフェースカード (NIC)、24x ポート スイッチ XNUMX つ、および NVIDIA GPU XNUMX つ。

このシステムでは、お客様は 24x を導入しました HB-12000-SB カメラ、12.4MP Sony Pregius S IMX535 を搭載し、60fps で画像をキャプチャし、データを GPU に直接送信します。 データ損失ゼロのイメージング CPU 使用率もメモリ帯域幅もゼロです。 と H.265圧縮、画像はローカルのディスクに保存できるだけでなく、YouTube などのリアルタイム メッセージング プロトコル (RTMP) クライアントにストリーミングすることもできます。 GPUDirect などの革新的な処理テクノロジを活用することで、エンド ユーザーはフレームの損失を心配することなく、大量のデータを迅速かつ効率的に取得、転送、処理できます。

AI および深層学習アプリケーション用の緊急 GIGE ビジョン カメラ

| モデル | クロマ | 解像度 | フレームレート | インタフェース | センサー名 | 画素サイズ | |

|---|---|---|---|---|---|---|---|

|

HR-1800-SM | Mono | 1.76MP | 660fps | 10GigE SFP+ | ソニーIMX425 | 9×9μm |

|

HR-1800-SC | 色圏 | 1.76MP | 660fps | 10GigE SFP+ | ソニーIMX425 | 9×9μm |

|

HR-5000-SM | Mono | 5MP | 163fps | 10GigE SFP+ | ソニー IMX250LLR | 3.45×3.45μm |

|

HR-5000-SC | 色圏 | 5MP | 163fps | 10GigE SFP+ | ソニー IMX250LQR | 3.45×3.45μm |

|

HR-12000-SM | Mono | 12MP | 80fps | 10GigE SFP+ | ソニー IMX253LLR | 3.45×3.45μm |

|

HR-12000-SC | 色圏 | 12MP | 80fps | 10GigE SFP+ | ソニー IMX253LQR | 3.45×3.45μm |

|

HR-25000-SB-M | Mono | 24.47MP | 51fps | 10GigE SFP+ | ソニーIMX530 | 2.74×2.74μm |

|

HR-25000-SB-C | 色圏 | 24.47MP | 51fps | 10GigE SFP+ | ソニーIMX530 | 2.74×2.74μm |

追加のカメラオプションについては、こちらをご覧ください。 インタラクティブなシステムデザイナーツール。