기술 포털

기술 포털

머신 비전 시스템의 구조

회사 개요

모든 머신 비전 시스템의 주요 구성 요소는 카메라이지만 다음 구성 요소가 모두 없으면 머신 비전 시스템이 완전하지 않습니다.

- 조명

- 렌즈

- 카메라

- 케이블 연결

- 인터페이스 주변기기

- 컴퓨팅 플랫폼

- 소프트웨어

머신 비전 시스템의 각 구성 요소는 기계가 외부 세계를 보고 더 나은 결정을 내릴 수 있도록 돕는 시스템의 전반적인 목적을 달성하는 데 중요한 역할을 합니다. 이 목적을 달성하려면 빛을 포착하는 것부터 디지털 이미지를 전달하고 처리하는 것까지 정보의 흐름이 원활하도록 구성 요소를 질서 있게 배치해야 합니다.

다음 이미지는 각 구성 요소의 위치를 보여줍니다. 이미지에 언급된 각 구성 요소는 아래에서 자세히 설명합니다.

조명

카메라가 물체의 이미지를 캡처할 때 실제로 하는 일은 물체가 반사한 빛을 캡처하는 것입니다. 빛이 흡수되거나 반사되는 정도는 물체의 표면이 투명한지, 반투명한지 또는 불투명한지에 따라 다릅니다.

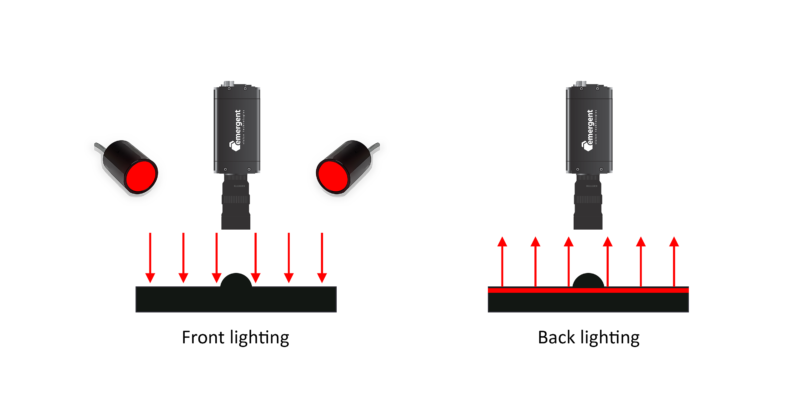

카메라가 분석에 필요한 모든 세부 사항을 캡처할 수 있도록 하려면 머신 비전 시스템에 적절한 조명이 장착되어야 합니다. 머신 비전 시스템의 엔지니어링 조명을 위한 다양한 기술은 광원의 위치, 각도, 반사 특성 및 색상 스펙트럼을 기반으로 사용할 수 있습니다. 이것들은:

- 위치 기반 조명 기술

- 전면 조명 – 카메라와 광원이 모두 같은 쪽에서 대상 장면을 향하고 있습니다.

- 백라이트 – 카메라와 광원은 대상 장면을 중앙에 두고 서로 마주보게 위치합니다.

- 전면 조명 – 카메라와 광원이 모두 같은 쪽에서 대상 장면을 향하고 있습니다.

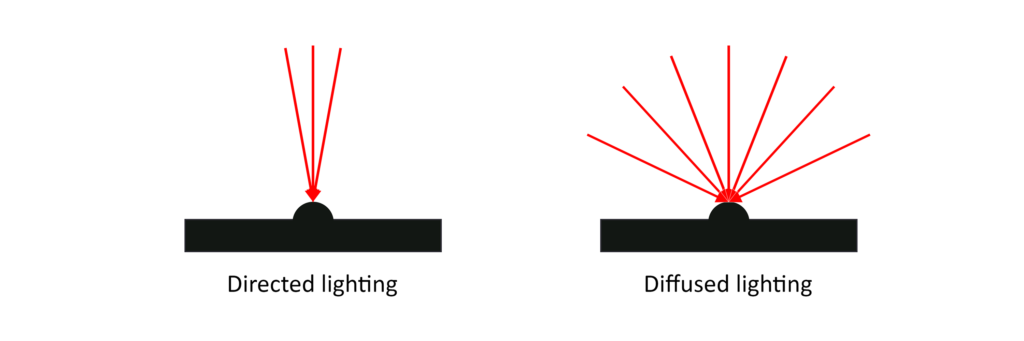

- 각도 기반 조명 기술

-

- 직접 조명 – 매우 좁은 각도로 퍼지는 단일 광선 또는 광선 그룹이 대상 장면의 모든 지점을 비춥니다. 직접 조명은 강한 그림자를 드리우고 이미지에서 텍스처를 두드러지게 합니다.

- 확산 조명 – 넓은 각도로 퍼지는 광선이 대상 장면의 모든 지점을 비춥니다. 확산 조명은 그림자를 거의 또는 전혀 드리우지 않으므로 음영을 제거하고 텍스처를 더욱 분명하게 만듭니다.

- 직접 조명 – 매우 좁은 각도로 퍼지는 단일 광선 또는 광선 그룹이 대상 장면의 모든 지점을 비춥니다. 직접 조명은 강한 그림자를 드리우고 이미지에서 텍스처를 두드러지게 합니다.

-

-

- 축 확산 조명 – 빔 스플리터는 확산된 빛을 대상에서 아래쪽으로 반사하여 균일한 조명을 만듭니다.

-

-

-

- 확산 돔 조명 – 반구 모양의 거울은 확산된 빛을 반사하여 대상을 비춥니다.

-

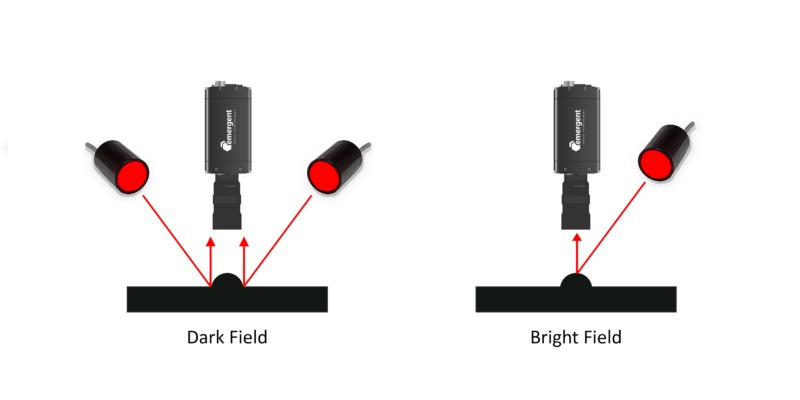

- 반사 자연 기반 조명 기술

-

- 암시야 조명 - 광원은 그 빛이 거울에 반사되거나 카메라의 시야로 직접 전송되지 않도록 배치됩니다.

-

- 명시야 조명 - 광원은 그 빛이 거울에서 반사되거나 카메라의 시야로 직접 전송되도록 배치됩니다.

- 패턴 기반 조명 기법

- 구조화된 조명 – 구조화된 조명의 경우 점, 격자 또는 보다 복잡한 모양과 같은 조명 패턴이 물체에 비스듬히 투사됩니다.

- 색상 스펙트럼 기반 조명 기술

-

- RGB 조명 - 단색 이미징의 경우 빛은 일반적으로 빨간색, 녹색 또는 파란색의 좁은 파장 대역입니다.

-

- 백색 조명 – 컬러 이미징을 위해서는 백색광이 필요합니다.

- 광 스펙트럼 기반 조명 기술

-

- 자외선 조명 – 자외선(UV)은 가시광선(200nm~400nm)보다 짧은 파장(400nm~780nm)의 스펙트럼입니다. UV 조명의 경우 물체를 비추기 위해 UV 광을 방출하는 소스가 사용됩니다.

-

- SWIR 조명 – SWIR(Shortwave Infrared) 스펙트럼(900nm ~ 2,500nm)은 가시광선에 가장 가까운 적외선(780nm 및 1mm) 영역입니다. SWIR 조명의 경우 SWIR 조명을 방출하는 광원을 사용하여 물체를 비춥니다.

-

- 근적외선 조명 – 근적외선(NIR) 파장은 780-1400nm 범위입니다. NIR 조명의 경우 NIR 빛을 방출하는 광원을 사용하여 물체를 비춥니다.

렌즈

렌즈는 장면을 통해 들어오는 빛의 초점을 모아 장면을 확대하는 장치입니다. 간단히 말해서 렌즈는 카메라가 외부 세계를 선명하게 볼 수 있게 해줍니다. 카메라에 보이는 장면은 다음과 같이 간주됩니다. 집중하고있는 가장자리가 날카롭게 보이거나 초점없는 가장자리가 흐릿하게 보이는 경우. 머신 비전 카메라에 사용되는 렌즈는 종종 고정 초점 또는 조정 가능한 초점을 갖는 반면, 예를 들어 DSLR 및 Point & Shoot 카메라와 같은 소비자 카메라에 사용되는 렌즈는 자동 초점을 갖는다는 점에 유의하는 것이 중요합니다. 화각(AoV), 시야(FoV), 물체 거리, 초점 거리, 조리개 및 F-스톱은 렌즈를 분류할 때 자주 사용되는 용어 중 일부입니다. 다음은 이러한 용어에 대한 간략한 설명입니다.

- 화각(AoV)

화각(AoV)은 렌즈를 통해 볼 수 있는 영역의 각도 범위(도 단위)를 나타냅니다. AoV는 호환되는 센서 크기를 사용하면서 렌즈를 무한대로 초점을 맞춰서 파생되는 모든 렌즈의 사양입니다. 주어진 렌즈와 센서 크기에 대해 AoV는 일정합니다.

- 시야(FoV)

FoV(Field of View)는 렌즈를 통해 볼 수 있는 영역의 직사각형 범위를 말하지만 FoV는 초점 거리와 물체 거리에 따라 달라집니다. FoV는 AoV의 경우 렌즈를 무한대로 초점을 맞추는 것과는 반대로 특정 초점 거리에서 캡처되는 것을 설명합니다.

- 물체 거리

물체 거리는 렌즈와 대상 물체 사이의 작동 거리입니다.

- 초점 거리

초점 거리는 렌즈와 초점 사이의 거리입니다. 초점이 센서에 있으면 이미지에 초점이 맞춰집니다.

- 조리개 및 F-스톱

조리개는 센서에 도달하는 빛의 양을 제어하는 렌즈의 개구부입니다. 조리개의 크기는 F-스톱 값으로 측정됩니다. 큰 F-스톱 값은 작은 조리개 개방을 의미하며 그 반대의 경우도 마찬가지입니다.

렌즈의 종류

1. 엔토센트릭 / 엔도센트릭 렌즈 – 이 렌즈는 초점 거리가 고정되어 있으며 머신 비전 카메라에 사용되는 가장 일반적인 렌즈입니다.

2. 매크로 렌즈 – 매크로 렌즈는 고배율을 달성하도록 설계되었으며 일반적으로 05x에서 10x의 배율 범위에서 작동합니다.

3. 텔레센트릭 렌즈 – 텔레센트릭 렌즈는 이미징 각도가 없으며 수직 뷰를 생성합니다. 장면.

카메라

렌즈 마운트, 이미지 센서, 프로세서, 전력 전자 장치 및 통신 인터페이스를 포함하는 보호 케이스를 머신 비전에서 카메라라고 합니다.

모든 카메라의 핵심에는 들어오는 빛(광자)을 전기 신호(전자)로 변환하는 이미지 센서가 있습니다. 이미지 센서는 다음으로 구성됩니다. 호출된 배열 노출 광자의 전자기 에너지가 마이크로 전압으로 변환되는 포텐셜 우물 역할을 하는 "포토다이오드". 이 전압은 다음으로 전달됩니다. 디지털 값을 출력하는 ADC(Analog-to-Digital Converter). 시장에서 사용 가능한 이미지 센서는 물리적 구조(CCD/CMOS), 픽셀 치수(Area Scan/Line Scan), 채도 유형(Color/Mono), 셔터 유형(Global/Rolling), 광 스펙트럼( UV/SWIR/NIR) 및 빛의 편광.

각각의 포토다이오드는 감지기 디지털 이미지의 픽셀에 해당합니다. 포토다이오드가 아날로그 값과 연결되어 있는 반면 이미지 픽셀은 디지털 값과 연결되어 있습니다. 픽셀은 디지털 이미지에서 가장 작은 요소이며 '그림 요소'의 약자입니다. 해상도, 강도, 노출, 게인 및 프레임 속도는 아래에서 설명하는 디지털 이미징과 관련된 기본 개념 중 일부입니다.

디지털 이미지 개념

- 해상도 – 디지털 이미지는 픽셀로 구성됩니다. 이미지 해상도는 이미지의 픽셀 열과 픽셀 행 수를 측정한 것입니다. 1280 x 1024의 이미지 해상도는 이미지의 너비가 1280픽셀, 높이가 1024픽셀임을 나타냅니다.

![]()

- 강함 - 이미지 픽셀의 밝기를 강도라고 합니다. ADC의 비트 심도가 클수록 강도를 표현할 수 있는 범위가 커집니다. 예를 들어 ADC의 비트 심도가 8비트인 경우 강도를 표현하는 데 사용할 수 있는 값은 2⁸ 또는 256(0~255)뿐입니다. 그러나 ADC의 비트 심도가 12비트인 경우 강도를 표현하는 데 사용할 수 있는 값은 이제 2¹² 또는 4096개입니다.

- 노출 - 노출은 포토다이오드가 빛에 노출되는 시간을 나타냅니다. 노출 시간은 일반적으로 마이크로초(µs) 및 밀리초(ms) 단위로 측정됩니다.

- 얻다 - 이득은 픽셀에 대한 강도 값의 증폭입니다. 센서에서 포토다이오드 전하의 세기가 커지면 아날로그 게인(analog gain), 전하가 디지털 값으로 변환된 후 픽셀 값이 커지면 디지털 게인(digital gain)이라고 한다.

- 프레임 속도 – 측정된 프레임 속도 초당 프레임 또는 FPS는 센서가 XNUMX초에 출력할 수 있는 이미지 수입니다.

케이블 연결

Ethernet

이더넷은 1983년 IEEE(Institute for Electrical and Electronic Engineers)에서 802.3 표준으로 도입한 LAN(Local Area Network) 기술입니다. IEEE 802.3은 물리적 계층 및 데이터 링크 계층의 미디어 액세스 제어(MAC)에 대한 사양을 정의합니다. 이더넷은 연선 동선(BASE-T)과 광섬유 배선(BASE-R)을 지원하는 유선 기술입니다. 아래 표에는 속도 및 케이블/트랜시버 유형에 따라 다양한 이더넷 네트워킹 기술이 언급되어 있습니다.

| 연선 구리 배선 기반 BASE-T 이더넷 표준 |

|---|

| 이름 | 속도 | 케이블 유형 | 최대 케이블 길이 |

|---|---|---|---|

| 1000BASE-T | 1Gbps | Cat5e Cat6 |

100 m |

| 10GBASE-T | 10Gbps | 고양이6A Cat7 고양이 7A |

100 m |

| 광섬유 배선 기반 BASE-R 이더넷 표준 |

|---|

| 이름 | 속도 | 트랜시버 유형 | 최대 케이블 길이 |

|---|---|---|---|

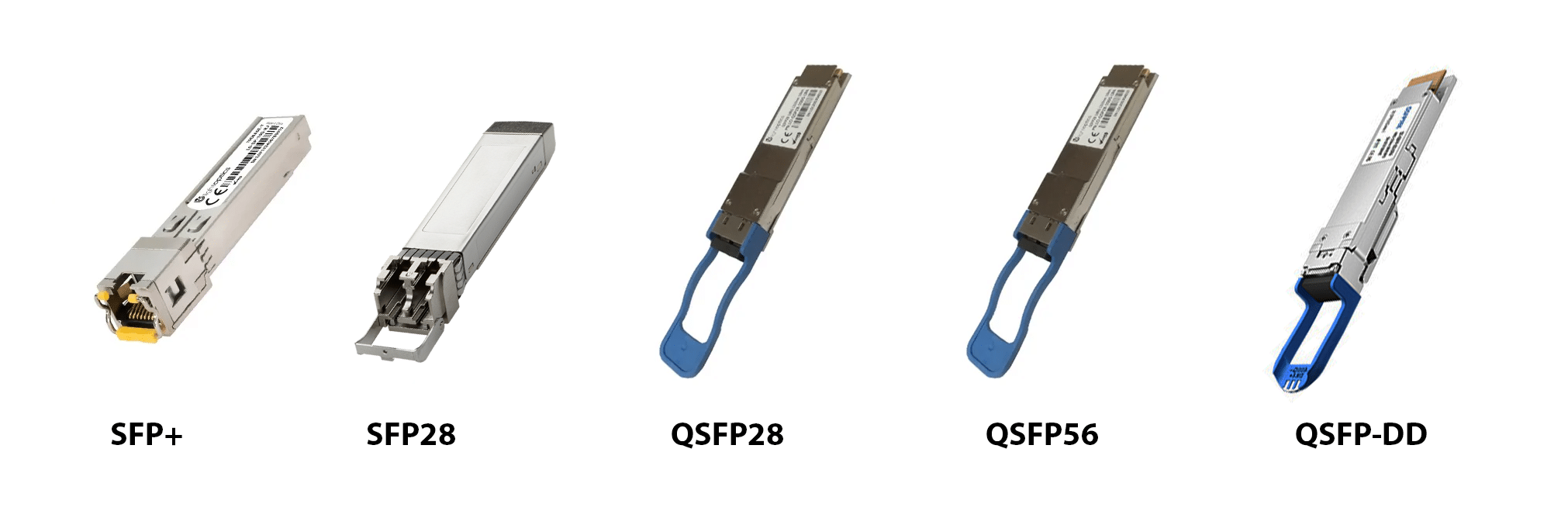

| 10GBASE-R | 10Gbps | SFP+(1레인) | 80km(ZR) |

| 25GBASE-R | 25Gbps | SFP28(1레인) | 80km(ZR) |

| 50GBASE-R | 50Gbps | QSFP28(2레인) SFP56(1레인) |

80km(ZR) |

| 100GBASE-R | 100Gbps | QSFP28(4레인) SFP56(2레인) SFP-DD(2레인) |

80km(ZR) |

| 200GBASE-R | 200Gbps | QSFP56(4레인) QSFP-DD(4레인) |

80km(ZR) |

| 400GBASE-R | 400Gbps | QSFP56(8레인) QSFP-DD(8레인) |

80km(ZR) |

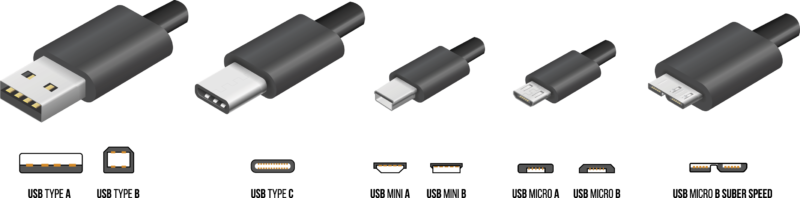

범용 직렬 버스 (USB)

USB(Universal Serial Bus) 표준은 1996년에 처음 발표되었으며 USB-IF(USB Implementers Forum)에서 관리합니다. USB는 개인용 컴퓨터에 대한 주변 장치의 연결을 표준화하도록 설계되었습니다. USB는 다음과 같은 주변 장치와 통신하고 전력을 공급할 수 있습니다. 키보드, 마우스, 비디오 카메라 및 프린터. 아래 표에는 다양한 USB 표준과 해당 속도가 나와 있습니다.

| USB 표준 |

|---|

| 이름 | 속도 | 최대 케이블 길이 |

|---|---|---|

| USB 2.0 | 480 Mbps의 | 5 m |

| USB 3.0 | 5Gbps | 3 m |

| USB 3.1 Gen 1 | 5Gbps | 3 m |

| USB 3.1 Gen 2 | 10Gbps | 3 m |

| USB 3.2(2 x 3.1 Gen 1) | 10Gbps | 3 m |

| USB 3.2(2 x 3.1 Gen 2) | 20Gbps | 3 m |

| USB 4 | 40Gbps | 0.8 m |

CoaX프레스

CoaXPress(CXP)는 동축 케이블을 통해 데이터를 전송하기 위한 점대점 통신 표준입니다. CoaXPress 표준은 슈투트가르트에서 열린 2008년 Vision Show에서 처음 공개되었으며 현재 JIIA(Japan Industrial Imaging Association)에서 관리하고 있습니다. 아래 표에는 다양한 CXP 표준이 언급되어 있습니다.

| CoaXPress 표준 |

|---|

| 이름 | 속도 | 최대 케이블 길이 |

|---|---|---|

| CXP-1 | 1.25Gbps | 212 m |

| CXP-6 | 6.25Gbps | 60 m |

| CXP-12 | 12.5Gbps | 40m |

| CXP 오버 파이버 | 10Gbps | 80 km |

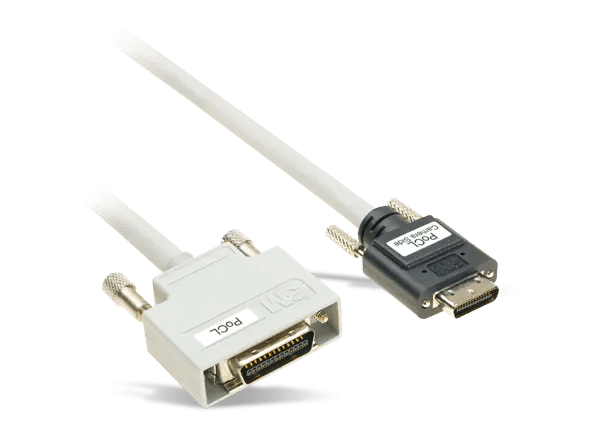

카메라 링크

Camera Link는 병렬 통신을 위해 구축된 고대역폭 프로토콜입니다. 카메라와 프레임 그래버 간의 연결을 표준화합니다. Camera Link에서 진화한 CLHS(Camera Link High-Speed)는 2012년에 처음 도입되었습니다. 카메라와 프레임 그래버 간에 지연 시간이 짧고 지터가 낮은 실시간 신호를 전달하고 다음을 사용하여 이미지 및 구성 데이터를 모두 전달할 수 있습니다. 구리 및 광섬유 케이블 연결용.

| 카메라 링크 표준 |

|---|

| 이름 | 속도 | 최대 케이블 길이 |

|---|---|---|

| 카메라 링크 베이스 | 2.04Gbps | 10 m |

| 카메라 링크 가득 참 | 5.44Gbps | 10 m |

| 카메라 링크 데카 | 6.80Gbps | 10 m |

| Camera Link HS(고속) | 25Gbps | 80 km |

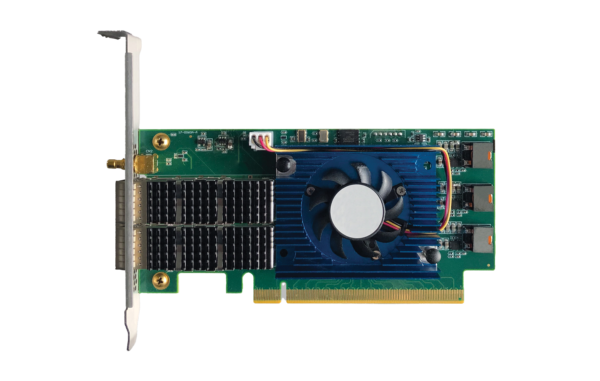

인터페이스 주변기기

Ethernet

- 네트워크 인터페이스 카드(NIC) - 이더넷 네트워크 인터페이스 카드 (NIC)는 PCIe 슬롯을 통해 컴퓨터 마더보드에 연결하고 Open Systems Interconnection 모델(OSI 모델)의 물리 계층 및 데이터 링크 계층에 대한 전자 회로를 구현하는 확장 카드입니다.

- 스위치 - A 네트워크 스위치 동일한 LAN(Local Area Network) 내에서 이더넷 장치를 연결합니다. 스위치가 물리적 포트에 연결된 장치 중 하나에서 패킷을 수신하면 스위치는 헤더를 읽은 다음 대상 주소를 일치시키고 적절한 포트를 통해 패킷을 대상 장치로 보냅니다. 다음은 스위치를 사용해야 하는 일부 머신 비전 카메라 기능입니다.

-

- 멀티플렉싱 – 각 카메라가 많은 양의 픽셀 데이터를 출력하는 고속 멀티 카메라 시스템(예: 64개 카메라 시스템)에서 스위치는 여러 이더넷 포트에서 들어오는 픽셀 데이터를 통합하여 서버 또는 호스트 PC로 출력해야 합니다. 단일 포트 사용.

-

- 멀티캐스팅 – 멀티캐스팅을 사용하는 머신 비전 애플리케이션은 카메라 데이터를 여러 호스트 PC로 전송하기 위해 스위치가 필요합니다.

-

- PTP(Precision Time Protocol) – 여러 카메라의 타임스탬프를 단일 장치의 시계와 동기화해야 하는 경우 스위치가 필요합니다.

- PTP(Precision Time Protocol) – 여러 카메라의 타임스탬프를 단일 장치의 시계와 동기화해야 하는 경우 스위치가 필요합니다.

- 이더넷 허브 - 허브는 리소스 공유를 위해 여러 장치를 함께 연결할 수도 있으며 허브에 연결된 장치 모음을 LAN 세그먼트라고 합니다. 허브는 연결된 장치 중 하나에서 보낸 패킷이 허브에 연결된 모든 장치로 브로드캐스트된다는 점에서 스위치와 다릅니다. 스위치를 사용하면 패킷이 지정된 장치로 연결되는 포트로만 전달됩니다.

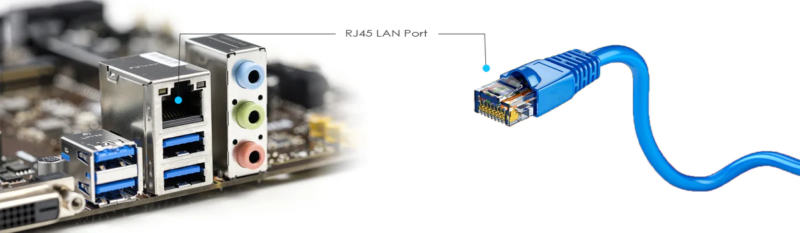

- 마더보드 상주 이더넷 포트 – 요즘 모든 마더보드에는 주로 1Gbps 속도를 지원하는 내장형 이더넷 포트가 있으며 경우에 따라 5Gbps 및 10Gbps 속도도 지원할 수 있습니다. 마더보드의 내장 이더넷 포트는 제한된 내부 버퍼 크기와 제한된 성능으로 인해 고속 애플리케이션에 권장되지 않습니다.

범용 직렬 버스 (USB)

- USB PCIe 카드 – USB 카드는 PC의 USB 포트 수를 늘리는 데 사용되는 PCIe 기반 확장 카드입니다. USB 2.0 및 USB 3.0과 같은 다양한 USB 표준을 지원하고 USB-A, USB-B, USB-C 및 Micro-USB와 같은 다양한 USB 커넥터를 지원하는 다양한 USB 카드가 시중에 나와 있습니다.

- USB 포트 허브 – USB 허브는 수 USB 커넥터를 사용하여 컴퓨터에 연결하고 사용 가능한 암 USB 포트가 있는 외부 장치입니다. USB 허브는 컴퓨터에 추가 USB 포트를 추가하므로 추가 USB 장치를 연결할 수 있습니다.

- 마더보드 상주 USB 포트 – 요즘 대부분의 마더보드에는 USB 3.0 포트가 내장되어 있으며 일부 마더보드는 여전히 USB 2.0과 USB 3.0을 모두 지원합니다.

CoaX프레스

- 프레임 그래버 - CoaXPress 프레임 그래버는 카메라에서 개별 프레임을 "캡처"하고 실시간 압축과 같은 다양한 고급 획득 및 이미지 처리 기능과 추가 대역폭 활용을 위한 관심 영역(ROI) 오프로드 기능을 지원합니다.

카메라 링크 및 CLHS

- 프레임 그래버 - CoaXPress 프레임 그래버와 마찬가지로 Camera Link 프레임 그래버는 카메라에서 개별 프레임을 "가져오고" 프로그래밍 가능한 관심 영역, 픽셀 데시메이션, 이미지 스케일링 및 조회 테이블과 같은 다양한 온보드 처리 기능을 포함합니다.

컴퓨팅 플랫폼

머신 비전 카메라 내부의 프로세서는 일반적으로 임베디드 프로세서 또는 모델별 펌웨어를 실행하는 FPGA(Field Programmable Gate Array). 이 펌웨어는 이미지 센서에서 픽셀 값을 읽고, 이미지 센서 기능을 구현하고, 픽셀 데이터를 처리하여 전체 이미지를 만들고, 이미지 향상 알고리즘을 적용하고, 외부 장치와 통신하여 완전한 이미지를 출력합니다.

카메라 내부의 프로세서는 제한된 에 전력 소비 최소화d 열 발생을 줄입니다. 결과적으로 매우 높은 프레임 속도를 처리하고 동시에 후처리 이미지를 출력하는 경우 처리 능력이 제한됩니다. 프레임 속도가 매우 높은 센서에서 나오는 대량의 이미지 데이터를 후처리하려면 카메라 프로세서의 리소스를 사용하는 대신 처리를 위해 이 데이터를 외부 시스템으로 보내는 것이 좋습니다. 이미지 후처리에 사용되는 다양한 시스템은 다음과 같습니다.

- 소비자 PC – 소비자 PC 기반 시스템은 다음과 같이 가장 유연하고 저렴한 옵션입니다. 기성 구성 요소를 사용하여 시스템을 설계할 수 있습니다. 머신 비전 카메라는 이더넷, USB, CoaXpress 및 Camera Link와 같은 인터페이스를 사용하여 PC 기반 시스템과 연결할 수 있습니다.

- 산업용 PC – 산업용 PC는 먼지와 이물질로부터 보호하기 위해 견고한 케이스에 내장되어 있습니다. 이러한 PC는 산업 환경의 충격, 진동 및 극한의 온도를 견딜 수 있습니다. 소비자 PC와 마찬가지로 이더넷, USB, CoaXpress 및 Camera Link와 같은 인터페이스를 사용하여 카메라를 산업용 PC에 연결할 수도 있습니다.

- 비전 컨트롤러 – 비전 컨트롤러도 PC 기반 시스템이지만 PC 기능 외에도 직렬 및 I/O 장치에 대한 지원도 제공합니다. 비전 컨트롤러는 RS232/RS485 포트, 아날로그 I/O 및 디지털 I/O와 같은 내장 직렬 및 I/O 인터페이스와 함께 제공됩니다. 직렬 및 I/O 인터페이스를 통해 PLC(프로그래밍 가능 로직 컨트롤러) 및 산업용 통신 C 시리즈 모듈과 쉽게 통합할 수 있으며 Modbus 직렬과 같은 통신 프로토콜을 구현할 수 있습니다. 일부 비전 컨트롤러에는 조명 제어를 위한 PWM 기능도 있습니다. 대부분의 비전 컨트롤러에는 머신 비전 카메라 연결을 위한 이더넷 및 USB 포트가 있습니다.

- 임베디드 시스템 - 내장형 시스템은 자율 주행 차량, 드론, 의료 기기와 같은 다른 대형 시스템에 내장할 수 있도록 설계된 고도로 구성 가능한 컴퓨터입니다. 이러한 임베디드 시스템은 이더넷 및 USB와 같은 동일한 표준 인터페이스도 지원하므로 머신 비전 카메라와 쉽게 인터페이스할 수 있습니다. 임베디드 시스템의 몇 가지 예는 NVIDIA Jetson Orin 및 NVIDIA Jetson Xavier입니다.

- 워크스테이션 PC – AMD Threadripper PRO 또는 Intel i9와 같은 프로세서를 사용하는 워크스테이션 PC는 성능과 비용의 균형을 맞출 때 다중 카메라 시스템 구축에 선호되는 선택입니다.

- 엔터프라이즈 서버 – AMD EPYC 및 Intel Xeon과 같은 프로세서를 사용하는 엔터프라이즈 서버는 고속 다중 카메라 시스템에서 처리 노드로의 픽셀 데이터 배포를 관리할 수 있을 뿐만 아니라 이미지 처리 워크로드에 탁월한 성능을 제공합니다.

- 클라우드 기반 시스템 – 예를 들어 인공 지능을 사용하여 머신 비전 애플리케이션의 복잡성이 증가함에 따라 PC 기반 시스템도 경우에 따라 처리 요구 사항을 충족할 수 없습니다. 이것은 다음과 같은 클라우드 기반 처리 플랫폼이 있는 곳입니다. AWS, Azure 및 Google Cloud는 처리를 확장할 수 있는 충분한 리소스를 제공하여 격차를 메우고 있습니다.

소프트웨어

머신 비전 카메라가 이미지를 캡처하여 호스트 PC로 보내는 역할을 하는 반면 호스트 PC에서 실행되는 이미징 소프트웨어는 다음을 담당합니다.

-

- 카메라 하드웨어와의 인터페이스

- 카메라 기능 제어

- 이미지 수신, 처리 및 분석

- 이미지 결과를 이용한 의사결정 수행

- 카메라 입력이 필요한 다른 연결된 장치 또는 기계와 통신

머신 비전에서 이미징 소프트웨어의 세 가지 범주는 다음과 같습니다.

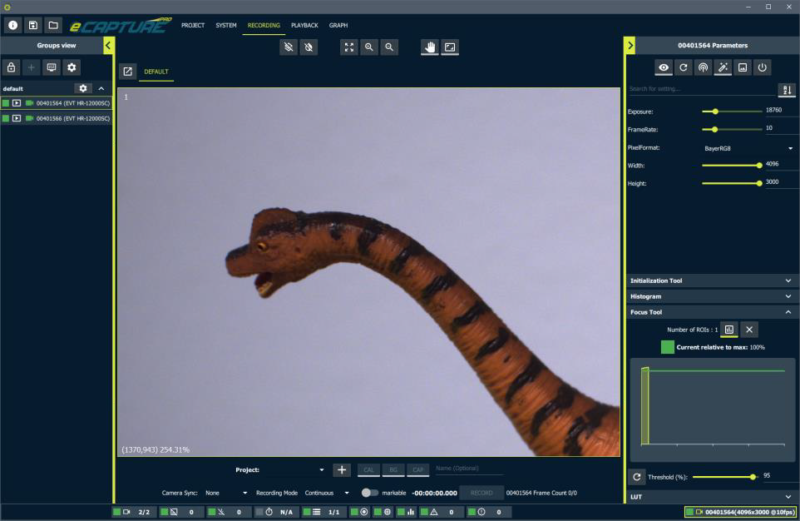

- 카메라 뷰어 – 카메라 뷰어 카메라를 쉽고 빠르게 시작할 수 있게 해주는 이미징 소프트웨어의 가장 사용자 친화적이고 상호작용적인 부분입니다. 네트워크 구성, 카메라 구성, 이미지 캡처, 향상, 표시 및 기록 기능 외에도 일부 이미징 소프트웨어는 히스토그램 및 라인 플롯과 같은 이미지 분석을 위한 고급 도구도 제공합니다.

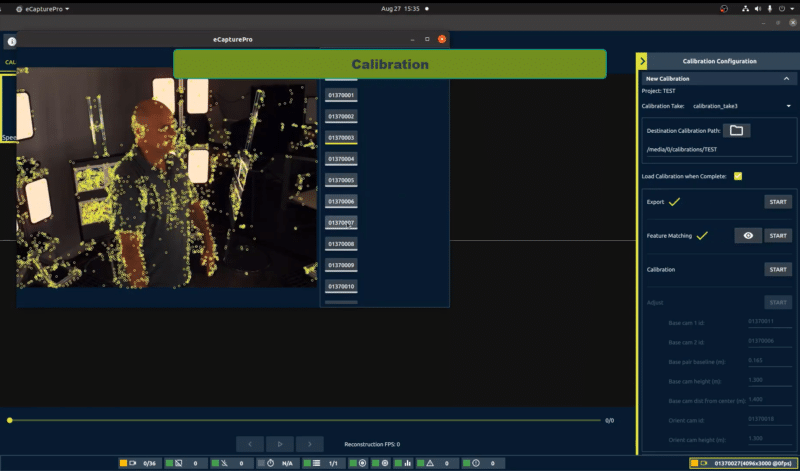

- 포괄적인 소프트웨어 – Camera Viewer의 모든 기능 외에도 종합 소프트웨어 프로젝트 관리, 다중 카메라 구성, 다중 서버 구성, GPU 지원, 3D 이미지 재구성 및 3D 개체 뷰어와 같은 고급 기능을 제공합니다.

- 소프트웨어 개발 키트(SDK) – SDK 코드 샘플, 코드 라이브러리, 애플리케이션 프로그래밍 인터페이스(API), 문서 및 컴파일러/디버거 등의 모음입니다. 대부분의 머신 비전 SDK는 C/C++/C#/Python 프로그래밍 언어를 지원하며 Windows, Linux용 맞춤형 애플리케이션을 개발하는 데 사용할 수 있습니다. 및 ARM 플랫폼.